Interfejsy mózg-komputer (BCI) przeszły długą drogę od czasu, gdy Hans Berger odkrył aktywność elektryczną ludzkiego mózgu w 1924 r. Dzisiaj komunikacja między naszym mózgiem a maszyną jest możliwa, choć do doskonałości wciąż sporo brakuje. Naukowcy przewidują, że boom tej technologii dopiero nastąpi w kolejnych dekadach, co z kolei umożliwi osobom niepełnosprawnym lub sparaliżowanym w poruszaniu się, kontrolowaniu robotycznych protez czy odzyskaniu zmysłów.

Teraz udało się stworzyć prosty, bezprzewodowy interfejs nakładany na głowę (bez bezpośredniego podłączania do mózgu), który wykorzystuje elektroencefalografię (EEG) do odczytywania i przetwarzania impulsów nerwowych na ruch.

Przełomowy BCI

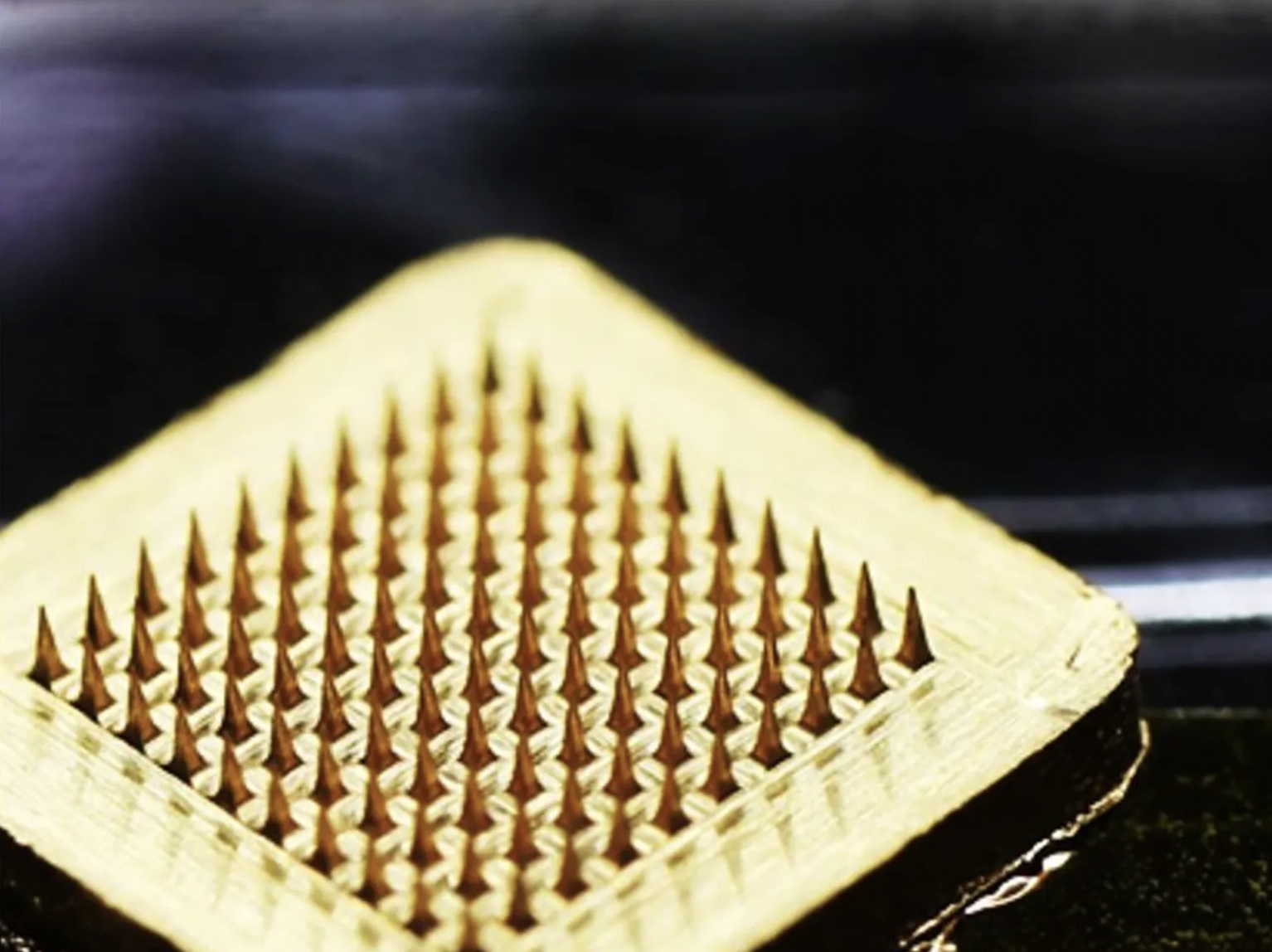

Przenośny interfejs mózg-komputer to owoc dwóch lat pracy zespołu Woon-Honga Yeo z Georgia Institute of Technology. W przeciwieństwie do konwencjonalnych urządzeń EEG, nie ma przewodów, metalowych elektrod i innych niewygodnych części. Ma natomiast elektrody mikroigłowe, które są niewyczuwalne na głowie, a zapewniają połączenie z mózgiem.

BCI zespołu Yeo przypomina czapkę, którą nakłada się na głowę (obecność włosów nie przeszkadza). Nie trzeba stosować żadnych past ani żelów, aby utrzymać BCI na miejscu. Zapis EEG jest możliwy dzięki niewidocznym gołym okiem mikroigłom, które penetrują naskórek głowy. Twórcy zapewniają, że po “podłączeniu” nie odczuwa się żadnego dyskomfortu, bo igły są zbyt małe, aby mogły zostać wykryte przez nerwy.

W konwencjonalnych urządzeniach EEG, każdy ruch, taki jak mruganie lub zgrzytanie zębami przez osobę noszącą aparat powoduje zaburzenie sygnału. W tym przypadku nie ma takiego problemu, bo cała konstrukcja na głowie jest stabilna.

Wciąż jest wiele wyzwań

Uczeni wykorzystali uczenie maszynowe do analizy i klasyfikacji sygnałów nerwowych odbieranych przez system, kiedy testerzy wyobrażali sobie aktywność motoryczną. To kluczowe, bo bez tego nie można odróżnić poszczególnych sygnałów.

Zazwyczaj naukowcy używają uczenia maszynowego lub deep learning. My użyliśmy konwencjonalnych sieci neuronowych. Są one zwykle stosowane w zadaniach takich, jak rozpoznawanie wzorów lub rozpoznawanie twarzy, a nie wyłącznie w przypadku impulsów nerwowych. Dopiero zaczęliśmy czerpać korzyści z tego mechanizmu.Woon-Hong Yeo z Georgia Institute of Technology

Do symulacji działania systemu wykorzystano również wirtualną rzeczywistość (VR). Ponieważ system opiera się na wyobrażeniach motorycznych, komponent VR działa jako wizualna wskazówka i “pomaga użytkownikowi lepiej wyobrazić sobie ruchy rąk lub stóp”. Znacznie poprawiło to jakość sygnału.

Pomimo udanych wstępnych testów, wciąż jest wiele do poprawy.

Głównym ograniczeniem nieinwazyjnych systemów BCI jest to, że mierzymy sygnały na skórze, przez czaszkę, przez tkanki. Dlatego musimy stale poprawiać jakość naszych urządzeń, aby uzyskać lepsze sygnały. W tym samym czasie, musimy również stale ulepszać naszą analizę danych, aby mieć lepszy wskaźnik dokładności.Woon-Hong Yeo

Naukowcy czekają na pozwolenie, aby przetestować system na osobach niepełnosprawnych.