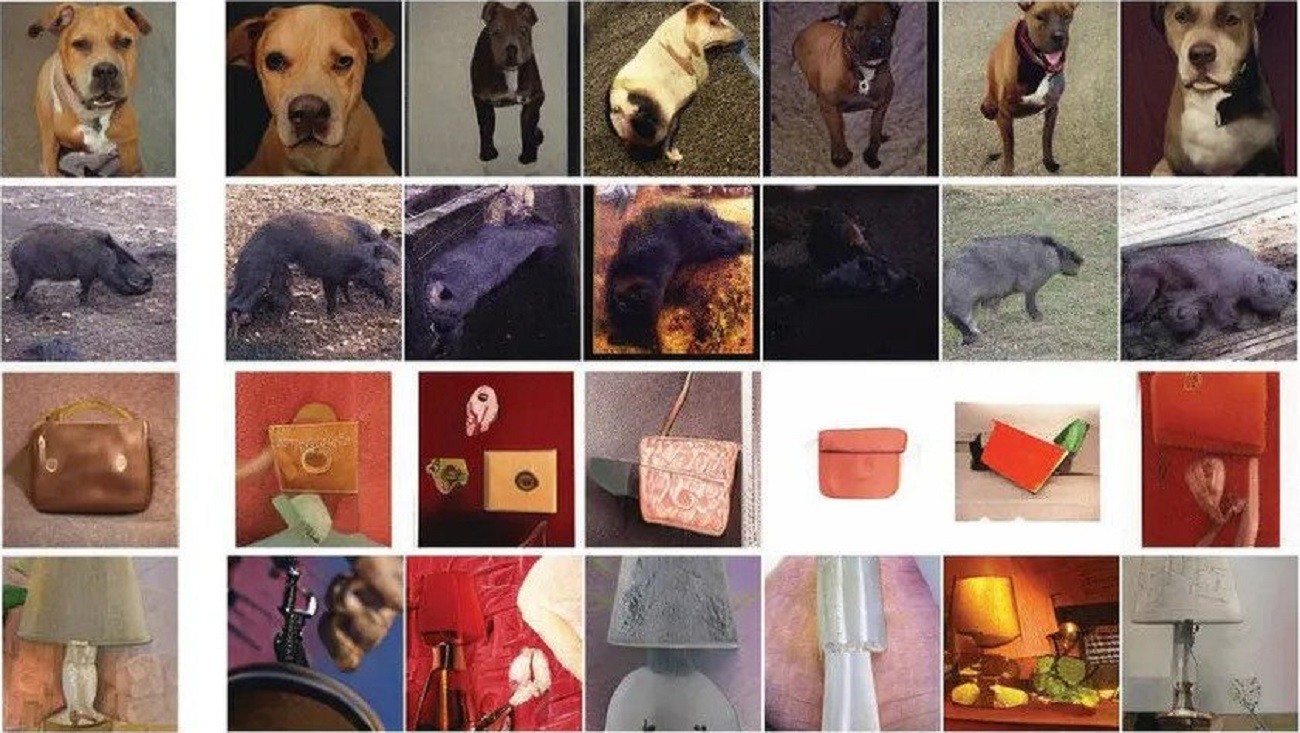

Autorzy badań wzięli pod lupę tzw. sieci GAN, czyli modele głębokiego uczenia, które wykorzystują dwie sieci neuronowe działające przeciwko sobie. Jedna z nich pełni rolę generatora tworzącego syntetyczne dane, druga natomiast dyskryminatora rozróżniającego dane rzeczywiste od syntetycznych. Celem jest tworzenie syntetycznych obrazów, które są niemal nie do odróżnienia od prawdziwych. To właśnie sieci GAN biorą udział w tworzeniu słynnych deepfake’ów.

Czytaj też: Czym tak naprawdę jest sztuczna inteligencja?

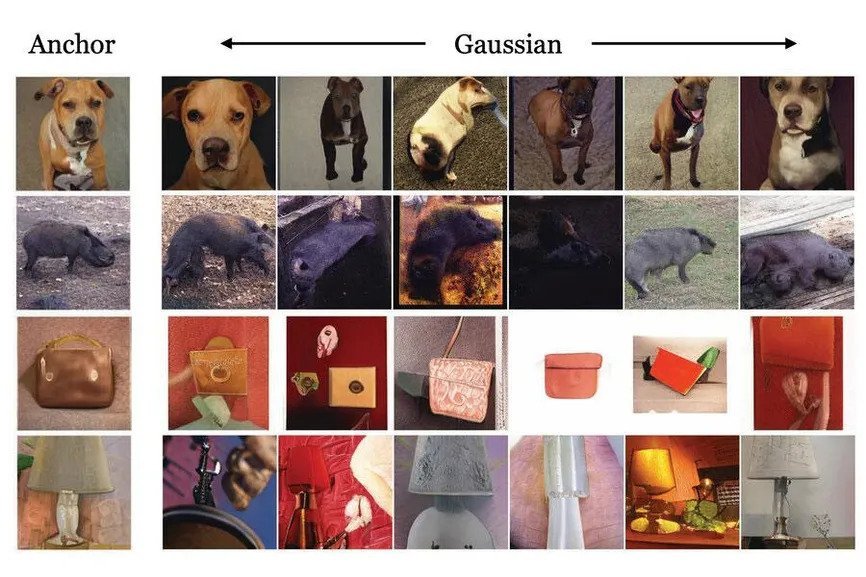

Okazuje się, że w przypadku niektórych zadań sieci GAN mogą osiągać lepsze wyniki niż dane rzeczywiste. Przykładem może być w tym przypadku StyleGAN firmy Nvidia, która jest w stanie oddzielić kolory od obiektów, a nawet obracać tymi obiektami. Wynika to z faktu, że uczy się ona nie tylko samych danych, lecz również ich transformacji. Pokazuje to, iż dane syntetyczne mogą okazywać się bardziej przydatne od rzeczywistych. Przewaga uwidacznia się w sytuacji, gdy brakuje dostępu do dużej ilości danych wysokiej jakości. W takim przypadku wstępnie wyszkolone modele generatywne mogą być wydajniejsze i bardziej dostępne.

Sieci GAN są modelami głębokiego uczenia

Dane syntetyczne okazują się też przydatniejsze w symulowaniu okoliczności, które nie istnieją naprawdę. Takie zbiory danych można edytować, nawet na dużą skalę, dzięki czemu można później usuwać błędy występujące w rzeczywistych zbiorach danych.

Wyzwaniem wydaje się obecnie kontrolowanie tego, co generuje model. Jak wyjaśnia Anna Rumshisky z University of Massachusetts w Lowell, w ciągu ostatnich trzech lat podjęto wiele działań, aby opracować modele, które pozwoliłyby kontrolować to, co jest generowane. Ostatecznym celem jest opracowanie takiego mechanizmu, który umożliwiłby odsunięcie modelu od generowania konkretnych rodzajów danych, na przykład osobowych, w postaci nazwisk czy numerów telefonów.

Czytaj też: Sztuczna inteligencja pokonała ośmiu mistrzów świata w brydżu. Padł jeden z ostatnich bastionów

Ali Jahanian związany z Computer Science and Artificial Intelligence Laboratory i będący autorem nowych badań, dodaje, iż jednym z problemów jest stronniczość ukryta w samych sieciach GAN. Poza tym niewiadomą pozostaje to, jak realistyczne mogą być syntetyczne zestawy danych oraz w jaki sposób mogą one wprowadzić sieć neuronową w błąd, aby “znormalizować coś, co nie jest normalne”.