Słuchawki ClearBuds bazują na algorytmie, który przypomina schemat działania naszych uszu

Pandemiczny świat i rozpowszechnienie się pracy zdalnej, zainspirowało wspomnianą trójkę do opracowania technologii, dzięki której słuchawki będą w stanie nie tylko zredukować hałas w tle, ale też wzmocnić głos rozmówcy. Tak powstały słuchawki ClearBuds, które wykorzystują mikrofony i przede wszystkim system uczenia maszynowego, aby to osiągnąć.

Jako że zabawa z SI nie jest wcale taką prostą sprawą i wymaga sporej mocy obliczeniowej, naukowcy opracowali algorytm z myślą o smartfonach. Po podłączeniu słuchawek ClearBuds z danym telefonem, oprogramowanie wykonuje całą pracę, wykorzystując do tego możliwości smartfona. Można więc porównać to do narzędzia NVIDIA Voice z myślą o komputerach osobistych.

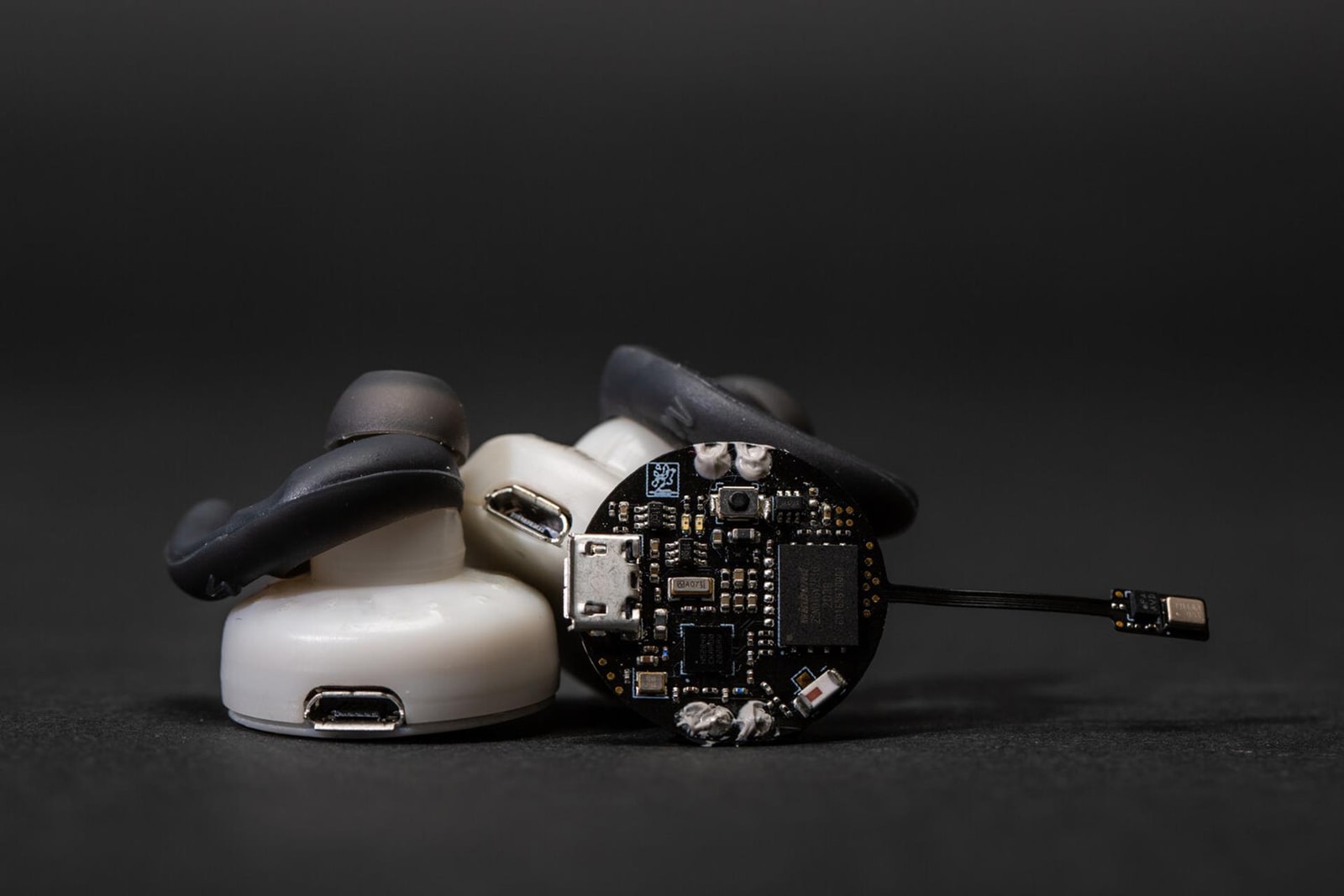

ClearBuds odróżniają się od innych bezprzewodowych wkładek dousznych na dwa kluczowe sposoby. Po pierwsze, wykorzystują podwójny układ mikrofonów. […] Po drugie, sieć neuronowa dodatkowo wzmacnia głos mówiącego– powiedział jeden z twórców, Maruchi Kim.

Czytaj też: Jak podkręca sztuczna inteligencja? Czyli Wasze procesory w rękach algorytmów

W praktyce mikrofony w obu słuchawkach tworzą dwa zsynchronizowane (opóźnienie Bluetooth sięga w ich przypadku ~70 ms) strumienie audio, które dostarczają informacji i pozwalają nam przestrzennie oddzielić dźwięki pochodzące z różnych kierunków z wyższą rozdzielczością. Opracowany przez zespół algorytm przetwarza te strumienie audio tak, że najpierw tłumi wszelkie niegłosowe dźwięki (np. szum), a następnie izoluje i wzmacnia szumy dochodzące jednocześnie z obu wkładek dousznych, czyli w domyśle głos użytkownika.

Ponieważ głos mówiącego znajduje się w pobliżu i w przybliżeniu w równej odległości od obu słuchawek, sieć neuronowa może zostać wytrenowana tak, aby skupiała się tylko na jego mowie i eliminowała dźwięki tła, a w tym inne głosy.Ta metoda jest dość podobna do tego, jak działają nasze uszy. Wykorzystują różnicę czasową między dźwiękami dochodzącymi do lewego i prawego ucha, aby określić, z którego kierunku pochodzi dźwięk– wyjaśnił Ishan Chatterjee.

Czytaj też: Acer i x-kom ruszają z akcją Promo Days. Sprzęt taniej o nawet 1100 zł!

W porównaniu ClearBuds z Apple AirPods Pro, ClearBuds wypadły lepiej, osiągając wyższy stosunek sygnału do zniekształceń we wszystkich testach, a w niezależnych testach z udziałem 37 osób potwierdzono, że to ClearBuds zapewniają najwyższą jakość nagrań. Teraz zespół pracuje nad uczynieniem algorytmów sieci neuronowej jeszcze bardziej wydajnymi i tym samym mniej wymagającymi, aby mogły działać nie na układach smartfonów, a bezpośrednio samych słuchawek.