Jak podano szacunkowo, z nowego rozwiązania będzie mogło skorzystać ponad 100 mln maszyn na całym świecie. Być może kwalifikuje się do tego także Twój komputer z systemem Windows. Jakie warunki musi spełniać urządzenie i co daje nowa technologia? Na szczęście nie jesteśmy zdani na domysły. Wszystko zostało oficjalnie ogłoszone.

Który Windows 11 dostanie lepszą SI?

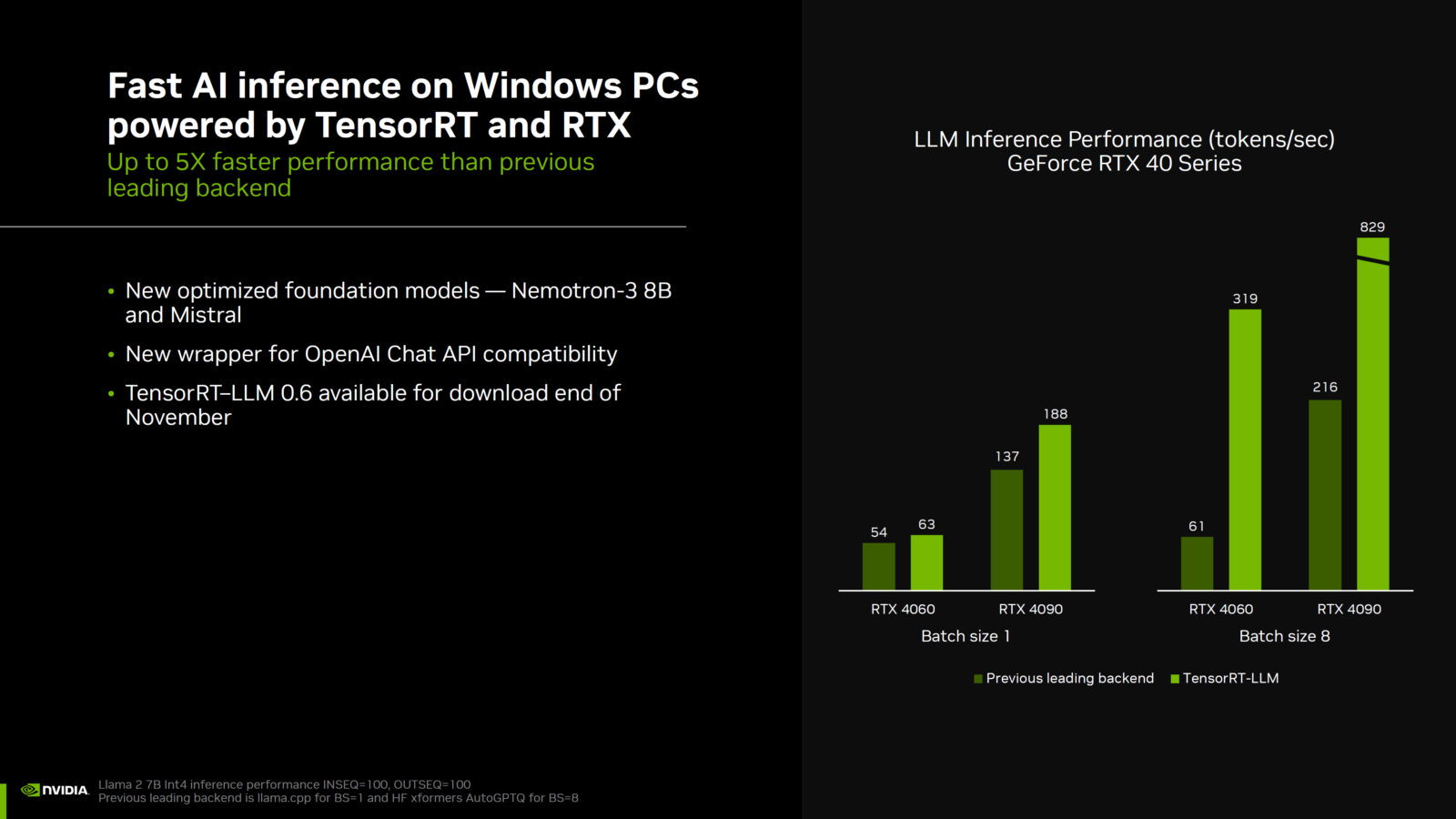

TensorRT-LLM to duży model językowy, który działa lokalnie – a więc nie w chmurze – co zaoszczędza czasu związanego z obróbką i transferem danych. Model ten wykorzystuje m.in. technologię RAG (Retrieval Augamanted Generation), umożliwiającą na bardziej precyzyjne działania przy wykorzystaniu danych zgromadzonych lokalnie. Pojawi się wraz z nowymi sterownikami już 21 listopada, a będą mogli skorzystać z niego zarówno użytkownicy desktopów, jak i laptopów używający kart GeForce RTX 30 i 40. Jest jednak pewien warunek – muszą być to edycje mające minimum 8 GB pamięci VRAM.

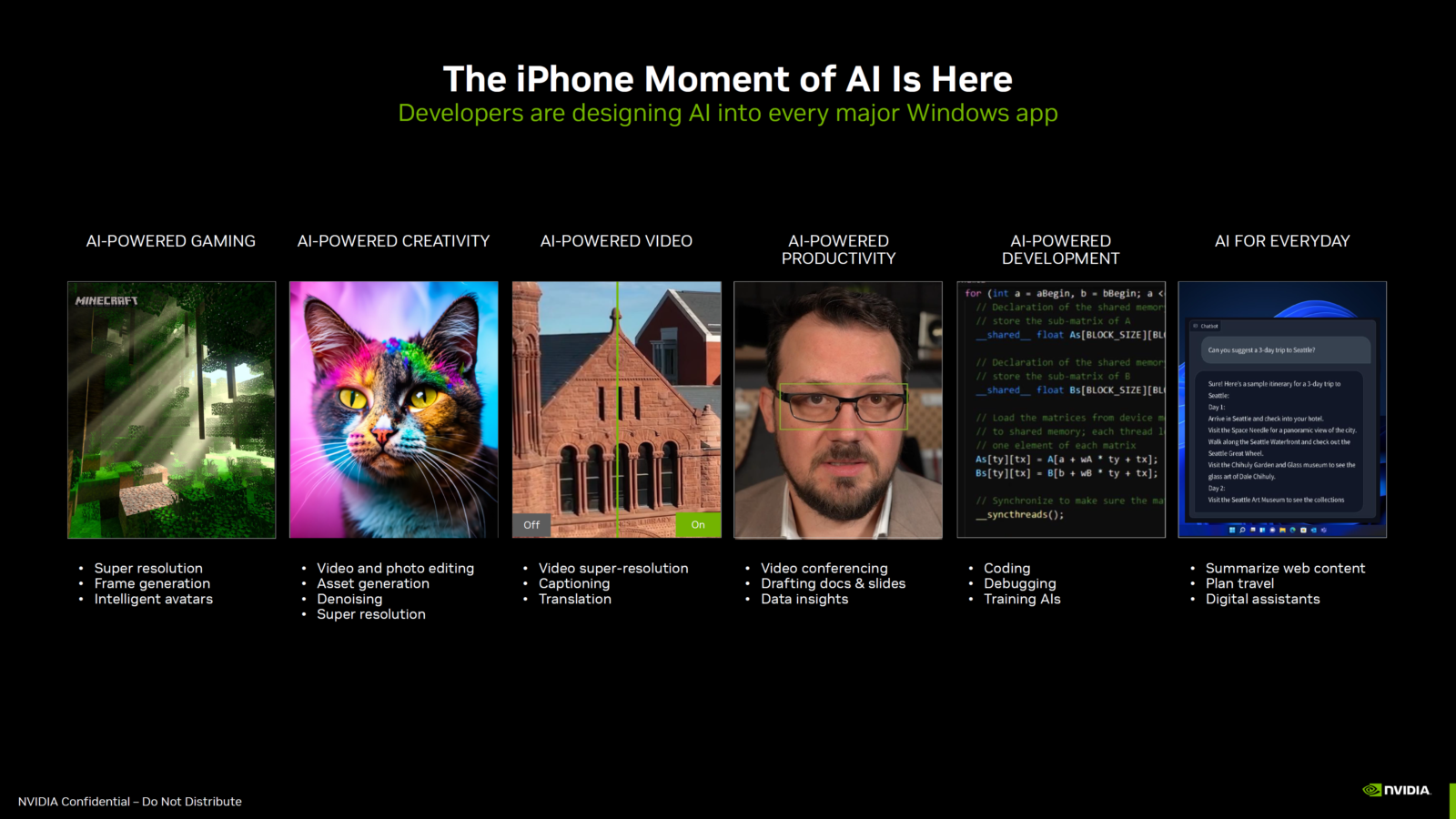

Aktualizacja wejdzie do wszystkich edycji systemu – co jest oczywiste, ponieważ nie jest ona powiązana z samym Windowsem, a układami Nvidii. Tu przy okazji dodam, że obaj producenci ogłosili przy okazji także ulepszenia DirectML dla popularnych modeli SI – Llama 2 i Stable Diffusion. A na co konkretnie wpłynie zmiana w Windows 11? Jako że sztuczną inteligencję można zastosować na wielu polach, Microsoft przygotował poniższą prezentację, która oddaje istotę rzeczy. Choć przeznaczona jest dla iPhone’a, to samo będzie w Windowsie.

Czytaj też: Zdjęcia w Windows 11 będą zasilone przez sztuczną inteligencję. Co to da w praktyce?

Jak poinformowała Nvidia, z modelem TensorRT-LLM v0.6.0 wydajność wzrośnie aż pięciokrotnie. Ponadto w przyszłości model ten pozwoli na korzystanie z dodatkowych LLM-ów, jak Mistral 7B czy Nemotron 3 8B. Ale i na tym nie koniec nowości. Nvidia wraz z Microsoftem pracują nad interfejsem API dla OpenAI – jego nazywa to po prostu ChatAPI – który nie tylko usprawni współpracę z TensorRT na Windows 11, ale również pozwoli na stworzenie workflow łączącego dane na lokalnym dysku i w chmurze. W praktyce nie potrzeba będzie ładowania całego zbioru danych – będą one dostępne w każdej chwili. Oczywiście pod warunkiem, że maszyna ma połączenie z siecią.

Najwięcej z TensorRT-LLM skorzystają oczywiście firmy oraz korporacje, które zajmują się obrabianiem dużych ilości danych. Jednak także każda osoba prywatna będzie mogła w pełni doświadczyć możliwości dawanych przez ten model SI do swoich własnych zastosowań. Ja zaś spodziewam się, że w Windows 12 (który wciąż jest teoretyczny) nie tylko pojawi się to właśnie rozwiązanie, ale będzie ono także znacznie bardziej rozbudowane. Póki co jednak zaczekajmy, aż Nvidia opublikuje nowe sterowniki.