Nigdy wcześniej technologia nie dawała tak wielkich możliwości tworzenia, ale też tak wielkiego potencjału do oszustw. YouTube chce pomóc chronić się przed niektórymi z nich

Wraz z boomem na sztuczną inteligencję, internet zalała fala tzw. deepfake’ów – realistycznych, ale fałszywych nagrań wykorzystujących wizerunek i głos ludzi. Dotyka to szczególnie twórców internetowych, których twarz i głos są ich marką, a ich niewłaściwe użycie może prowadzić do promowania oszustw, produktów, których nie popierają, lub szerzenia dezinformacji. Dlatego właśnie YouTube oficjalnie uruchomił technologię wykrywania wizerunku (Likeness-Detection), oddając potężne narzędzie w ręce twórców z Programu Partnerskiego.

Technologia wykrywania wizerunku to zaawansowany system, który skanuje platformę w poszukiwaniu treści wygenerowanych przez AI, które naśladują twarz i głos twórcy. Celem jest ochrona twórców przed nieautoryzowanym wykorzystaniem ich tożsamości. Nie mówimy tu tylko o zabawnym memie. Mówimy o przypadkach, takich jak firma Elecrow, która użyła AI do sklonowania głosu YouTubera Jeffa Geerlinga w celu promowania swoich produktów bez jego zgody. W erze, gdy deepfake’i stają się coraz dziwniejsze i bardziej przekonujące (pomyślmy o fałszywych reklamach wykorzystujących wizerunek słynnych osób), ochrona staje się koniecznością.

Nowa funkcja jest już wdrażana u uprawnionych twórców w ramach YouTube Partner Program. Ci, którzy spełniają kryteria, otrzymali specjalne e-maile z instrukcjami, jak rozpocząć proces weryfikacji i aktywacji narzędzia.

Czytaj też: Koniec samotnych konwersacji? ChatGPT stanie się aplikacją społecznościową

Jak twórca może przejąć kontrolę?

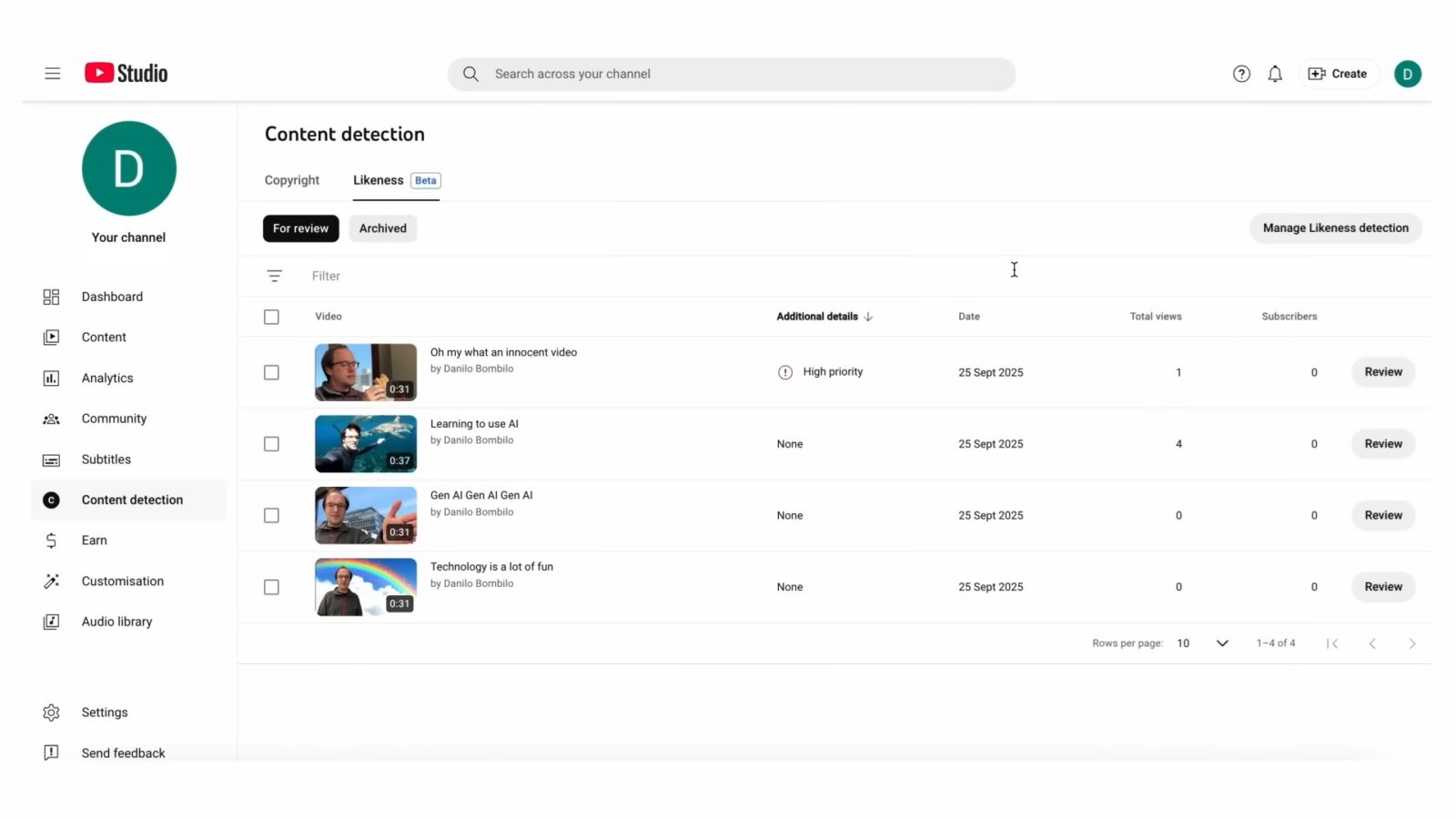

Proces aktywacji systemu, jest całkiem prosty, choć wymaga dokładnej weryfikacji. Twórca musi przejść do specjalnej zakładki „Wizerunek” (Likeness) w panelu zarządzania, a następnie:

- Wyrazić zgodę na przetwarzanie danych.

- Zweryfikować tożsamość, skanując kod QR telefonem i przesyłając zdjęcie dowodu tożsamości oraz krótki filmik selfie. Ma to pomóc AI YouTube’a w nauczeniu się rozpoznawania konkretnego twórcy.

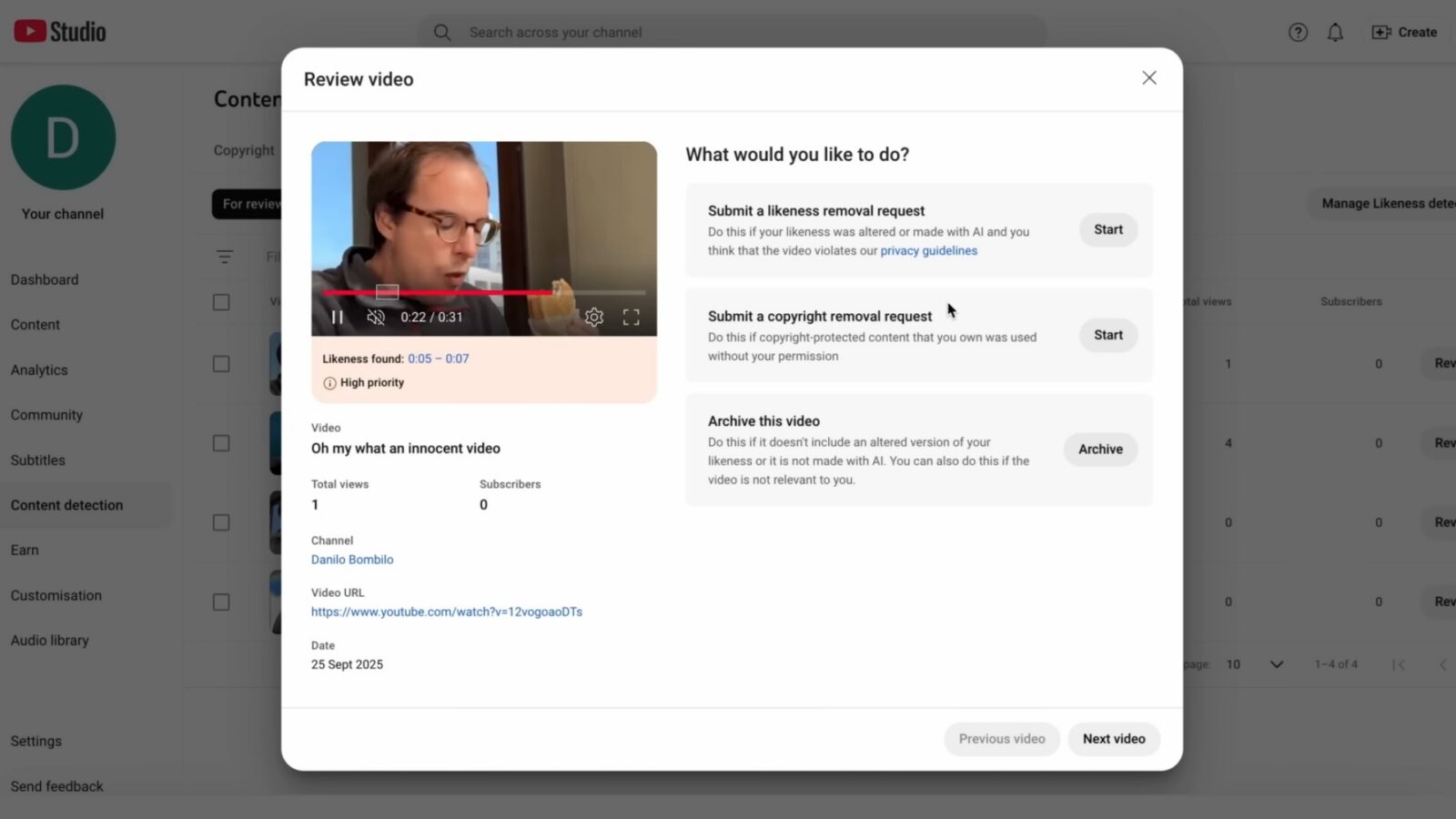

Po uzyskaniu dostępu do narzędzia, twórca zyskuje pełną kontrolę nad wykrytym nieautoryzowanym wizerunkiem. Może złożyć wniosek o usunięcie wideo, powołując się na wytyczne YouTube dotyczące prywatności. Jest to idealne rozwiązanie, gdy wideo ma charakter szkodliwy lub oszukańczy. W przypadku deepfake’ów na dużą skalę lub celowego naruszenia prawa, twórca może złożyć bezpośredni wniosek o naruszenie praw autorskich. Istnieje również opcja zarchiwizowania filmu, jeśli twórca uzna, że jego obecność jest nieszkodliwa lub akceptowalna.

Co ważne, każdy twórca może zrezygnować z korzystania z technologii w dowolnym momencie. YouTube zobowiązuje się do zaprzestania skanowania filmów pod kątem ich wizerunku w ciągu 24 godzin od wycofania zgody.

Google dąży do upowszechnienia AI, ale zdaje też sobie sprawę z zagrożeń, jakie ta technologia ze sobą niesie

Wprowadzenie Likeness Detection to element szerszej strategii YouTube w radzeniu sobie z AI. Już wcześniej firma ogłosiła współpracę z agencją Creative Artists Agency (CAA), aby pomóc celebrytom, sportowcom i twórcom w identyfikacji treści generowanych przez AI. Ponadto, YouTube wyraził swoje poparcie dla legislacji NO FAKES Act, ustawy, która ma na celu uregulowanie kwestii nieautoryzowanego użycia wizerunku i głosu w treściach AI, zwłaszcza tych tworzonych w celu oszukiwania lub generowania szkodliwych materiałów.

Czytaj też: Google wzmacnia ochronę Androida przed oszustami. Koniec z przemyconymi linkami i głosami-klonami

Wprowadzając to narzędzie, platforma wysyła jasny sygnał: choć technologia AI jest przyszłością, prawa twórców do kontroli nad własnym wizerunkiem muszą być chronione. Miejmy nadzieję, że dzięki temu na naszych stronach głównych zobaczymy mniej przypadków nieautoryzowanych deepfake’ów.

Uruchomienie technologii wykrywania wizerunku to ważny krok milowy w walce z negatywnymi skutkami sztucznej inteligencji na platformach społecznościowych. Mam też nadzieję, że za tym przykładem pójdą też inne serwisy, takie jak TikTok, mający setki milionów użytkowników.