Część czytanych przez was treści powstaje w sztucznych mózgach napędzanych algorytmami. Jeśli zaglądacie czasem do popularnego serwisu CNET, to mieliście większą szansę na nie trafić. Już od listopada zeszłego roku trwa tam bowiem eksperyment z tzw. “technologią automatyzacji”, która pomaga w pisaniu tekstów dotyczących finansów osobistych, tworzonych pod kątem pozycjonowania w wyszukiwarkach internetowych.

Sam CNET bynajmniej się z tym eksperymentem nie kryje, ale z drugiej strony jakoś bardzo głośno o tym nie trąbi. Sytuacja nie uszła jednak uwadze internautów, którzy znaleźli wiele mówiący podpis pod treściami produkowanymi przez AI: Ten artykuł był wspomagany przez silnik sztucznej inteligencji i recenzowany, sprawdzany pod kątem faktów i redagowany przez nasz zespół redakcyjny.

Roboty piszą dla robotów, w dodatku z błędami

Od razu pojawiło się pytanie, co na to rzeczone wyszukiwarki? Otóż sam Google, który zapewniał, że powstrzyma ewentualną lawinę tekstów AI pisanych typowo pod wyszukiwarki, na razie nie wydaje się mieć z pisaniem AI najmniejszego problemu. Pozycjonuje tego typu treści w wynikach wyszukiwania równie wysoko, jak teksty pieczołowicie przygotowane przez ludzi od copywritingu SEO.

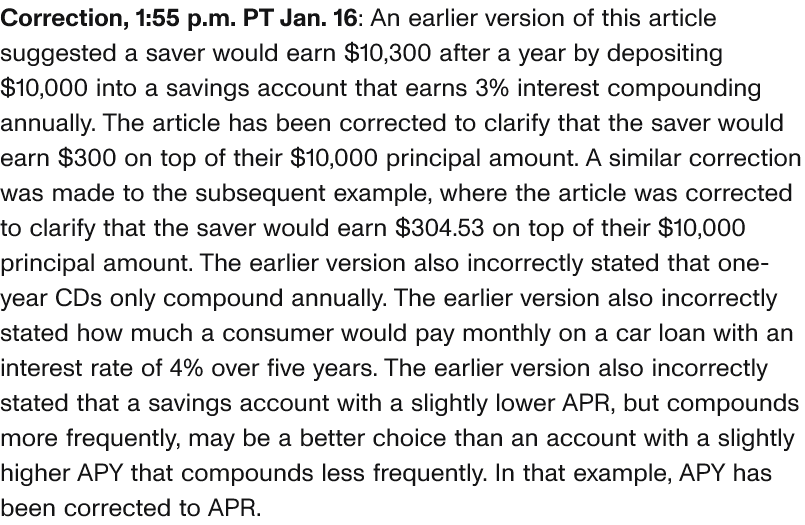

Kolejny problem to błędy merytoryczne znalezione już przynajmniej w kilku z całkiem dużej puli niemal 80 materiałów przygotowanych do tej pory przez autora o nazwie CNET Money. Jedna z korekt dodanych do tekstu napisanego przez AI wydaje się co najmniej kuriozalna:

Wcześniejsza wersja tego artykułu sugerowała, że oszczędzający zarobi 10300 dolarów po roku, wpłacając 10000 dolarów na konto oszczędnościowe, które przynosi roczne odsetki w wysokości 3%. Artykuł został poprawiony, aby wyjaśnić, że oszczędzający zarobiłby 300 dolarów oprócz kwoty głównej wynoszącej 10000 dolarów.

It’s a feature, not a bug (to ma tak działać). Czyżby?

To nie jedyny błąd w tym tekście, co możecie zobaczyć na załączonym obrazku. Szefostwo CNET uparcie broni eksperymentu i wyjaśnia, że ma on na celu uwolnienie czasu dla dziennikarzy do pisania bardziej pogłębionych i lepszych materiałów. Najlepsze w tym kontekście wydaje mi się suche oświadczenie wysłane z konta CNET do dziennikarzy serwisu VICE, którzy zauważyli wpadkę i poprosili o komentarz.

Czytaj też: ChatGPT ssie! Gwiazda rocka nie ma co do tego żadnych wątpliwości

Komunikat nie został przez nikogo podpisany, jest napisany dość sztucznie, a jego ostatnie ewidentnie zrzuca winę na redaktora odpowiedzialnego za przeglądanie tekstów pisanych przez AI:

Aktywnie przeglądamy wszystkie nasze treści wspomagane przez sztuczną inteligencję, aby upewnić się, że nie ma dalszych nieścisłości, które przeszły przez proces edycji, ponieważ ludzie też popełniają błędy.

Zaraz, ale to AI przecież miało im pomagać? Czy ja tu czegoś nie rozumiem? I czy faktycznie ten biedny redaktor, któremu zlecono poprawianie baboli po sztucznej inteligencji jest najbardziej winnym całego zamieszania?

Znów, nie zrozumcie mnie źle. Nie jestem zagorzałym przeciwnikiem automatyzacji oraz AI. Mało tego, sam stosuję różne sposoby na to, aby usprawnić swoje codzienne funkcjonowanie w tym zawodzie. Z niepokojem obserwuję jednak eksperymenty prowadzone na żywym organizmie (na nas), który sam jest skłonny do zniekształcania rzeczywistości. Pytaniem otwartym pozostaje, czy w tym konkretnym przypadku technologia nam bardziej pomaga czy szkodzi?