Rozwój sztucznej inteligencji, jaki właśnie obserwujemy, może niektórych przyprawiać o dreszcze grozy. Trudno się temu dziwić, bo na wyciągnięcie ręki mamy narzędzia pozwalające stworzyć realistycznie wyglądające nagrania z udziałem jakichś znanych osób, a nawet podłożyć ich głos, który będzie prawie niemożliwy do odróżnienia od oryginału. Z takich możliwości chętnie korzystają osoby szerzące fake newsy czy oszuści, próbujący podszywać się pod innych ludzi. W tym kontekście trudno mi było w pierwszej chwili nie podejść sceptycznie do nowego pomysłu Apple’a. Kiedy natomiast dowiedziałam się, o co tak naprawdę w tym chodzi, zmieniłam jednak zdanie.

Garść nowości od Apple’a z okazji Światowego Dnia Świadomości Dostępności

Przypadające na 16 maja święto ma na celu uświadamianie o problemach, jakie w świecie cyfrowym mogą napotykać osoby z niepełnosprawnościami. Nie ma więc lepszego momentu na ogłoszenie nowych funkcji ułatwień dostępu na iPhone’y. Apple przedstawił właśnie ulepszenia, które po wdrożeniu pomogą osobom z różnymi niepełnosprawnościami w łatwiejszym korzystaniu ze smartfonów. Nowości powstały we współpracy ze społecznościami reprezentującymi użytkowników niepełnosprawnych i wykorzystują najnowsze rozwiązania, w celu zapewnienia lepszego komfortu użytkowania iPhone’ów.

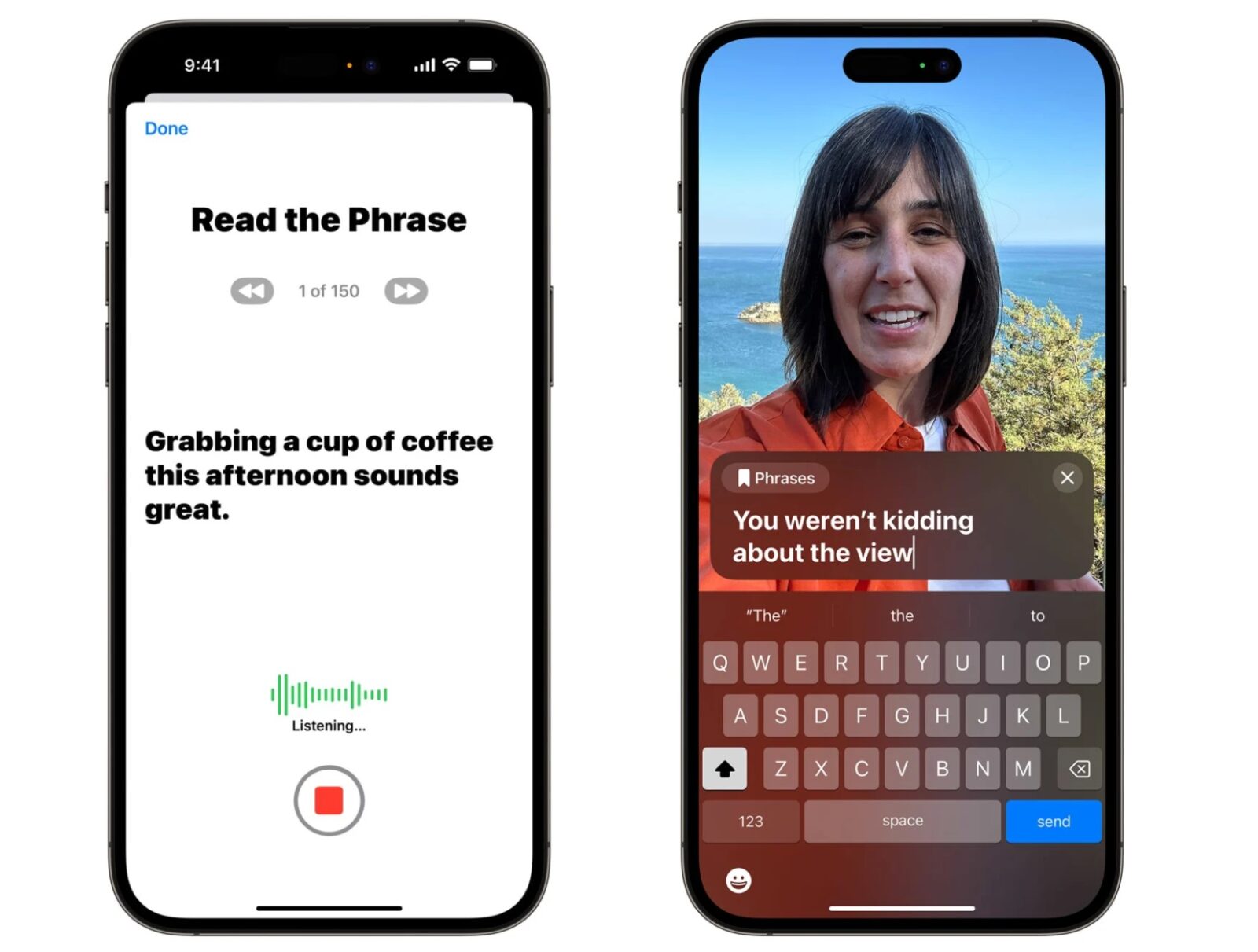

Jedną z najciekawszych funkcji wydaje się ta o nazwie Personal Voice, która umożliwia użytkownikowi stworzenie cyfrowej kopii własnego głosu. Wystarczy 15 minut szkolenia, by iPhone mógł przemówić naszym głosem i na pierwszy rzut oka może się to wydawać czymś, co oszuści z pewnością chcieliby wykorzystać w niecny sposób. Tego oczywiście nie da się wykluczyć jak zresztą zwykle w podobnych przypadkach. Apple jednak chce, by z tej funkcji korzystały osoby, którym grozi ryzyko utraty głosu. W ten sposób dostają możliwość stworzenia „syntetyzowanego głosu, który brzmi jak oni” i korzystać z niego w razie potrzeby podczas kontaktu z przyjaciółmi i bliskimi. Opcja ta integruje się z funkcją Live Speech, więc można na ekranie wpisać to, co chce się powiedzieć, a cyfrowy odpowiednik naszego głosu odczyta komunikat wskazanej osobie.

Trzeba przyznać, że jest bardzo przydatna nowość, która może uczynić życie wielu osób znacznie łatwiejszym. Apple znosi w ten sposób pewną barierę komunikacyjną, bo mogąc używać cyfrowej kopii własnego głosu, osoby niepełnosprawne będą czuły się mniej wyobcowane niż wtedy, gdy musiały korzystać z bezosobowego, często brzmiącego niczym robot, lektora.

Jest to, nawiasem mówiąc, o wiele przydatniejsza (i moim zdaniem rozsądniejsza) opcja niż ta, którą odkryto w niedawno zgłoszonym przez firmę patencie, w ramach którego Apple wymyślił sobie, że wiadomości w iMessage byłyby odczytywane głosem… nadawcy. Ten generowany byłby na podstawie zbieranej przez Siri próbki i przekształcany w plik, który następnie służyłby sztucznej inteligencji odtwarzania głosu danej osoby podczas czytania wiadomości.

Jednak Personal Voice to nie wszystko, co przygotował gigant

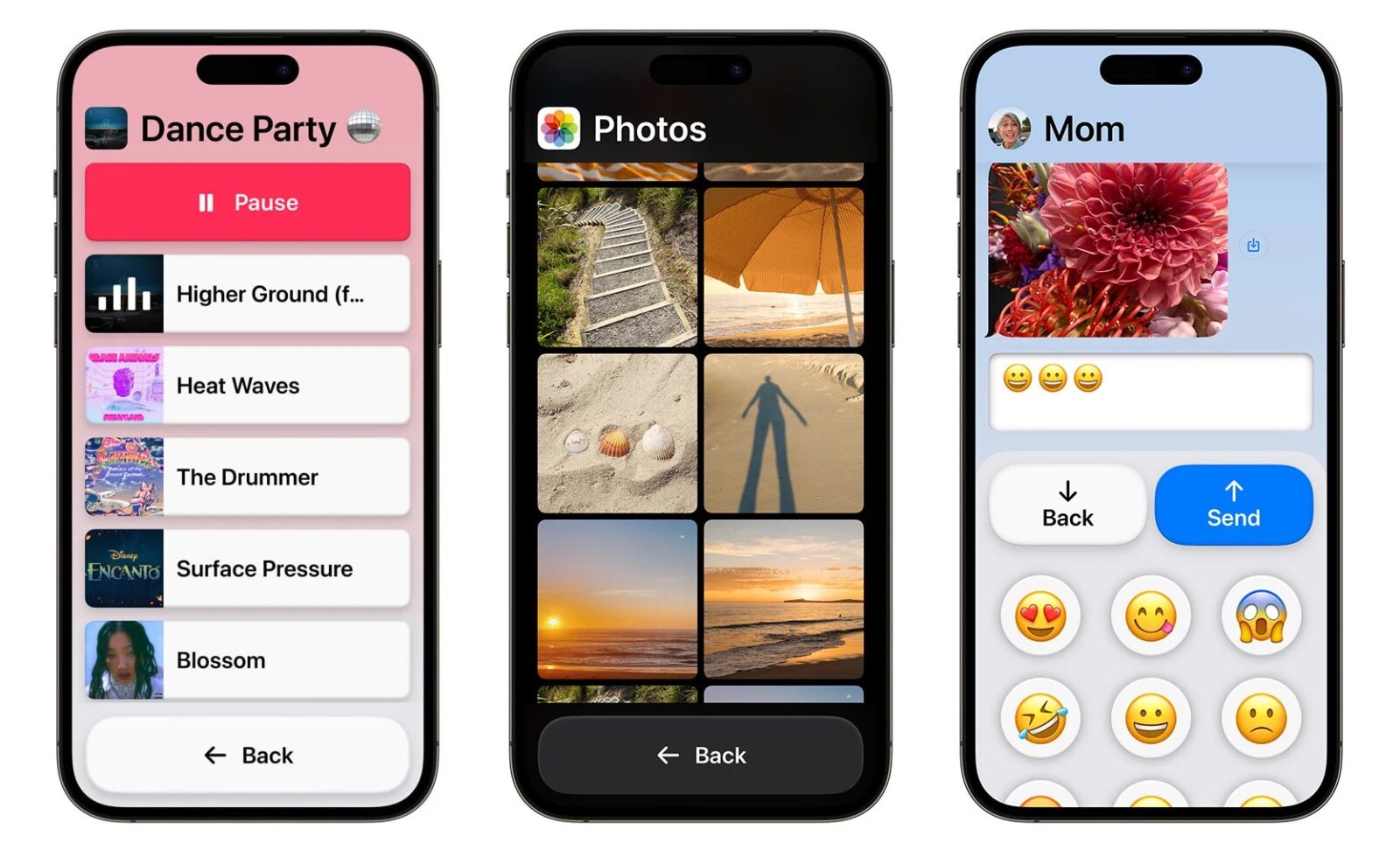

Oprócz tego firma wprowadziła usprawnienia do swoich podstawowych aplikacji w ramach funkcji o nazwie Assistive Access, która ma wspierać użytkowników z zaburzeniami poznawczymi. Aplikacje takie jak FaceTime, Wiadomości, Aparat, Zdjęcia czy Muzyka zostaną dzięki temu uproszczone, zyskując „wyraźny interfejs z przyciskami o wysokim kontraście i dużymi etykietami tekstowymi”. Funkcja dodaje też dodatkowe opcje personalizacji, w zależności od wymagań użytkownika, które mogą wprowadzić zaufane osoby.

Na przykład dla użytkowników, którzy preferują komunikację wizualną, Wiadomości zawierają klawiaturę zawierającą wyłącznie emotikony oraz opcję nagrywania wiadomości wideo w celu udostępnienia ich bliskim. Użytkownicy i zaufani osoby wspierające mogą również wybierać między bardziej wizualnym układem opartym na siatce Ekran główny i aplikacje lub układ oparty na wierszach dla użytkowników, którzy preferują tekst – tłumaczy Apple.

Oprócz tego w Lupie pojawiła się funkcja Point and Speak, dedykowana osobom z wadami wzroku, by mogły lepiej wchodzić w interakcję z obiektami fizycznymi z licznymi etykietami tekstowymi. Można więc nakierować kamerę na daną etykietę, a urządzenie odczyta na głos jej treść kierowane ruchem palca. Jest to bardzo przydatne np. podczas korzystania ze sprzętów typu kuchenka mikrofalowa czy pralka.

Czytaj też: WWDC 2023 zbliża się wielkimi krokami. Apple szykuje trzęsienie ziemi – wszystko, co musisz wiedzieć

Apple wprowadzi te nowości jeszcze w tym roku, więc spodziewam się, że znajdą się one na pokładzie iOS 17, nowej wersji systemu, która ma zostać zaprezentowana podczas nadchodzącej konferencji WWDC 2023.