Na wstępie słowo wyjaśnienia: termin DeepNude to zbitek słów oznaczających głębokie sieci neuronowe (DNN – Deep Neural Networks) i nagość (Nudity). Tego typu treści powszechnie uznaje się za jedną z podkategorii DeepFake’ów, czyli fałszywych treści generowanych przez wspomniane wielowarstwowe sieci neuronowe, zdolne do uczenia się na bazie wcześniejszych doświadczeń. Najczęściej DeepNude to ‘po prostu’ zmanipulowane zdjęcie lub film z konkretną osobą częściowo lub w całości rozebraną (np. z głową wkomponowaną w już istniejącą treść pornograficzną).

DeepNude od kuchni – jak to ustrojstwo w ogóle działa

Jak tłumaczy Michał Koźbiał, starszy inżynier oprogramowania pracujący w zespole NASK Science, wykorzystywane są tu głównie techniki generatywnego AI, które można podzielić na dwa podstawowe typy. Tzw. GAN-y (Generative Adversarial Networks – sieci przeciwstawne lub adwersaryjne) składają się z dwóch sieci neuronowych: generatora i dyskryminatora. Druga z nich ma rozpoznać, czy treść dostarczona przez pierwszą faktycznie była sztucznie generowana. W procesie uczenia obie sieci ze sobą ‘konkurują’, aby docelowo osiągnąć możliwie najlepszy wynik generatora. Niech za przykład GAN posłuży witryna ThisPersonDoesNotExist. Drugi typ to tzw. generatywne sieci typu dyfuzyjnego, które działają na zasadzie odszumiania obrazu. Kontrolę nad tym procesem sprawuje tekst wpisywany na wstępie przez użytkownika, czyli tzw. prompt. Przykładem takiego rozwiązania są dobrze znane narzędzia do tworzenia grafiki, takie jak Stable Difussion czy DALL-E.

W kontekście DeepNude jedną z powyższych metod tworzony jest fałszywy obraz (zdjęcie lub wideo) przedstawiający postać nago lub skąpo odzianą. Zazwyczaj mamy tu trzy rodzaje narzędzi – pierwsze to tzw. nudifiers, czyli aplikacje do rozbierania, drugie to face swap (zamiana twarzy), a trzecią stanowią już narzędzia do generowania kompletnej sceny i to one wydają się obecnie największym zagrożeniem. Niestety znalezienie tego typu aplikacji w Internecie nie nastręcza większych trudności, a do ich obsługi nie są nawet wymagane żadne specjalne umiejętności techniczne. Drugie “niestety”: wraz z błyskawicznym rozwojem tej technologii będzie nam coraz trudniej odróżnić fałszywe treści od oryginalnych.

W jaki sposób rozpoznać DeepNude/DeepFake?

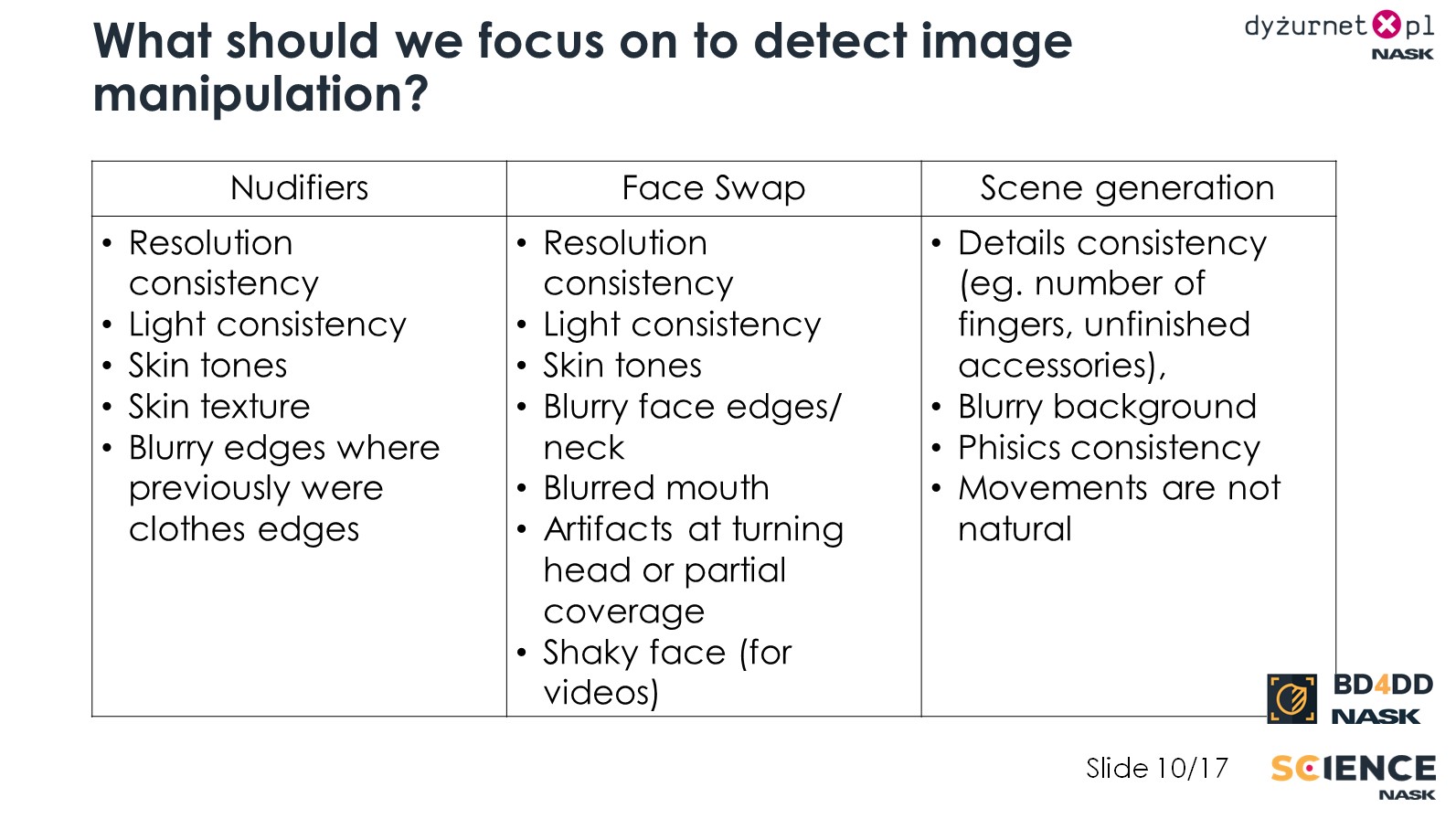

Niedoskonałość technologii działa na naszą korzyść, więc nadal wprawne oko rozpozna, że ma do czynienia z fałszywym zdjęciem lub filmem. Warto zwracać uwagę na spójność rozdzielczości, oświetlenia, koloru skóry, tekstury ciała. Przy częściowej podmianie zdjęcia na obrzeżach mogą się pojawić artefakty (najczęściej na styku łączenia skóry z ubraniem. Przy podmianie twarzy lub głowy artefakty będą się pojawiać właśnie na obrzeżach wklejenia. Rozmazane usta, zęby albo ich brak to kolejna wskazówka.

Jeżeli mamy do czynienia z wideo, technologia ma tu większe wyzwanie (szczególnie gdy twarz jest częściowo przysłonięta albo w innej pozycji). Przede wszystkim warto zwracać uwagę na detale, spójność i ogólny sens, a nawet liczbę palców czy obecność dodatkowych elementów, np. okularów. Często w generacyjnych obrazach mamy do czynienia z rozmazanym tłem, które nie ma większego sensu. Nadal w przypadku narzędzi typu Sora od OpenAI (przynajmniej na podstawie filmów, które zostały udostępnione) widać, że ruchy postaci nie są w pełni naturalne (widać niespójności w fizyce, przenikanie się postaci i planów, jak w grach wideo).

Społeczna strona DeepNude – kobietom obrywa się najmocniej

Niedawne badanie przeprowadzone na grupie młodych Belgów przez Uniwersytet w Antwerpii ukazuje alarmujące statystyki dotyczące rozprzestrzeniania się treści typu DeepNude wśród młodych w grupie wiekowej 15-25 lat. Aż 98-99% poszkodowanych stanowią tutaj kobiety. Co więcej, 98% treści tego typu miało charakter seksualny. Wśród ankietowanych 41,9% słyszało o tej technologii, a widziało ją na własne oczy 23%. Umiejętność obsługi aplikacji do generowania materiałów DeepNude zadeklarowało 12,8% badanych, a 7,6% tego typu treści posiada (to głównie mężczyźni). Niemal 14% respondentów otrzymało taki materiał.

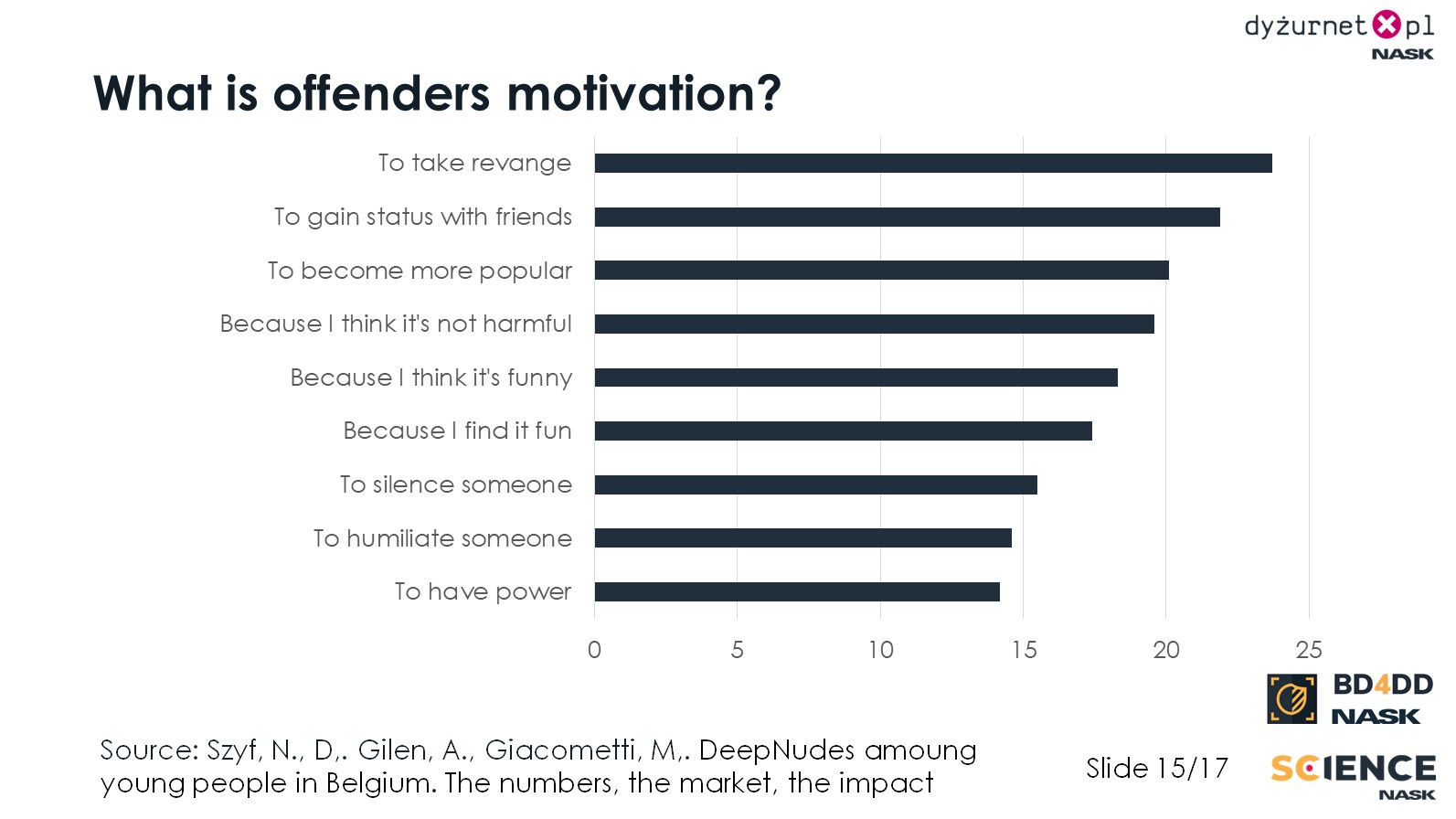

Instynktownie nasuwa się pytanie: dlaczego to komuś robimy? Okazuje się, że najczęściej chodzi o ogólną formę zemsty i nie dotyczy to wyłącznie ludzi w związkach. Na kolejne miejsca wśród ankietowanych wysuwa się chęć podniesienia swojego statusu w grupie czy zyskania na popularności. Nuda? Również bardzo wysoko, ale spora część respondentów kompletnie nie zdaje sobie sprawy z tego, że robi coś niezgodnego z prawem. A oto katalog potencjalnych konsekwencji bycia ofiarą DeepNude: PTSD (zespół stresu pourazowego), zaburzenia lękowe, depresja, utrata pewności siebie, a w ekstremalnych sytuacjach nawet myśli samobójcze.

W teorii jeżeli sami staniemy się ofiarą DeepNude lub nasz wizerunek zostanie nielegalnie wykorzystany, powinniśmy zgłosić to na policję, jak również powiadomić o sprawie prokuraturę i administratora danej strony, w celu usunięcia materiału. W praktyce różnie z tym bywa, o czym opowiedziała obecna na spotkaniu szefowa Dyżurnet.pl, Martyna Różycka. W niektórych przypadkach pomóc może tzw. prawo do zapomnienia. Zgodnie z art. 17 RODO każda osoba fizyczna może żądać “bycia zapomnianym”, tj. żądać usunięcia swoich danych osobowych przetwarzanych przez administratora. Treści nadal mogą być dostępne, ale wyszukiwarka internetowa ucina powiązanie z nimi i nie są one już tak widoczne.

Z raportów przejrzystości Google wynika, że Polacy w kwestii liczby wniosków o prawo do zapomnienia są daleko w tyle i być może po prostu o takim rozwiązaniu nie wiedzą. Równolegle w NASK trwają prace nad technologią hashowania zdjęć (cyfrowego podpisu). Docelowo będzie można wrzucić swoje zdjęcie do specjalnego systemu, który wyszuka i usunie treści pokrywające się z konkretną sygnaturą. Co ciekawe, proces hashowania odbywa się jeszcze w telefonie, więc nie ma potrzeby wysyłania pliku na zewnątrz (dostarczane są wyłącznie informacje o nim). Tego typu rozwiązanie jest obecnie dostępne i testowane w Wielkiej Brytanii, ale być może już wkrótce zawita też do Polski, za sprawą inicjatywy NASK.

Czytaj też: NASK i nowa strategia obrony polskiej przestrzeni informacyjnej. A niezależność od nacisków politycznych?

Na sam koniec, dzięki uprzejmości Martyny Różyckiej z Dyżurnet.pl, poniżej podajemy aktualnie obowiązujące w Polsce akty prawne, które mogą zostać wykorzystane w kontekście zgłaszania treści typu DeepNude.

- W przypadku treści przedstawiających osobę małoletnią:

Kodeks karny Art. 202. § 4b. Kto produkuje, rozpowszechnia, prezentuje, przechowuje lub posiada treści pornograficzne przedstawiające wytworzony albo przetworzony wizerunek małoletniego uczestniczącego w czynności seksualnej podlega grzywnie, karze ograniczenia wolności albo pozbawienia wolności do lat 2.

- W przypadku treści przedstawiających osobę niezależnie od wieku:

Art. 191a. § 1. Kto utrwala wizerunek nagiej osoby lub osoby w trakcie czynności seksualnej, używając w tym celu wobec niej przemocy, groźby bezprawnej lub podstępu, albo wizerunek nagiej osoby lub osoby w trakcie czynności seksualnej bez jej zgody rozpowszechnia, podlega karze pozbawienia wolności od 3 miesięcy do lat 5.

§ 2. Ściganie następuje na wniosek pokrzywdzonego.

- Prawo autorskie i prawa pokrewne (Dz.U.2022.2509 t.j. z dnia 2022.12.06)

Rozdział 10. Ochrona wizerunku, adresata korespondencji i tajemnicy źródeł informacji

Art. 81. [Zezwolenie na rozpowszechnianie wizerunku]

- Rozpowszechnianie wizerunku wymaga zezwolenia osoby na nim przedstawionej. W braku wyraźnego zastrzeżenia zezwolenie nie jest wymagane, jeżeli osoba ta otrzymała umówioną zapłatę za pozowanie.

- Zezwolenia nie wymaga rozpowszechnianie wizerunku:

- osoby powszechnie znanej, jeżeli wizerunek wykonano w związku z pełnieniem przez nią funkcji publicznych, w szczególności politycznych, społecznych, zawodowych;

- osoby stanowiącej jedynie szczegół całości takiej jak zgromadzenie, krajobraz, publiczna impreza.