Jak popularne chatboty, z których korzystamy codziennie, zajmują się naszymi danymi

Niezależnie od tego, czy korzystamy z nowatorskich aplikacji, takich jak Doppl (umożliwiający wirtualne przymierzanie ubrań z zaskakująco silnymi zabezpieczeniami prywatności), czy też mamy do czynienia z bardziej inwazyjnymi platformami, jak Meta AI (która próbuje zachęcić do przesyłania zdjęć z galerii), ochrona danych powinna być priorytetem. Jak więc sprawdzić, który z popularnych asystentów AI najlepiej dba o naszą cyfrową prywatność?

Czytaj też: Microsoft Copilot też padł ofiarą legendy Atari 2600. Historia się powtarza

Badacze z firmy Incogni podjęli się tego zadania, chcąc określić, które z komercyjnie dostępnych platform AI najlepiej chronią prywatność użytkowników. W badaniu przeprowadzonym pod koniec maja, Incogni analizowało los danych wprowadzanych przez użytkowników (tzw. promptów), sposób ich udostępniania stronom trzecim oraz przejrzystość polityk prywatności poszczególnych firm.

Czytaj też: Przychodzi Microsoft do lekarza i mówi: nasze AI diagnozuje pacjentów lepiej

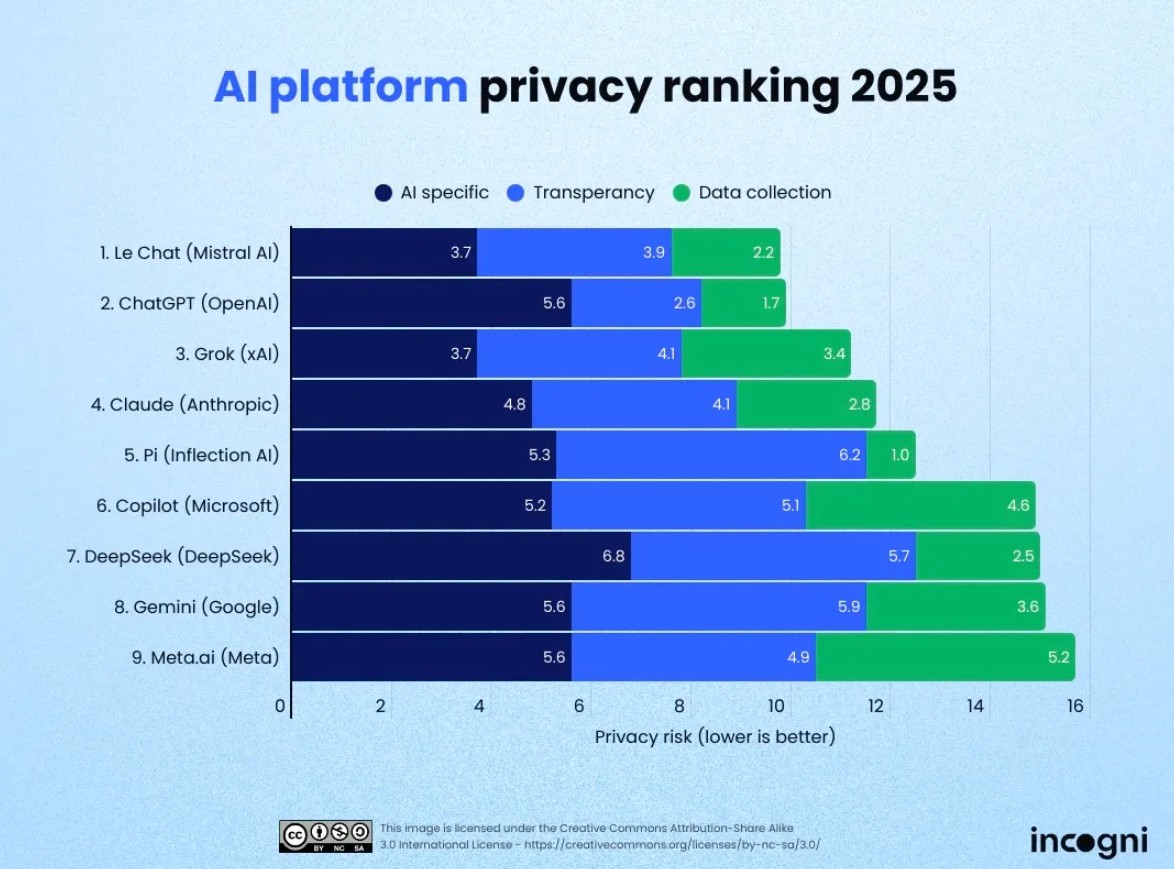

Wyniki dostarczają cennych spostrzeżeń. Jako platforma najmniej inwazyjna dla prywatności, na szczycie rankingu uplasował się francuski chatbot Le Chat (Mistral). Tuż za nim znalazły się ChatGPT i Grok. Platformy te wyróżniały się “najwyższą przejrzystością w zakresie wykorzystania i zbierania danych oraz łatwością rezygnacji z wykorzystywania danych osobowych do szkolenia modeli”. Na drugim końcu skali, jako najbardziej naruszające prywatność, uplasowały się platformy dużych firm technologicznych. Meta AI okazała się “najgorsza”, wyprzedzając Gemini, Copilot i Deepseek.

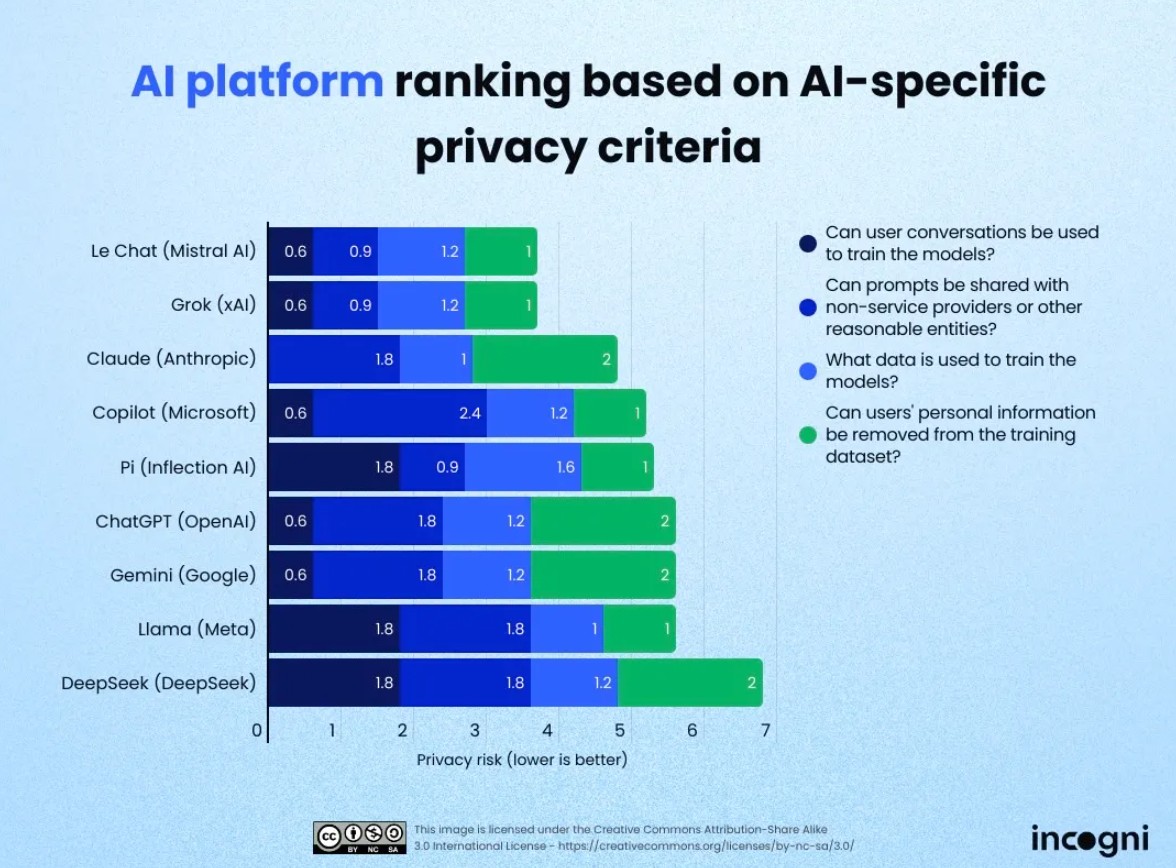

Badanie Incogni wykazało, że niektóre platformy AI, takie jak Gemini, DeepSeek, Pi AI i Meta AI, nie pozwalają użytkownikom zrezygnować z wykorzystywania ich promptów do szkolenia modeli. ChatGPT jest najbardziej transparentny w tej kwestii, oferując klarowną politykę prywatności. To dobra wiadomość dla długoterminowych użytkowników sztucznej inteligencji od OpenAI, którzy mogli zrezygnować z tego typu wykorzystania danych. Badacze stwierdzili, że również Copilot, Mistral AI i Grok umożliwiają użytkownikom rezygnację z wykorzystywania danych do szkolenia. Niestety, badanie ostrzega, że po tym, jak dane znajdą się w zbiorze danych szkoleniowych, ich usunięcie jest mało prawdopodobne.

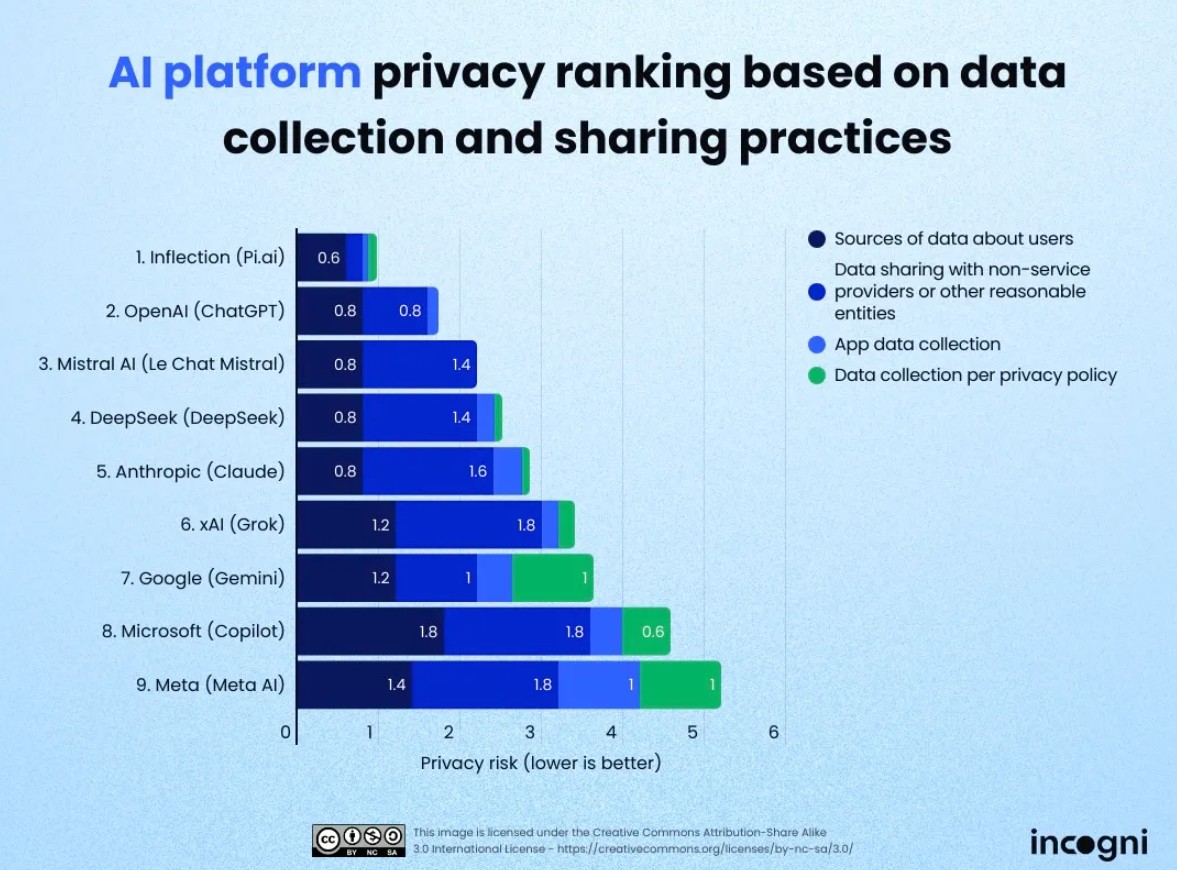

Analiza Incogni objęła także kwestię udostępniania danych przez platformy AI innym podmiotom. Okazuje się, że firmy stojące za chatbotami mogą przekazywać dane różnym stronom trzecim, w tym dostawcom usług, organom prawnym i rządowym, innym przedsiębiorstwom, a także innym niezdefiniowanym podmiotom. W tej kategorii ponownie wyróżniły się Meta AI i Microsoft Copilot, które udostępniają dane wielu partnerom.

Kolejnym aspektem badanym przez Incogni była przejrzystość dokumentacji prawnej i łatwość zrozumienia polityk prywatności przez przeciętnego użytkownika. Tutaj OpenAI (ChatGPT) okazał się najbardziej transparentny, oferując zrozumiałe informacje o tym, co dzieje się z danymi użytkowników. Na ostatnich miejscach w tym rankingu znalazły się Gemini i Inflection. Większe podmioty, takie jak Google, Microsoft i Meta, często mają szeroko zakrojone polityki prywatności, które obejmują wszystkie ich produkty, a nie tylko narzędzia AI, co może sprawiać, że są trudniejsze do czytania i zrozumienia dla większości użytkowników.

Czytaj też: Cloudflare domyślnie zablokuje boty AI i wprowadza system płatności za pozyskiwanie danych

Incogni zbadało również, jakie inne rodzaje informacji, poza samym tekstem promptów, mogą zbierać firmy AI. Okazało się, że Pi AI i ChatGPT wypadły najlepiej w tej kategorii, ponieważ zbierają niewiele informacji poza treścią czatu. Natomiast na końcu listy znalazły się Gemini, Copilot i Meta AI, które pozyskują znacznie więcej danych.

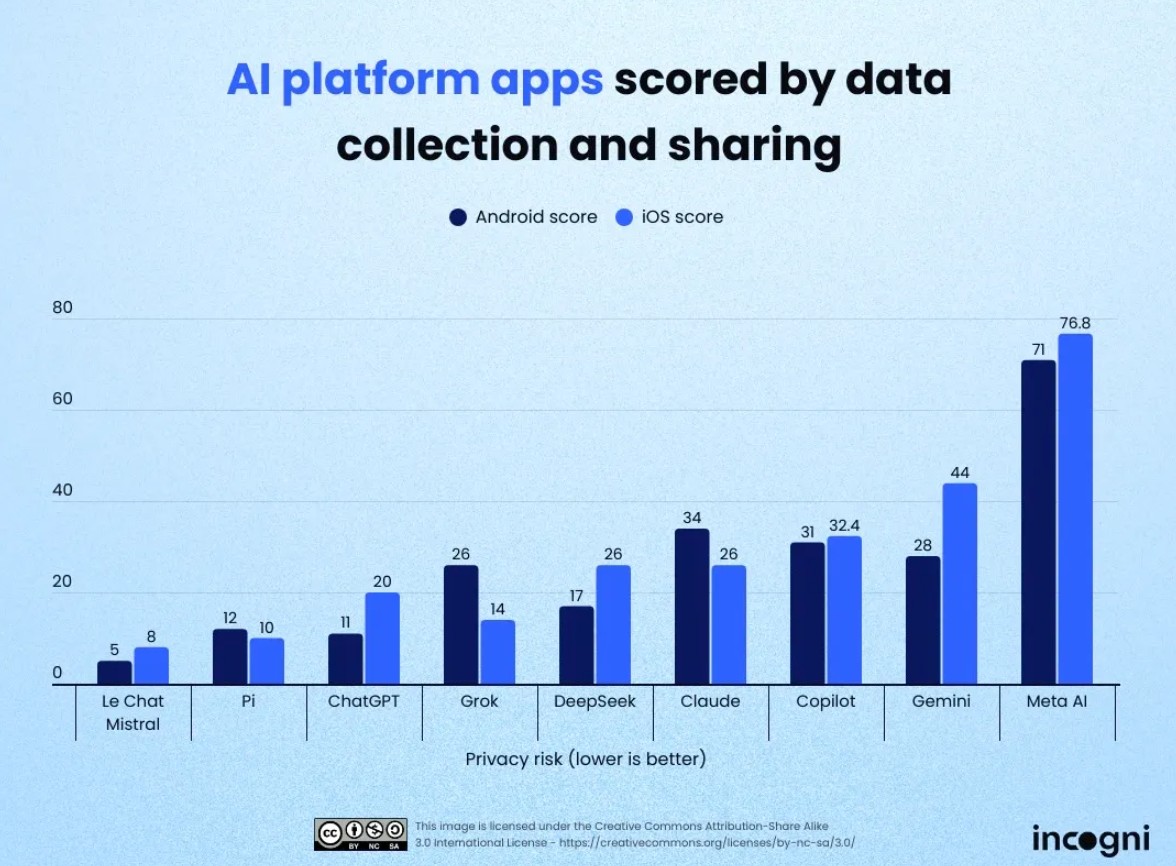

Szczegółowa analiza aplikacji mobilnych tych platform ujawniła kilka interesujących faktów:

- Gemini i Meta AI zbierają precyzyjne dane lokalizacyjne i adresy.

- Gemini, Pi i DeepSeek wymagają numerów telefonów.

- Meta AI gromadzi nazwy użytkowników, adresy e-mail i numery telefonów.

- Grok chce uzyskać dostęp do zdjęć udostępnianych przez użytkownika oraz interakcji z aplikacjami na Androidzie.

- Claude zbiera interakcje z aplikacjami stron trzecich na Androidzie, a także adresy e-mail i numery telefonów.

Pełne badanie, wraz z dodatkowymi wykresami, jest dostępne na blogu Incogni, z którym warto się zapoznać, a potem poświęcić chwilę na przejrzenie ustawień prywatności w aplikacjach AI, z których korzystasz na swoim smartfonie, zarówno na systemie iOS, jak i Android.