Instant kontra Thinking. Co oferuje ChatGPT Images 2.0?

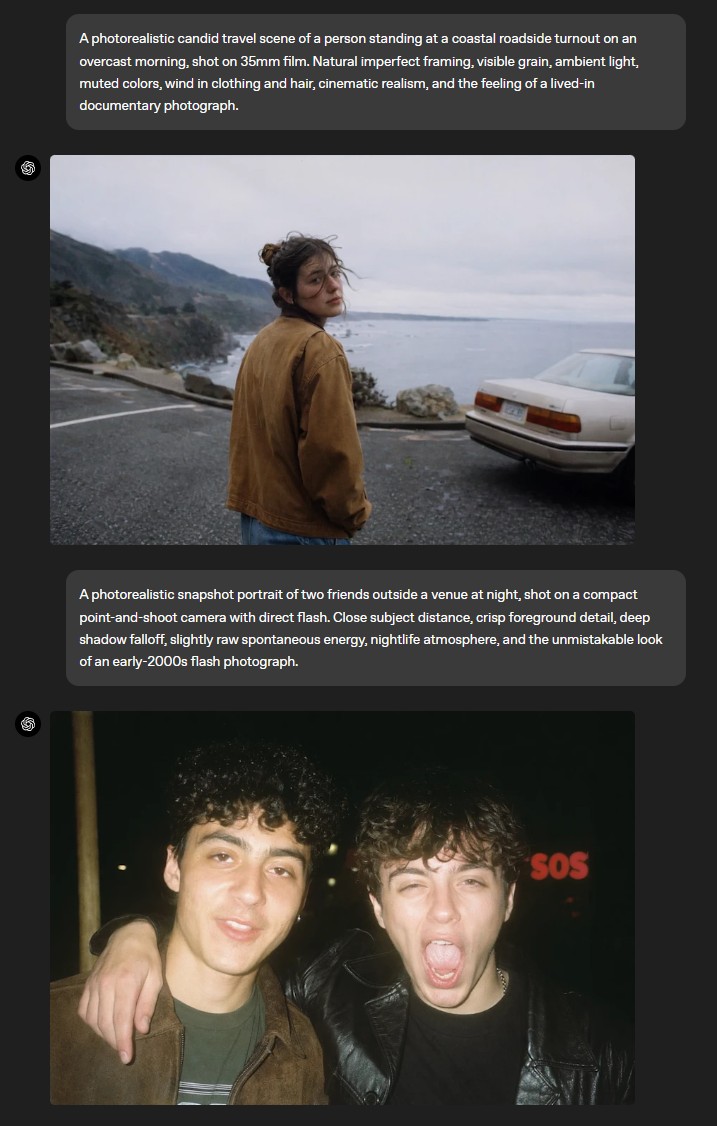

Użytkownicy, korzystający z AI, mają różne potrzeby. Jedni wykorzystują sztuczną inteligencję do rozrywki, inni z kolei do pracy albo do nauki. OpenAI dobrze zdaje sobie z tego sprawę, dlatego podzieliło model Images 2.0 na dwa odrębne warianty. Pierwszy z nich, Instant, skupia się na szybkości. To model, który był wcześniej testowany pod kryptonimem „duct tape” i ma służyć do błyskawicznego tworzenia wysokiej jakości wizualizacji bez zbędnego czekania. Jest on dostępny dla wszystkich użytkowników ChatGPT, w tym tych korzystających z darmowej wersji.

Prawdziwa rewolucja kryje się jednak w trybie Thinking. To model dedykowany profesjonalistom (Plus, Pro, Business), który zamiast generować obraz natychmiast, najpierw „rozważa” zadanie. Dzięki temu ChatGPT Images 2.0 potrafi:

- Łączyć się z siecią – model przeszukuje internet w poszukiwaniu aktualnych informacji, by wygenerować obraz zgodny z rzeczywistością (np. aktualny wygląd konkretnego miejsca lub produktu).

- Weryfikować własne wyniki – AI potrafi sprawdzić, czy wygenerowany obraz jest zgodny z promptem i nanieść poprawki przed wyświetleniem go użytkownikowi.

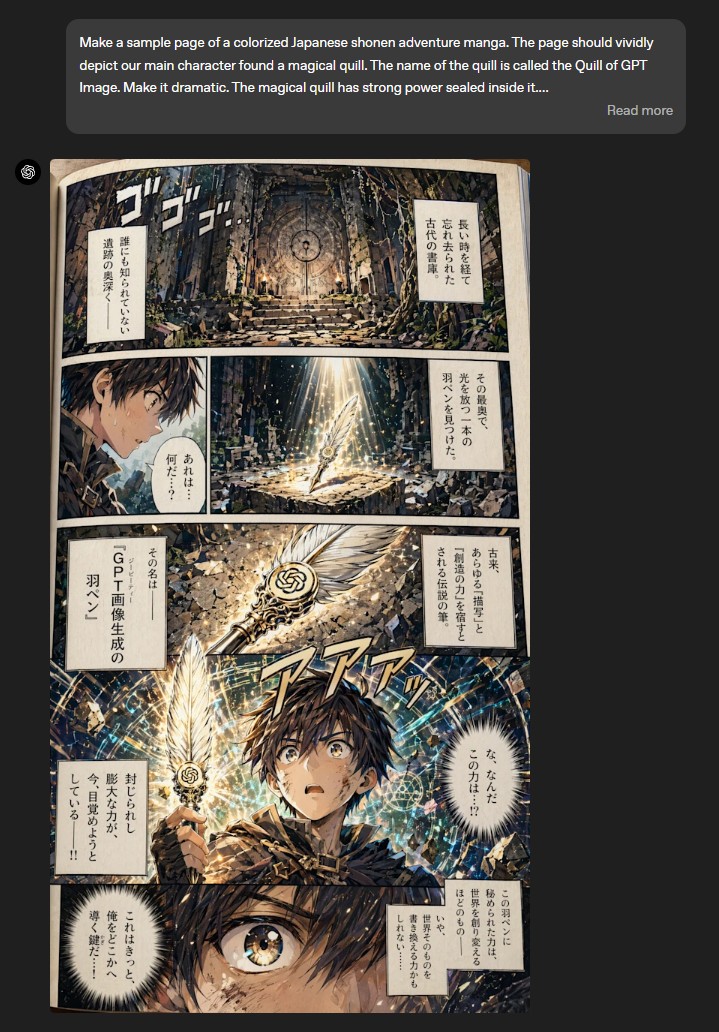

- Zachować spójność postaci – to przełom dla twórców komiksów, mangi czy storyboardów – tryb Thinking pozwala na utrzymanie tych samych bohaterów w różnych scenach.

Koniec z „krzaczkami” i dziwnym tekstem

Nie da się ukryć, że największą bolączką generatorów obrazów od zawsze było renderowanie tekstu. Images 2.0 zdaje się ten problem rozwiązywać. Podczas prezentacji pokazano, jak model bezbłędnie generuje interfejsy systemów operacyjnych (np. macOS) czy okna czatu z czytelnym, poprawnym tekstem. Co więcej, OpenAI znacząco poprawiło obsługę alfabetów niełacińskich – teraz znaki chińskie, japońskie, koreańskie, hindi czy bengalskie są renderowane z niespotykaną wcześniej wiernością.

Model stał się również bardziej elastyczny pod względem technicznym. Wspiera rozdzielczość do 2K oraz niezwykle szerokie spektrum proporcji obrazu – od ultra-panoramicznych 3:1 po pionowe 1:3. Dzięki temu narzędzie to staje się realną pomocą w projektowaniu interfejsów (UI), tworzeniu ikonografii czy gęstych, skomplikowanych kompozycji graficznych, gdzie każdy detal ma znaczenie.

Czytaj też: Od luźnego szkicu do gotowego kodu. Claude staje się projektantem

Innowacją jest także interaktywność. OpenAI odchodzi od modelu „wpisz prompt i czekaj”. Teraz z obrazem można „rozmawiać” – prosić o zbliżenie na detal, zmianę kompozycji czy dodanie elementu bez konieczności generowania całości od nowa. Model pamięta kontekst zmian, co pozwala na iteracyjną pracę nad projektem, aż do uzyskania idealnego efektu. To z kolei na pewno oszczędzi nam wielu nerwów, które się pojawiały, gdy ChatGPT, mając zmienić tylko jeden detal, nagle tworzył nam zupełnie nowe grafiki.

Źródło: OpenAI