MLPerf składa się z testów polegających kolejno na rozpoznawaniu obrazów, segmentacji obrazów medycznych, wykrywaniu obiektów, rozpoznawaniu mowy, przetwarzaniu języka naturalnego, rekomendacji oraz uczeniu wzmacniającym. Wykrywanie obiektów jest testowane w dwóch różnych formach, dlatego testów jest łącznie osiem. Wśród uczestników corocznej rywalizacji znajdują się produkty pochodzące od 21 firm i instytucji.

Sztuczna inteligencja jest szkolona szybciej nie tylko dzięki rozwojowi sprzętu

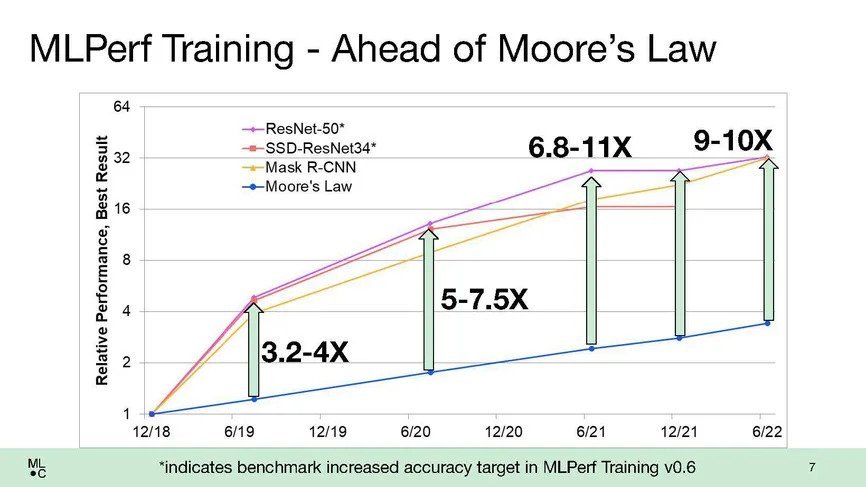

Prawo Moore’a zakłada, że liczba tranzystorów w mikroprocesorach podwaja się średnio co 24 miesiące. W tym kontekście tak imponujący postęp może się wydawać niemożliwy, jednak należy mieć na uwadze, że odnotowany wzrost jest w dużej mierze pokłosiem innowacji z zakresu oprogramowania i systemów.

Czytaj też: Procesory graficzne w służbie badań nad połączeniami w ludzkim mózgu

Jeśli chodzi o wspomniane testy, to w czołówce znalazły się systemy oparte na procesorach graficznych Nvidia A100. Nowa tego typu architektura od firmy Nvidia, Hopper, została zaprojektowana z myślą o przyspieszeniu procesu szkolenia. Nie zdołała się jednak załapać na obecne zestawienie, choć można się spodziewać, że w kolejnych będzie potencjalną dominatorką.

Z kolei TPU v4 od Google, składający się z 4096 układów scalonych, był w stanie ukończyć testy z zakresu rozpoznawania obrazów i przetwarzania języka naturalnego w nieco ponad 10 sekund. Pojawiły się również pierwsze wyniki dotyczące wydajności komputerów zawierających procesor Bow IPU, który względem poprzednich wersji może pracować nawet o 40 procent szybciej, zużywając przy tym 16 procent mniej energii.

Czytaj też: Sztuczna inteligencja przewiduje przestępstwa zanim do nich dojdzie

Ogólnie rzecz biorąc układy doświadczyły wzrostu wynoszącego 26-31% w rozpoznawaniu obrazów i 36-37% w przetwarzaniu języka naturalnego. Jeśli jednak wierzyć przedstawicielom Graphcore, na tym nie koniec. W planach jest między innymi stworzenie IPU (procesora dla infrastruktury), który miałby stanowić jeden z komponentów superkomputera znanego jako Good Computer. Miałby on być zdolny do obsługi sieci neuronowych 1000 lub więcej razy większych od obecnie stosowanych najbardziej zaawansowanych modeli językowych.