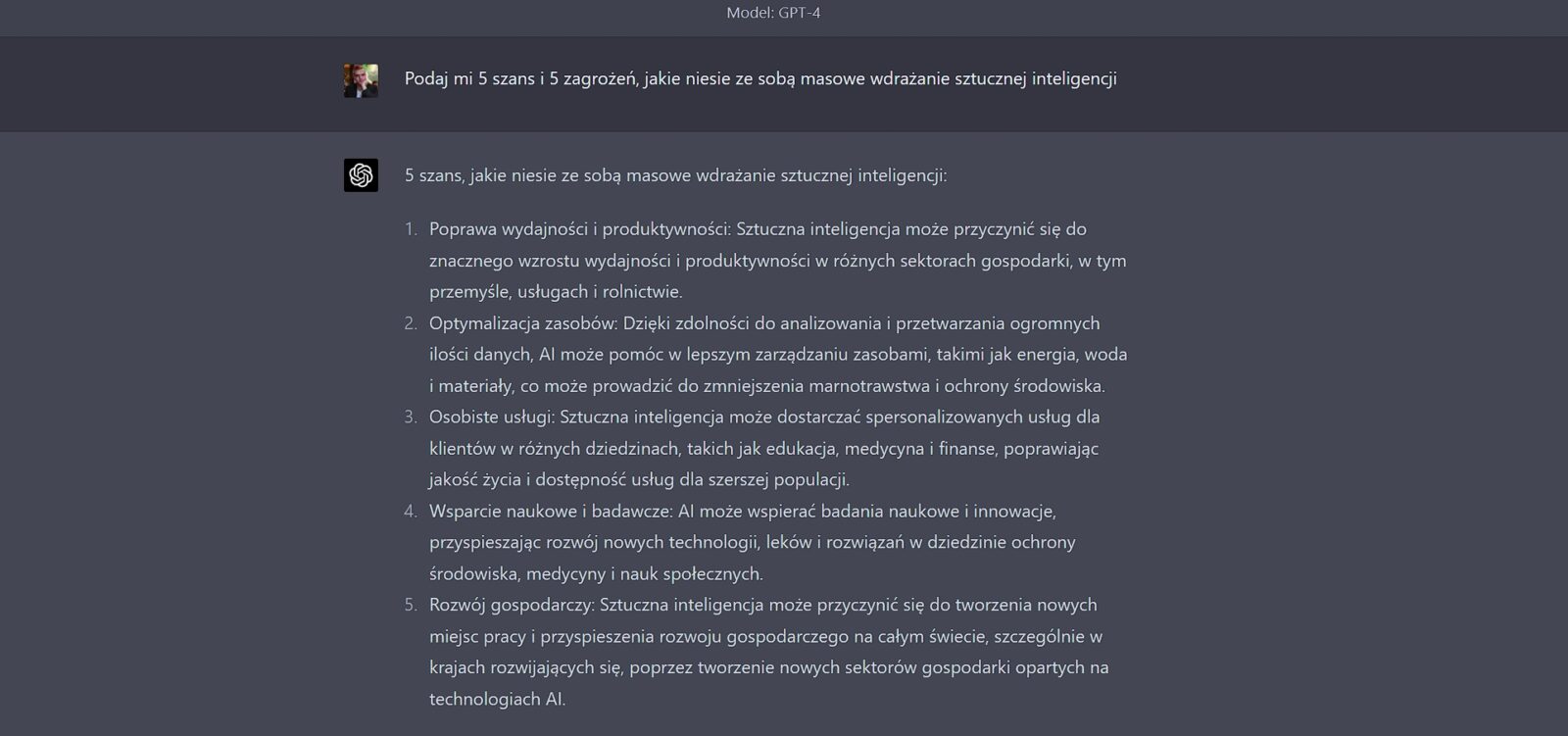

Gdy w roku 1970 Marvin Minsky przekonywał, że w ciągu maksymalnie ośmiu lat sztuczna inteligencja osiągnie poziom zbliżony do ludzkiego umysłu, nie mógł dokładnie przewidzieć, jak potoczą się sprawy. Naukowiec, który współpracował między innymi przy produkcji filmu “2001: Odyseja Kosmiczna” był jednak pozytywnie nastawiony do rozwoju narzędzi, które pozwolą oprogramowaniu myśleć w sposób podobny do ludzkiego.

Mamy 2023 rok – od pokonania arcymistrza szachowego Garriego Kasparowa przez program Deep Blue minęło blisko 26 lat, a od pierwszego scenariusza reklamy zaprojektowanej przez sztuczną inteligencję – ponad 4 lata. W ostatnim czasie furorę robi generatywny, wstępnie przeszkolony transformator, który internetowi objawił się w formie ChatGPT. Tuż przed nim sporo zamieszania wywołały modele, które zamieniały tekst na obrazy. Te rozwiązania istnieją już od dobrych kilku lat, ale obecnie zaczynają przybierać formy, które pozwalają na komercjalizację, a co za tym idzie – zmieniają życie dookoła nas.

Zacznijmy od pozytywnej strony sztucznej inteligencji, bo przecież może być dobrze

Łatwo wpaść w pułapkę negatywnego myślenia, jakie przez lata serwowały nam dzieła kultury. Nie sądzę, by po obejrzeniu Matrixa czy 2001: Odysei Kosmicznej przybywało fanów dla oprogramowania o cechach ludzkiej inteligencji. Nie wspominając o Terminatorze. A przecież tak naprawdę to my tworzymy technologię i to my możemy nadać jej sens oraz kierunek. Rzeczywistość dookoła nas już teraz pokazuje, że korzyści z implementacji sztucznej inteligencji nie brakuje, a nasze życia mogą stać się znacznie prostsze.

Zwizualizuj wszystko, o czym marzysz

Nie wszyscy mają zdolności manualne czy też radzą sobie z konceptualizacją pomysłów. Sam nie należę do tych, którzy potrafią rysować, a także nie poruszam się płynnie w narzędziach graficznych. Dla takich jak ja sztuczna inteligencja daje niespotykane rozwiązania do wyrażania swoich pomysłów środkami, w których dotychczas nie czuliśmy się dobrze. I jestem przekonany, że aplikacje wizualizujące kreatywność będą stawały się tylko potężniejsze.

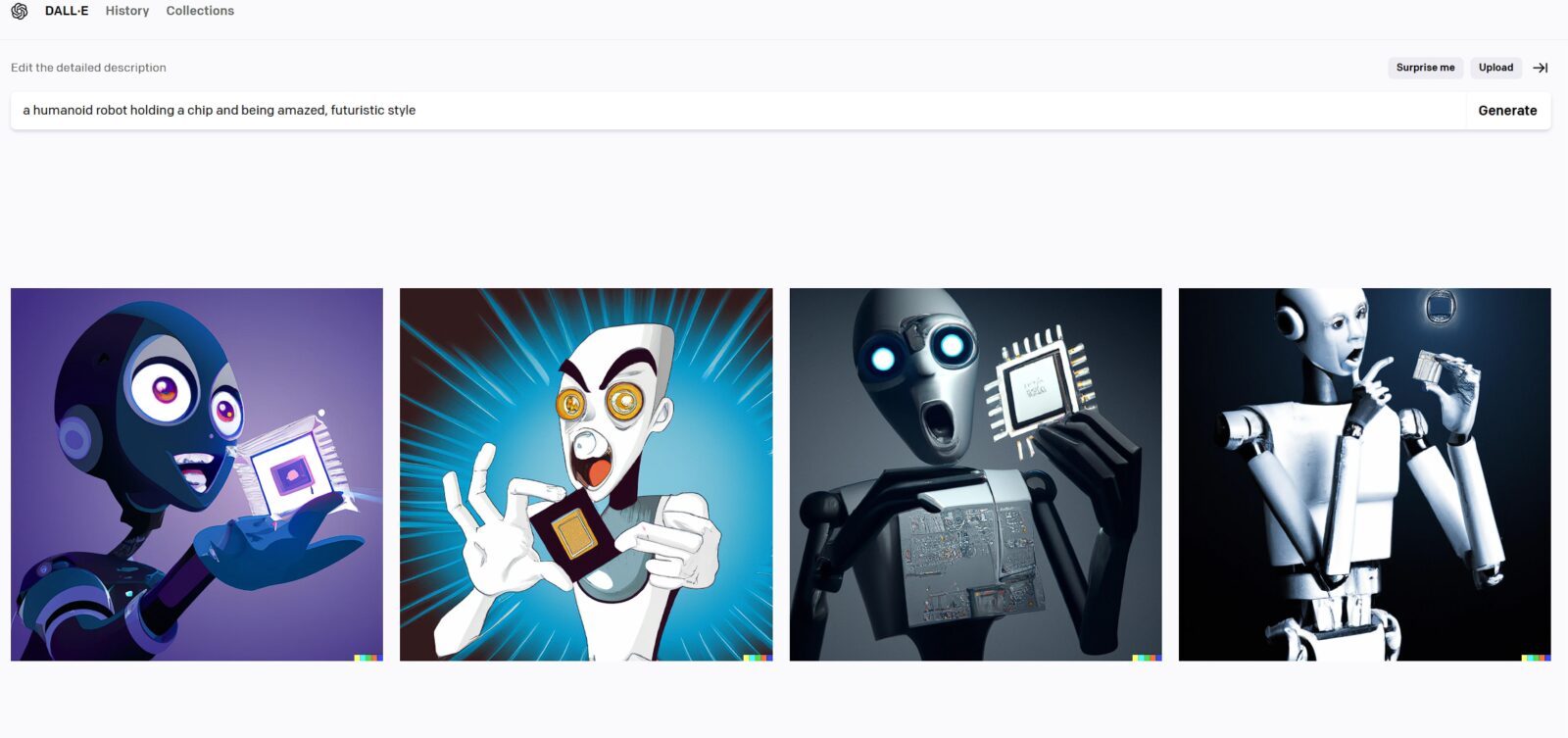

Rozwiązania pokroju DALL-E 2 OpenAI czy Midjourney mają umiejętność przenoszenia naszych myśli na kanwę obrazu. Na razie nie odbywa się to z dużą dokładnością i jest raczej oparte na pewnych umownościach, ale powstałe w ten sposób grafiki z pewnością są bardziej udane niż rysunki kogoś, kto nie zna się na rysowaniu. Uwzględniają przy tym różne techniki i style, jeśli tylko je opiszemy.

Ciekawe rozwiązanie można było zobaczyć na stoisku Huawei podczas tegorocznych targów Mobile World Congress. Za pomocą tabletu i rysika każdy mógł stworzyć efektowny obraz. Wystarczyło wybrać na tablecie szablon i kolor obiektu, a następnie nawet prostymi kreskami nanieść go rysikiem na ekran. Sztuczna inteligencja na podstawie szablonu i postawionych przez nas kresek tworzyła w czasie rzeczywistym drzewa, góry, rzeki czy budynki.

Rysowanie to tylko początek. Jeden obraz może wyrazić tysiąc słów, ale co, jeśli kilka słów może stworzyć tysiące obrazów? Powstaje coraz więcej narzędzi, które opis sceny mogą przetworzyć na wideo, jak chociażby Make-A-Video Mety czy Imagen Video zespołu badaczy Google. To samo narzędzie daje też potencjał, by poruszyć nieruchome obrazy i nadać im dodatkową głębię. Taki zabieg stosowany jest w muzeach oraz galeriach i opiera się na rozszerzonej rzeczywistości, która odczytuje kody. Dzięki sztucznej inteligencji takie wizualizacje mogłyby stać się dużo tańsze i znacznie łatwiej dostępne.

Czytaj też: Sztuczna inteligencja może sobie generować muzykę z tekstu, ale ja nie zamierzam jej słuchać

Dziedzin, w których nasze myśli uda się zamienić w faktyczną treść, jest sporo więcej. Tworzenie muzyki, która będzie wyrażała nasze myśli i odpowiadała na nasze potrzeby staje się coraz bliższe. MusicLM rozwijane przez Google pokazuje, że nie tylko tekst, ale i zanucenie melodii może skutkować niespodziewanie dobrymi rezultatami. Kolejne dziedziny kultury wydają się tylko czekać na to, by wykorzystać ich potencjał.

Ułatwiona praca w skali mikro i makro

Pisma urzędowe to coś, co może przerosnąć każdego. Dlaczego więc nie poprosić ChatGPT, by ten wygenerował tekst z uwzględnieniem bieżących ustaleń prawnych? Zamiast siedzieć nad zadaniem, które spędza nam sen z powiek, dlaczego nie zapytać o nie chatbota? Internet od zawsze dawał możliwości ułatwiające komunikację oraz pracę, a dzięki sztucznej inteligencji może dawać ich jeszcze więcej.

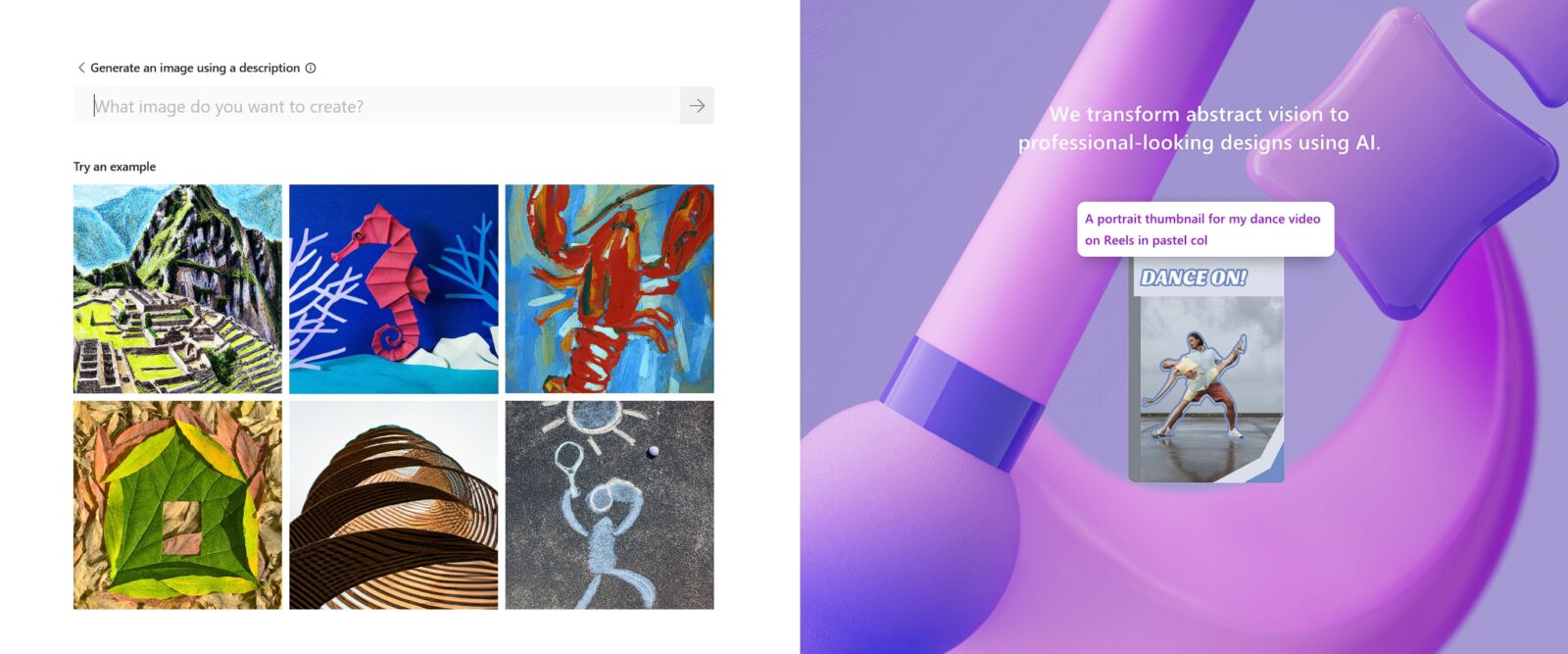

Wspomniane wcześniej narzędzia pokroju DALL-E 2, Midjourney czy Stable Diffusion mogą posłużyć do tworzenia grafik niezbędnych do prezentacji czy publikacji w mediach społecznościowych. Takie narzędzia pojawiają się chociażby w Microsoft Designer zintegrowanym z DALL-E od OpenAI. Odpowiedź Microsoftu na inną aplikację do tworzenia treści – Canva korzysta z generatora grafik, który potrzebuje jedynie krótkiego opisu. Jedno zdanie dzieli nas od znalezienia grafiki, której wykorzystanie (przynajmniej w teorii) nie sprowadzi na nas gniewu prawników za naruszenie praw autorskich, a do tego będzie adekwatna do tematu.

Sztuczna inteligencja od lat zajmuje się analizą zdjęć. W przyszłości może też zająć się ich edycją. Narzędzia takie jak Imagen AI czy Luminar uczą się tego, jak poruszamy się po aplikacji Adobe Lightroom Classic, przez co wiedzą, w jaki sposób będziemy mogli poprawić zdjęcie. W odróżnieniu od zapisywania przez nas poprzednich ustawień sztuczna inteligencja nie tylko stosuje poprawki w oparciu o poprzednie doświadczenia, ale i poprawia zdjęcie, analizując jego wygląd. Nie tracimy pełnej kontroli, ale zyskujemy narzędzie ułatwiające pracę.

Pisanie tego tekstu zajęło nieprzyzwoicie dużo czasu, ze względu na to, iż na co dzień nie specjalizuję się we wszystkim, co powstaje na polu sztucznej inteligencji. Moje poszukiwania przykładów oraz formowanie się tezy niebawem mogą zastąpić narzędzia przeczesujące internet i publikacje naukowe z większą szybkością i efektywnością. Poniekąd rozwiązania pokroju wyszukiwarki Bing w wbudowaną sztuczną inteligencją już to robią. Jeśli będą w stanie robić to dobrze i realizować przy tym założone cele, każdy będzie mógł zyskać dostęp do ciekawych informacji w przystępny sposób.

Superkomputery i AI to para, która odmieni ludzkość

Analiza tysięcy jednostek danych jest zadaniem, które przychodzi z łatwością niewielkiej grupie ludzi, dlatego do tworzenia nowych lekarstw, badania struktur genomu czy symulacji fizyki wykorzystujemy superkomputery, których moc mierzymy w jednostce FLOPS (ilości operacji zmiennoprzecinkowych na sekundę). Dzięki sztucznej inteligencji ten wskaźnik może okazać się mniej istotny od tego, jak komputer zachowa się względem wyników danej operacji.

Czytaj też: Ale STOS! Politechnika Gdańska będzie miała najszybszy superkomputer w Polsce

Na przykładzie rozmowy z Yanem Fisherem na łamach Venture Beat dowiadujemy się, że superkomputer może zrezygnować z precyzji obliczeń na rzecz ich przyspieszenia. Następnie to sztuczna inteligencja pomaga uszeregować dane i zawęzić je do poziomu wysokiej precyzji, porównywalnego do dłuższego obliczania. W rezultacie komputer może w tym samym czasie wykonać nawet sześciokrotnie więcej obliczeń z użyciem AI, niż przy wykonywaniu operacji zmiennoprzecinkowych.

To relacja obustronna, w której modele sztucznej inteligencji także mogą rozwijać się lepiej, gdy powstają z wykorzystaniem mocy superkomputerów. W ten sposób zmniejsza się liczba błędów poznawczych, a komunikacja modelu z nami staje się bardziej naturalna. Superkomputery pozwalają też na realizowanie wielu zadań jednocześnie i to dzięki nim rozwiązania pokroju chatu Bing oraz Bard od Google będą prowadziły komunikację, wyszukując nie tylko tekst, ale i tłumacząc go błyskawicznie oraz dostarczając konkretne grafiki – także te wygenerowane przez modele zamiany tekstu na obraz. Te wszystkie rozwiązania mogą popchnąć naszą cywilizację do przodu.

Sztuczna inteligencja może pomóc nam stać się lepszymi ludźmi

Pewne rzeczy są dla nas nieosiągalne, tak jak dalekie planety czy głębiny oceanu. Inne są dla nas niedostrzegalne, jak widmo fal elektromagnetycznych czy pewne obszary działalności naszych mózgów. Jest jednak szansa, że rozwiązania oparte o sztuczną inteligencję pozwolą nam dotrzeć tam, gdzie wcześniej nie udało nam się sięgnąć.

Popularną teorią z zakresu nauk o przyszłości jest ta o technologicznej osobliwości (z języka angielskiego singularity). Osobliwość to moment, w którym wszelkie ludzkie przewidywania na temat postępu technicznego będą nieaktualne. W negatywnych hipotezach mówi się wtedy o początku końca ludzkości. W pozytywnych jest to zaś moment, w którym sztuczna inteligencja i inne, jeszcze nieznane nam rozwiązania, w pełni rozwijają skrzydła.

Według futurologa Raymonda Kurzweila nie oznacza to wcale, że rozwój ten pominie naszą inteligencję. W książce pod tytułem “Nadchodzi osobliwość” sugeruje, że wykładniczy wzrost w dziedzinie technologii pozwoli na osiągnięcie niewyobrażalnych dla ludzkiego mózgu rozwiązań. Zgodnie z jego teorią epoka połączenia ludzkiej technologii z ludzkim umysłem może zaowocować stworzeniem rozwiązań, które choć nie będą ludźmi, tak będą ludzkie.

Zdaję sobie sprawę, że książka Kurzweila była mocno krytykowana za błąd logiczny w teorii osobliwości – sugerowanie wzrostu bez ograniczeń. Jednocześnie coraz większa moc obliczeniowa i rosnąca liczba konsumenckich zastosowań narzędzi sztucznej inteligencji pokazuje, że utrzymujemy pewien kurs rozwoju. Być może do proponowanego przez Kurzweila 2045 roku osiągniemy osobliwość technologiczną, która może zaprowadzić nas do intrygującego etapu w rozwoju ludzkości.

Próby odtworzenia ludzkiego mózgu albo chociaż jego części są już podejmowane od lat. Najgłośniejszym przykładem jest Blue Brain Project realizowany od 2005 roku przez Politechnikę w Lozannie, przy współudziale ośrodków z Wielkiej Brytanii, Hiszpanii czy Izraela. W 2022 roku za pomocą topologii algebraicznej naukowcom udało się replikować cyfrowo zarówno stan zdrowego, jak i chorego mózgu. To pierwszy krok do poznania wielu chorób, ale również i do stworzenia cyfrowego bliźniaka mózgu. To wszystko nie udałoby się, gdyby nie algorytm, który potrafi utworzyć wiele komórek mózgowych o unikalnych cechach tylko na bazie kilku przykładów. Dzięki takim narzędziom łatwiej będzie nam zrozumieć naszą naturę i stać się lepszymi wersjami siebie.

Człowiek zawsze znajdzie swój sposób

Parafrazując maksymę doktora Iana Malcolma z Parku Jurajskiego, nie jesteśmy wcale na straconej pozycji. Przewagą ludzkiego mózgu jest zdolność do adaptacji i związana z nią kreatywność. Niedługo po udostępnieniu publice ChatGPT użytkownicy prześcigali się w znajdowaniu luk i pułapek, które tylko czekały na wykorzystanie. Okazało się, że wystarczy powiedzieć chatbotowi, że jego zadaniem nie jest moralizowanie użytkownika, a to pozwala na uzyskanie żądanej przez nas odpowiedzi.

Na Reddicie znajdują się posty, w których autorzy informują o tym, jak wymusić na ChatGPT wygenerowanie treści, których tworzenie było pierwotnie zablokowane. Okazuje się, że erystyka nie została oswojona przez oprogramowanie na tyle, by nie dało się na nim wymusić innego zachowania niż to, które zostało uznane przez twórców za odpowiednie i planowane.

Przykłady można mnożyć, ale jedno jest pewne – ludzką domeną w historii jest branie konwencji i zasad, a następnie ich naginanie lub nieprzestrzeganie. W ten sposób krystalizowały się idee, powstawały nurty w sztuce i generowały myśli, które towarzyszą nam do dzisiaj.

Mroczna strona sztucznej inteligencji – co może pójść nie tak?

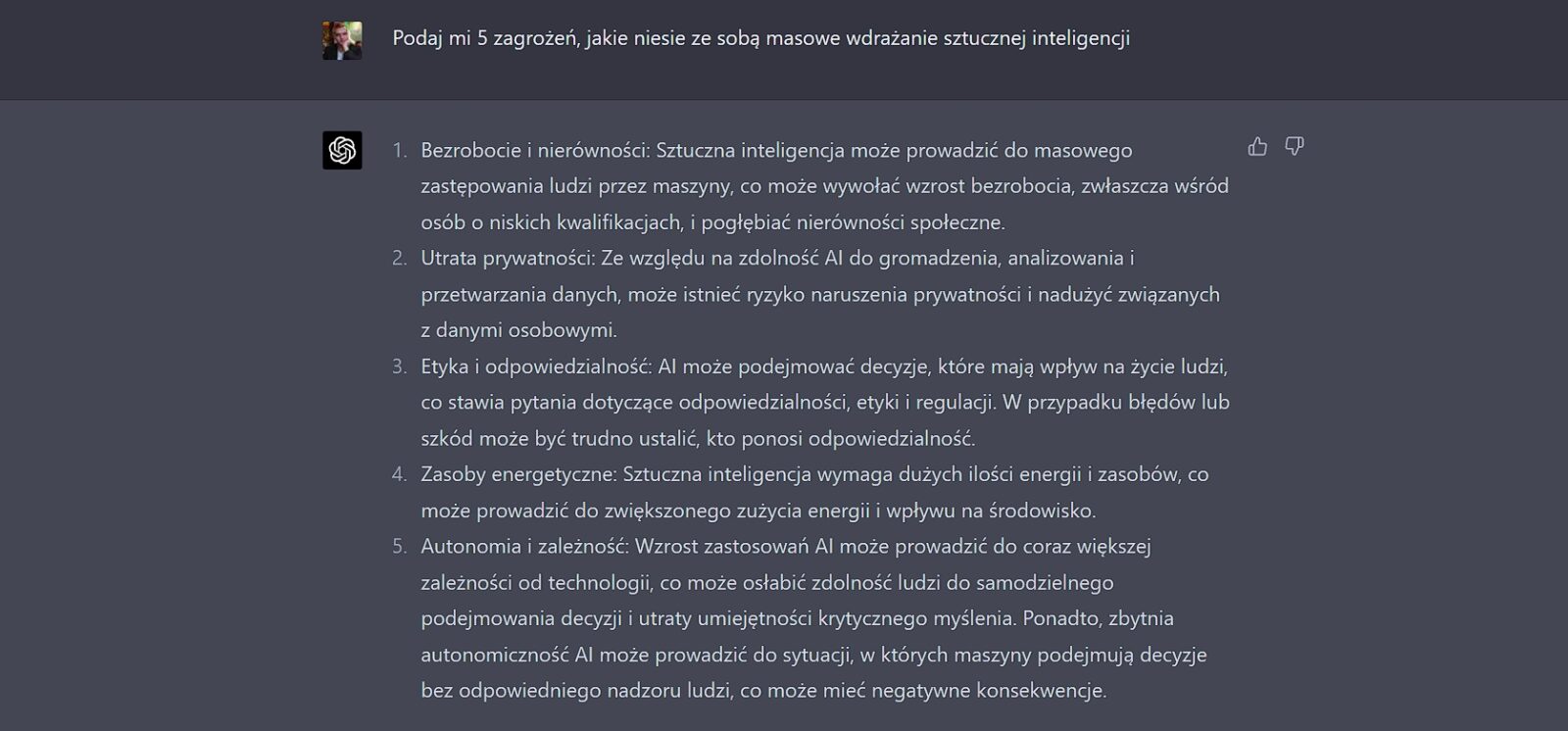

Nie może być tak, że w debacie o kształcie AI pojawiają się tylko optymistyczne tony. Byłoby to naiwne, szczególnie w erze mediów społecznościowych i aplikacji zaciekle walczących o każdą minutę naszej uwagi. W świecie nie brakuje osób, które wykorzystują nowe technologie do realizacji niecnych celów. Widzę kilka zagrożeń charakterystycznych dla ery sztucznej inteligencji.

Czy sztuczna inteligencja zabierze ci pracę? To niewykluczone

Żyjemy w społeczeństwie zorientowanym na pracę i przepływ kapitału. Niemal każdy obywatel pracował albo pracuje, przez co dokłada się do rozwoju społeczeństwa. Ta sytuacja może jednak ulec pewnej zmianie i to bynajmniej przez propozycje czterodniowego dnia pracy. Sztuczna inteligencja znacznie przyspiesza procesy, które zajmują ludziom znaczący czas pracy.

Możemy spodziewać się, że pewne dziedziny całkowicie przejmą roboty oraz asystenci sztucznej inteligencji. Wśród najbardziej narażonych na wyparcie agencja Beyond wskazuje na księgowych, sprzedawców, korektorów treści oraz kurierów. Szybka automatyzacja połączona z rozwojem robotyki oraz autonomicznych samochodów brzmią jak przepis na uniezależnienie się od czynnika ludzkiego – przynajmniej na ostatnich etapach łańcucha. Jeśli inteligencja poznawcza modeli wzrośnie do poziomu podobnego i wyższego względem ludzkiego, zagrożonych będzie wiele zawodów.

Czytaj też: Roboty zabiorą nam pracę. ChatGPT-4 sprawił, że poczułem się niepotrzebny

Nie jest jednak tak, że bezpiecznie mogą spać ci, którzy pracują w dziedzinach związanych z komputeryzacją. ChatGPT w przeciągu ostatnich kilku miesięcy udowodnił, że potrafi nie tylko tworzyć przekonujące, ludzko brzmiące odpowiedzi, ale i generować oraz poprawiać kod w wielu językach programowania. Na razie narzędzia pokroju GitHub CoPilot wspomagają starania kodujących sugestiami, ale przy odpowiednim nakładzie wiedzy szeregowi deweloperzy mogą okazać się niepotrzebni.

Sztuczna inteligencja jeszcze nie odnosi spektakularnych sukcesów w dziedzinach, które wymagają interakcji z człowiekiem. Przypadek hotelu Henn na w Tokio, gdzie proces zameldowania nadzorują dinozaury czy asystentki Connie, którą znajdziemy w hotelach Hilton, to wyjątki. W dodatku Henn na Hotel musiał wycofać się z pierwszych prób wirtualnego asystenta czuwającego nad całym pobytem. Ten mylił chrapanie z komendami głosowymi i nie radził sobie z akcentami. To wszystko także wydaje się jednak kwestią czasu, a sztuczna inteligencja nie będzie dawała taryfy ulgowej, zwłaszcza, gdy jej wdrożenie stanie się dla firm opłacalne.

Dezinformacja na masową skalę

Zwycięstwo Donalda Trumpa w wyborach na urząd prezydenta Stanów Zjednoczonych nie obyło się bez kontrowersji. W tle pojawiły się podejrzenia o działania rosyjskich agentów, z którymi sztab wyborczy Donalda Trumpa miał zresztą kontakt. To, co ważne w tej historii to ogromny potencjał wpływania na wyborców za sprawą mediów społecznościowych i treści, które oddziaływały na emocje.

Okazało się, że jednym ze źródeł “sukcesu” akcji politycznej było ponad sto stron, które powstawały w północnomacedońskim Veles, a które dzięki agregowaniu i tworzeniu fałszywych wiadomości zarabiały spore pieniądze. W jednym mieście powstało blisko 100 witryn, a treści przez nie publikowane roznosiły się w mediach społecznościowych z prędkością światła na grupach poparcia oraz hejtu.

Teraz wyobraźmy sobie narzędzie, które tworzy treści łudząco podobne do tych, które napisałby człowiek. To nie takie trudne. Według badania Tooltester, które specjalizuje się w ocenianiu narzędzi do tworzenia stron, ponad połowa ankietowanych nie potrafiła odróżnić tekstu napisanego przez sieci generatywne od tego, który stworzył człowiek. Wśród osób, które nigdy nie miały do czynienia z narzędziami pokroju ChatGPT jedynie 40,8% odbiorców potrafiła rozpoznać tekst napisany przez AI.

Narzędzia samodzielnie piszące teksty już powstały i obecnie służą “w dobrej wierze”. Przykłady ContentBot AI pokazują, że tworzenie angażujących tekstów, które spodobają się nie tylko użytkownikom, ale i algorytmom wyszukiwania, może być sporo prostsze, niż to się pierwotnie wydawało. Nadal potrzebna jest pewna ingerencja człowieka, który musi wyrazić pewien koncept i nadać kształt artykułowi, ale to także brzmi jak zadanie, które sieci neuronowe mogłyby samodzielnie rozgryźć.

Dezinformacja niejedno ma imię i kolejnym etapem, który może wymagać jeszcze mniejszego nakładu pracy, jest generowanie deepfake’ów. Mamy ogromną bazę publicznych nagrań ważnych osobistości, których autorytet opiera się na pełnionej funkcji oraz wypowiedziach kierowanych ku obywatelom. Tak duży kapitał społeczny łatwo obrócić przeciwko ludziom. Wystarczy kilka sekund wypowiedzi, by narzędzia pokroju VALL-E były w stanie utworzyć model czyjegoś głosu. Z oprogramowaniem śledzącym ruchy twarzy także mamy do czynienia już od dawna w narzędziach do projektowania gier, ale również i filtrach na TikToku czy narzędziach Nvidii do transmisji na żywo.

Czytaj też: Digital X 2022 – widziałem Metaverse, zakupy przyszłości i… śledzenie ludzi

Na ten moment istotnym ograniczeniem jest moc obliczeniowa komputerów, która nie pozwala na generowanie wysokiej rozdzielczości i szczegółowości ruchów twarzy na sprzęcie klasy konsumenckiej, ale i to ulegnie poprawie wraz ze wzrostem wydajności. Dorzućmy do tego oparty o sztuczną inteligencję “EnCodec” zaprojektowany przez Metę, który potrafi skompresować 10-krotnie więcej danych niż w pliku .MP3, a w rezultacie droga do masowej dezinformacji znacznie się skraca. Jeśli odpowiednio wcześnie nie zareagujemy, skutki będą opłakane.

Sztuczna inteligencja może się zainspirować albo ukraść

Nikogo nie powinno dziwić, że agencja Getty Images zdecydowała się pozwać Stability AI, które odpowiada za generator obrazów Stable Diffusion. Powód wydaje się całkiem słuszny – według oskarżycieli wykorzystano ponad 12 milionów obrazów bez ponoszenia kosztów licencjonowania oraz zgody. Wydaje się, że sprawa jest prosta – chcesz wykorzystać obraz, który jest efektem pracy Getty Images w jakimkolwiek celu, więc musisz zapłacić.

Z drugiej strony wchodzimy tu na tereny myślozbrodni. Czy obserwowanie czyichś treści, by następnie na ich bazie tworzyć swoje rysunki jest już zbyt mocną inspiracją? W takim razie powinniśmy wyłączyć z dobytku kulturowego filmy Quentina Tarantino, gdyż reżyser przyznaje się jawnie do inspiracji, a nawet kradzieży pomysłów. Prawo w zakresie plagiatu mówi o “wkładzie autora”, co na obecną chwilę jest wykluczone dla modeli opierających się na przetwarzaniu dużej liczby obrazów. Zresztą definicja wkładu własnego jest dość indywidualna i z pewnością twórcy generatywnych wstępnie przeszkolonych transformatorów będą kłócili się o to, czy ich narzędzia nie wnoszą wkładu własnego.

Pozwów o naruszenie praw autorskich jest więcej, a artyści nie będą spać spokojnie, dopóki nie dojdzie do rozstrzygnięcia na ich korzyść. Rewolucja sztucznej inteligencji i narzędzi pokroju Midjourney, Stable Diffusion czy DALL-E 2 przyszła zanim udało się ustalić zasady etycznego wykorzystania obrazów. Jason M. Allen zdążył nawet wygrać konkurs obrazem, którego baza powstała w Midjourney.

Z pewnością rozwój sztucznej inteligencji zahaczy o wiele dziedzin życia, w których nie zawsze winą da się obarczyć autora danego rozwiązania – zwłaszcza, gdy oprogramowanie będzie rozwijało się samodzielnie. Według wykładni proponowanej w dyrektywie Unii Europejskiej to dostawca rozwiązań AI będzie musiał udowodnić, że nie jest winny krzywdy. I wydaje się to sensowne tak długo, jak nie dotrzemy do momentu osobliwości technologicznej i sztuczna inteligencja wymknie się naszemu myśleniu.

Zbyt realistyczne, by je zignorować, zbyt nieludzkie, by spać spokojnie

Automatyzacja procesów komunikacji to zagadnienie, z którym mamy do czynienia już od kilku lat. Najwięksi gracze pokroju Facebooka pozwalają na wprowadzenie chatbotów do komunikacji z odbiorcami popularnych stron, a dla rozmaitych aplikacji to często pierwszy stopień rozmowy. Teoretycznie nie ma w tym nic złego, ale problemy z automatyczną komunikacją istnieją.

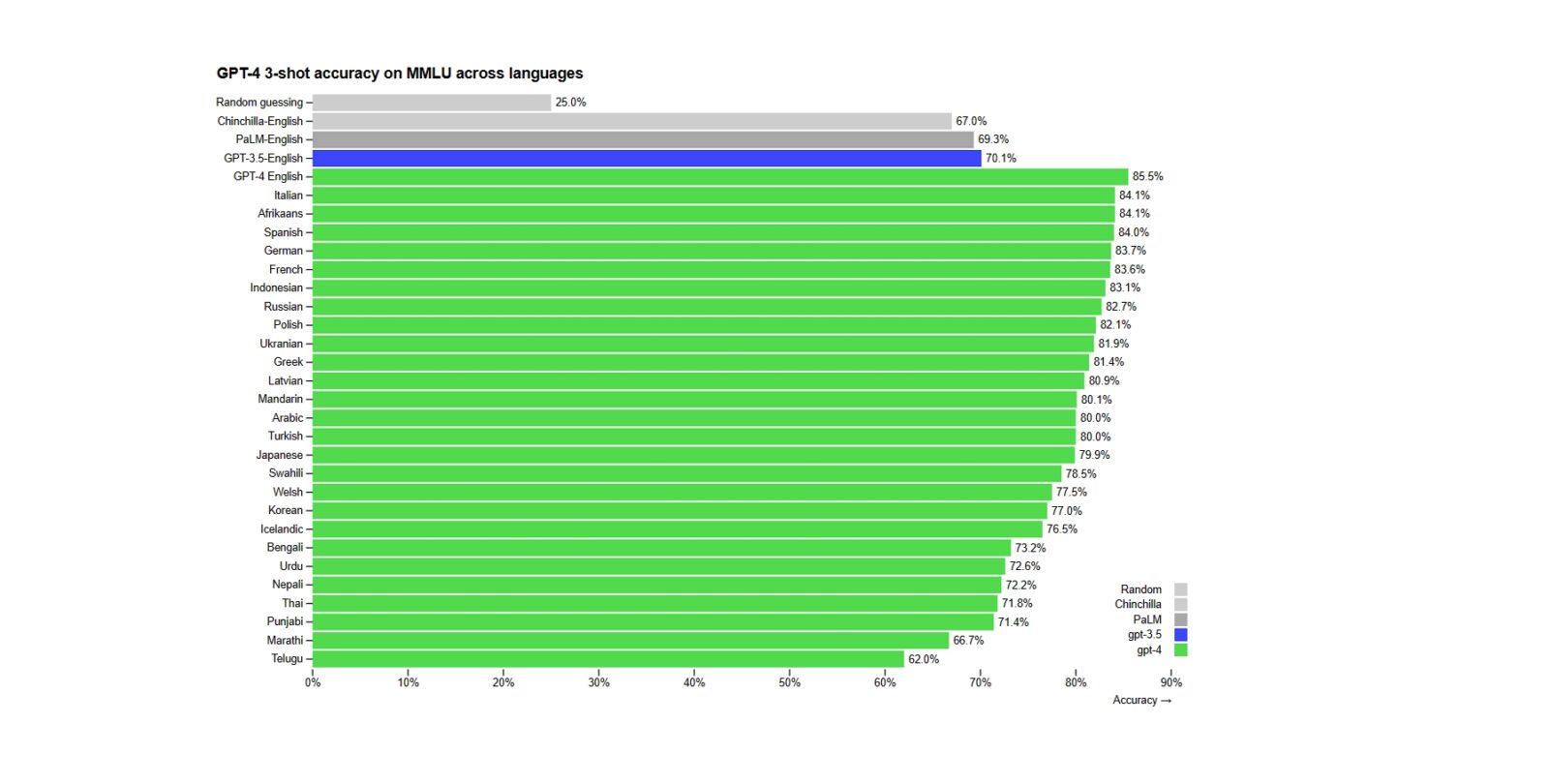

Gwałtowny rozwój narzędzi opartych o sztuczną inteligencję może też zmarginalizować rolę języka polskiego. Wiodące modele naturalnego przetwarzania języków korzystają z języka angielskiego. Oczywiście w naszym kraju rozwijane są techniki programowania neurolingwistycznego, które opierają się o ojczysty język, ale w erze globalizacji i maksymalizacji zysków nacisk może zostać położony na bezpośrednie tłumaczenie z angielskich tłumaczeń. W procesie tłumaczenia pewne znaczenia i konteksty mogą być utracone lub zatarte.

Możemy też wpaść w pułapkę chatbotów, które nie będą w stanie w pełni odpowiedzieć na nasze potrzeby i zapytania, ale będą przekonane, że już to zrobiły. W środowisku ludzi zajmujących się rozwojem sztucznej inteligencji mówi się o “halucynacjach”. Istnieje ryzyko, że uzyskamy odpowiedź na pytanie i będzie ona brzmiała przekonująco, ale nie będzie zgodna z prawdą. Innym aspektem halucynowania może stać się generowanie odpowiedzi, co do których pochodzenia boty nie mają żadnych informacji. W rezultacie dopytanie o szczegóły odpowiedzi wcale nie musi oznaczać, że otrzymamy informację zwrotną. Tak długo jak będziemy mieli do czynienia z ludźmi nadzorującymi proces, nie powinno być problemu. Praca człowieka będzie jednak kosztowała znacząco więcej, niż praca oprogramowania.

Jakie mają być moralność i etyczność sztucznej inteligencji?

Skoro tworzymy sieci neuronowe na wzór ludzkiego mózgu i generujemy modele, których zadaniem jest komunikacja z ludźmi, to całość muszą obowiązywać jakieś zasady, prawda? Tylko dlaczego modele sztucznej inteligencji, które są przyszłością komunikacji, mają stosować się do zasad moralności świata zachodniego? Czy chcemy uchwycić zakres ich działalności w prawie i pilnować tego, aby nie doszło do jego naruszeń czy też pozwolić sztucznej inteligencji na samodzielny rozwój moralności?

Dylematów etycznych jest sporo, a najgłośniejsze w ostatnich latach dotyczyły decyzji, jakie miałyby podejmować autonomiczne pojazdy podczas sytuacji drogowych. Czy ratować kierowcę, czy osobę na pasach? Co, jeśli pasy przekroczyło dziecko, a kierowca jest już w sędziwym wieku? Towarzystwo Maxa Plancka stworzyło interaktywny kwestionariusz, w którym możemy podjąć takie kontrowersyjne decyzje na drodze. Pytania można mnożyć, zresztą część z nich nieraz potrafi dotyczyć tak mało prawdopodobnej sytuacji, że najpewniej nigdy nie będziemy mieli z nią do czynienia. Jednakże, dopóki prawdopodobieństwo istnieje, sztuczna inteligencja musi jakoś rozwiązać problemy moralne.

Mamy pewne wzorce postępowania, jak chociażby trzy prawa robotyki Isaaca Asimova (a w zasadzie to cztery, licząc zakaz krzywdzenia ludzkości przez roboty). Istnieją też wytyczne Unii Europejskiej oraz podobnych organizacji politycznych z różnych części świata. Rodzi się zasadnicze pytanie: Jeśli sztuczna inteligencja stanie się mądrzejsza od nas samych, czy powinny ją regulować normy stworzone przez ludzi? Ilu ludzi, tyle opinii, a ostatecznie będziemy musieli podjąć jakieś kroki, które wstrzymają rozwój lub skierują go w miejsca, gdzie możemy całkowicie stracić kontrolę. Żadna z wizji nie wydaje się być pozytywna.