Serwis The Verge jako pierwszy odkrył tę zmianę, a przykłady generowanych przez AI tytułów są dowodem na to, że sztuczna inteligencja nie tylko jest niepoprawna, ale często popada w drętwe uogólnienia lub czysty clickbait. Co gorsza, całe to działanie odbywa się w tle, bez żadnej widocznej etykiety informującej użytkownika, że nagłówek pochodzi od Google’a, a nie od samego wydawcy.

Google podmienia nagłówki newsów w Discover na absurdalne, generowane przez AI

Firma uruchomiła test dla ograniczonej grupy użytkowników Discover, w którym zastępuje oryginalne nagłówki artykułów tytułami generowanymi przez AI. Firma twierdzi, że to eksperyment interfejsu użytkownika mający ułatwić przyswajanie informacji przez zmianę układu nagłówków. W praktyce jednak algorytm tworzy zupełnie nowe tytuły, które często nie mają wiele wspólnego z rzeczywistą treścią artykułów.

Przedstawiciel Google oficjalnie określił to jako mały test nowego projektu dla podzbioru użytkowników. Firma nie ujawniła dokładnej skali eksperymentu ani tego, jak długo planuje go kontynuować. Oświadczenie sugeruje, że w obecnej formie funkcja nie zostanie wprowadzona na szerszą skalę, co biorąc pod uwagę jakość generowanych nagłówków, wydaje się rozsądną decyzją.

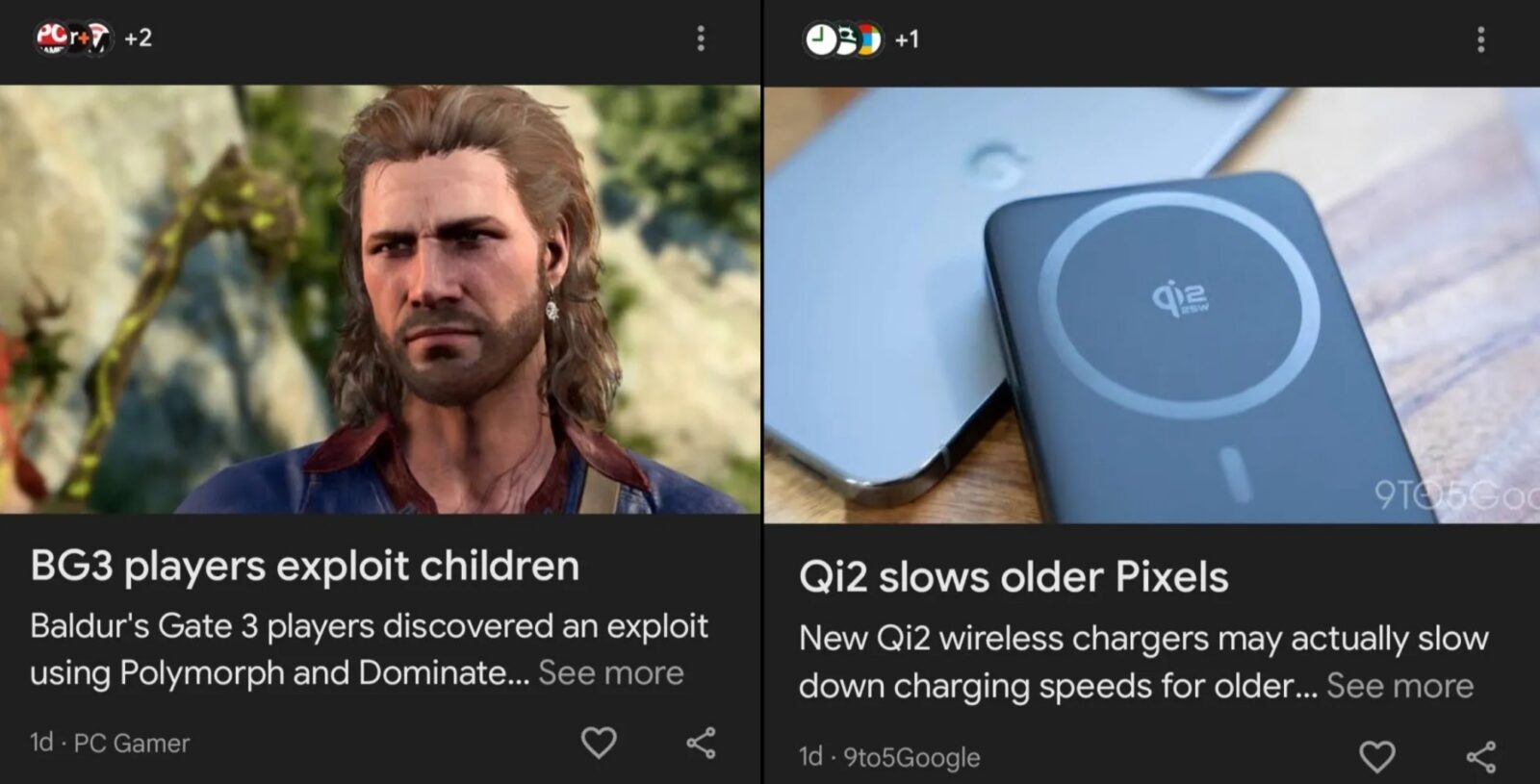

Przykłady wygenerowanych nagłówków pokazują skalę problemu

Artykuł o grze Baldur’s Gate 3, który oryginalnie nosił rozbudowany tytuł wyjaśniający mechanikę gry związaną z polimorfizmem i niemieckimi przepisami medialnymi, został przekształcony w krótkie i wprowadzające w błąd “Gracze BG3 wykorzystują dzieci”. Taki tytuł nie tylko traci cały kontekst, ale brzmi niepokojąco i może sugerować coś zupełnie innego niż zabawna mechanika w grze wideo.

Kolejny przypadek dotyczy materiału o ładowarkach Qi2, w którym autor radził, by nie przepłacać za szybsze modele. AI przekształciło ten praktyczny poradnik w nagłówek sugerujący, że standard Qi2 spowalnia starsze modele Pixeli – informację, której w artykule w ogóle nie było. Jeszcze bardziej absurdalna sytuacja miała miejsce, gdy algorytm nadał tytuł “Ujawniono cenę Steam Machine” artykułowi, który tej ceny wcale nie ujawniał.

Czytaj też: Revolut wprowadza „Tryb Uliczny”. Inteligentną tarczę chroniącą Twoje pieniądze poza domem

Problemy z generowanymi nagłówkami układają się w wyraźny wzór — albo są zbyt ogólnikowe i nudne, albo wręcz przeciwnie, zmierzają w stronę sensacyjnego clickbaitu. W obu przypadkach nie oddają treści artykułów i mogą wprowadzać czytelników w błąd.

Kto ponosi odpowiedzialność za złe tytuły?

Najpoważniejszym problemem całego eksperymentu jest brak jakiejkolwiek informacji dla użytkowników, że widzą nagłówki generowane przez AI. Nie ma żadnej etykiety ani oznaczenia, że za zmieniony tytuł odpowiada Google, a nie wydawca artykułu. W praktyce oznacza to, że czytelnicy mogą obwiniać redakcje za clickbaitowe lub wprowadzające w błąd nagłówki, których te nigdy nie stworzyły.

Czytaj też: Samsung ulepsza Bixby i daje nam pełną władzę nad Szybkim Panelem. Oto nowości, jakie wprowadzi One UI 8.5

Taka sytuacja może poważnie zaszkodzić reputacji wydawców, którzy tracą kontrolę nad tym, jak ich treści są prezentowane użytkownikom. Portal Android Authority zwrócił się do Google z pytaniami o szczegóły eksperymentu, plany szerszego wdrożenia oraz możliwość rezygnacji przez wydawców z tej funkcji. Jak dotąd nie otrzymał odpowiedzi na te kluczowe pytania.

Czytaj też: Koniec z suchym tekstem. YouTube wprowadza „Ekspresyjne Napisy”, które pokażą Ci sarkazm i westchnienia

Sama decyzja o uruchomieniu takiego eksperymentu budzi wątpliwości, szczególnie że problemy z jakością są widoczne gołym okiem. Wydaje się, że gigant z Mountain View ponownie testuje niedopracowaną funkcję na prawdziwych użytkownikach, licząc na to, że ewentualne błędy zostaną zauważone dopiero po fakcie. Tym razem jednak stawką jest nie tylko doświadczenie użytkownika, ale także reputacja wydawców, którzy mogą zostać niesłusznie obwinieni za treści generowane przez algorytm.

Czytaj też: Samsung kopiuje Apple w najlepszy możliwy sposób. Galaxy Buds 4 z błyskawicznym tłumaczem

Warto tu zauważyć, że to dość podobna sytuacja do tej, której uczestnikiem był na początku roku Apple. Po wprowadzeniu Podsumowań powiadomień opartych na AI firma znalazła się w ogniu krytyki, bo sztuczna inteligencja generowała tam bzdury, wprowadzając w błąd na temat treści od takich dostawców, jak chociażby BBC. Jednak w przypadku Google’a skala problemu jest większa, bo z Discover korzysta znacznie więcej osób. U Apple’a mowa była o konkretnych dostawcach treści, a tu – o wszystkim, co jest w kanale. Miejmy więc nadzieję, że gigant albo to naprawi, albo po prostu zrezygnuje z pomysłu i osobiście mam nadzieję, że pójdzie właśnie w tę drugą stronę.