Wokół sztucznej inteligencji najłatwiej zachwycać się kolejnymi modelami, generatorami obrazów i obietnicami coraz sprytniejszych agentów. Tyle że ten wyścig już od dawna nie rozgrywa się wyłącznie na poziomie software’u. Coraz częściej chodzi o coś znacznie mniej efektownego, ale dużo ważniejszego – o prąd, chłodzenie i to, ile energii trzeba wpakować w infrastrukturę, żeby te wszystkie cuda w ogóle działały. Międzynarodowa Agencja Energetyczna szacuje, że zużycie energii elektrycznej przez centra danych może wzrosnąć do około 945 TWh w 2030 roku, czyli ponad dwukrotnie względem obecnego poziomu. Właśnie dlatego jeden z ciekawszych ruchów w branży nie dotyczy nowego chatbota, lecz samego sposobu wykonywania obliczeń.

Co właściwie zbudowali naukowcy z Sydney?

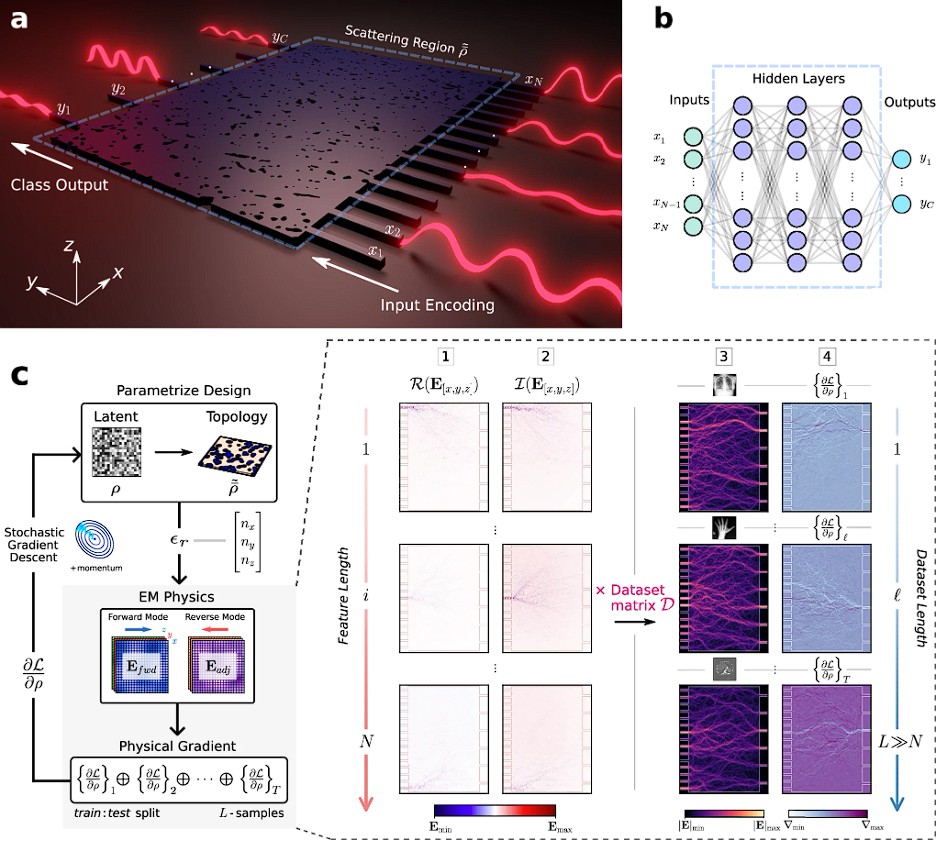

Zespół z University of Sydney pokazał fotoniczny chip do sztucznej inteligencji (artificial intelligence – AI), który nie liczy przy pomocy przepływu elektronów w klasycznych obwodach, ale wykorzystuje światło prowadzone przez nanostruktury. Najkrócej mówiąc, Australijczycy opracowali dwa bardzo małe akceleratory fotonicznej sieci neuronowej. W grę wchodzą układy o powierzchni 20 x 20 µm² oraz 30 x 20 µm², czyli odpowiednio około 0,0004 mm² i 0,0006 mm². Mówimy tym samym o strukturach tak małych, że w praktyce ich fizyczny ślad na chipie jest wręcz absurdalnie skromny. Autorzy podają też gęstość obliczeniową rzędu około 400 milionów parametrów na mm². Z technicznego punktu widzenia nie jest to więc kolejny “zwykły procesor AI”, ale demonstrator pokazujący, jak daleko można upchnąć obliczenia optyczne w mikroskali.

Czytaj też: Grafen bez grafenu, czyli jak naukowcy zrobili materiał, w którym fale spinu udają elektrony

Cały pomysł polega na tym, że model nie działa jak typowy procesor, którego można dziś wrzucić do serwera i programowo przełączać między zadaniami bez końca. W tym przypadku architektura jest projektowana offline, a potem “utrwalana” w fizycznej strukturze fotonicznej. Sam artykuł porównuje takie podejście do ASIC-ów, czyli układów wyspecjalizowanych do konkretnego zadania. Zysk jest oczywisty – bardzo niski narzut podczas wnioskowania i brak części kosztów związanych z ciągłym dostrajaniem. Jednocześnie cena też jest oczywista, bo elastyczność takiego rozwiązania jest dużo mniejsza niż w klasycznych procesorach.

Nie takie fotoniczne układy idealne, na jakie wyglądają

Demonstracyjne układy osiągnęły 89 proc. skuteczności dla MNIST i 90 proc. dla MedNIST, a część eksperymentalna opierała się na przygotowanych zestawach testowych obejmujących 100 próbek MNIST i 60 próbek MedNIST. Innymi słowy, wynik jest mocny jak na tak mały układ, ale nie mówimy o gotowym zamienniku akceleratorów obsługujących wielkie modele generatywne. Bardziej o bardzo obiecującym dowodzie, że taki kierunek ma sens, bo sami naukowcy jednoznacznie akcentują ultra mały rozmiar, niski narzut i możliwość wykonywania wyspecjalizowanego wnioskowania w pamięci samego układu, a nie na zapowiedź natychmiastowego końca ery GPU. Tego typu optyczne procesory są jednak kuszące nie bez powodu.

Klasyczne układy elektroniczne coraz częściej dochodzą do ściany nie dlatego, że nie potrafią liczyć, ale dlatego, że kosztuje to zbyt dużo energii i generuje zbyt dużo ciepła. Optyczne sieci neuronowe są interesujące właśnie ze względu na niski narzut cieplny, bardzo małe opóźnienia i dużą równoległość przetwarzania. Jest to atrakcyjna odpowiedź na problem architektury, w której pamięć i procesor są rozdzielone, a dane trzeba bez końca przerzucać między kolejnymi blokami.

Czytaj też: Najzimniejsze miejsce na Ziemi dostaje nowe serce. Wszystko w imię nauki

Z perspektywy infrastruktury AI brzmi to jak świetna wiadomość. Jeśli centra danych mają zużywać coraz więcej energii, to każda technologia pozwalająca zmniejszyć energochłonność konkretnych etapów wnioskowania staje się cenna. To nie musi od razu oznaczać przewrotu w całym sektorze. Wystarczy, że optyczne akceleratory zaczną przejmować część wybranych zadań, zwłaszcza tam, gdzie liczy się powtarzalność, niskie opóźnienie i bardzo wysoka sprawność energetyczna.

Największa przeszkoda wciąż nazywa się “skalowanie”

I właśnie tutaj kończy się najłatwiejsza część tej historii. Bo o ile pokazanie małego, skutecznego demonstratora robi świetne wrażenie, o tyle przejście od takich układów do rozwiązań szeroko wdrażanych w przemyśle jest już zupełnie inną parą kaloszy. Naukowcy od fotonicznych sieci neuronowych od dawna wskazują na bardzo konkretne bariery w szerokim wdrażaniu takich procesorów, a w tym błędy produkcyjne, wrażliwość na czynniki środowiskowe, problemy ze skalowaniem liczby portów, degradację sygnału i trudności integracyjne na poziomie całego systemu. Innymi słowy, przed tą technologią jest jeszcze dłuuuga droga do komercjalizacji.

Źródła: University of Sydney, Nature, IEA