W świecie typowego gracza da się jeszcze udawać, że problem nie jest aż tak wielki. Mocniejsza karta, wyższe rachunki, cieplejszy pokój – no cóż, życie. Jakoś trzeba grać w te niezoptymalizowane coraz częściej nowości. Jednak w centrach danych ta sama kwestia przeradza się w znacznie większy problem. Tam bowiem każda strata energii na konwersji napięcia mnoży się przez tysiące układów graficznych, całe rzędy szaf serwerowych i lata pracy bez przerwy. Dlatego naukowcy postanowili coś z tym zrobić.

Karty graficzne nie tylko kosztują sporo. One wręcz pożerają prąd

Zacząłem od prostego sprawdzenia, ile energii potrafią dziś pochłaniać najmocniejsze i najnowsze karty graficzne? Taki GeForce RTX 5090 ma parametr całkowitej mocy (Total Graphics Power – TGP) na poziomie 575 W, a rekomendowana moc zasilacza dla całego zestawu wynosi 1000 watów. GeForce RTX 5080 schodzi do 360 watów, ale i to przekłada się pobór mocy większy niż wiele całych komputerów sprzed kilkunastu lat. Po stronie AMD nie jest wcale lepiej, bo np. taki Radeon RX 9070 XT odznacza się podobnym parametrem na poziomie 304 W, czyli jest wyraźnie oszczędniejszy od flagowego potwora NVIDII, ale nadal “zjada” sporo.

Czytaj też: Tak wygląda walka z niewidzialnym przeciwnikiem. Wykazali, że powietrze potrafi uderzyć jak ściana

Czy to dużo z perspektywy rachunków? Wbrew pozorom, tak, bo sama karta RTX 5090 pracująca przez 3 godziny dziennie z poborem zbliżonym do 575 W zużyłaby w rok około 630 kWh. Przy prostym przeliczniku 1 zł za 1 kWh daje to około 630 zł rocznie tylko za samą kartę graficzną, a to wszystko bez procesora, monitora, płyty głównej, pamięci, wentylatorów i strat na zasilaczu. RTX 5080 w tym samym scenariuszu to około 394 kWh, a Radeon RX 9070 XT około 333 kWh. Oczywiście gry obciążają GPU różnie, a odpowiednie ustawienia (np. synchronizacja klatek na sekundę z odświeżaniem monitora) robią swoje, ale problem jest i tak ogromny.

Cały komputer z wyższej półki może bowiem spokojnie pożerać 700-900 watów pod pełnym obciążeniem. Wtedy trzy godziny dziennie przez cały rok robią z komputera urządzenie, które zużywa około 767-986 kWh. Ten problem widać przy testach RTX 5090 i DLSS 4, gdzie obok klatek na sekundę coraz trudniej ignorować pobór mocy, temperatury i kulturę pracy.

W centrum danych każdy wat ma znaczenie, ale naukowcy mają na to sposób

W domu taki rachunek może zirytować, ale w centrum danych zaczyna być znacznie bardziej problematyczny. Międzynarodowa Agencja Energetyczna szacuje, że centra danych zużywały około 460 TWh energii elektrycznej w 2024 roku, a do 2030 roku ich zapotrzebowanie może wzrosnąć do około 945 TWh. Najciekawsze wydaje mi się to, że problem nie polega wyłącznie na tym, że GPU liczą coraz lepiej, ale też na tym, że wymagają do tych obliczeń coraz lepszego zasilania. W serwerowniach energia często rozprowadzana jest przy wyższym napięciu, na przykład 48 V, bo tak łatwiej ograniczać straty na przesyle, ale sama karta graficzna potrzebuje dużo niższych napięć. Pomiędzy jednym i drugim światem siedzi element, który przeciętny użytkownik komputera zwykle ignoruje, bo układ obniżający napięcie. W to właśnie uderza nowy projekt od naukowców.

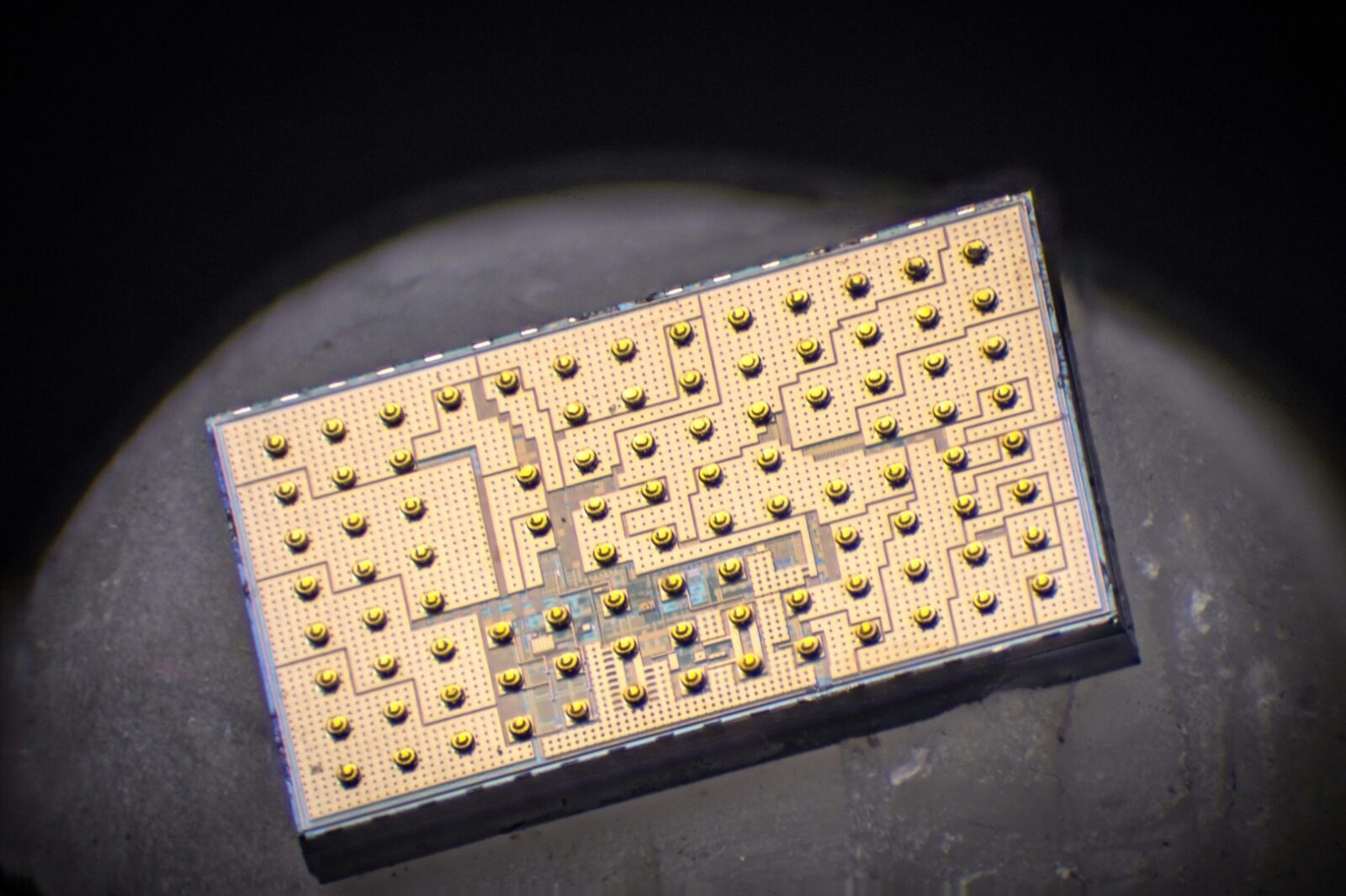

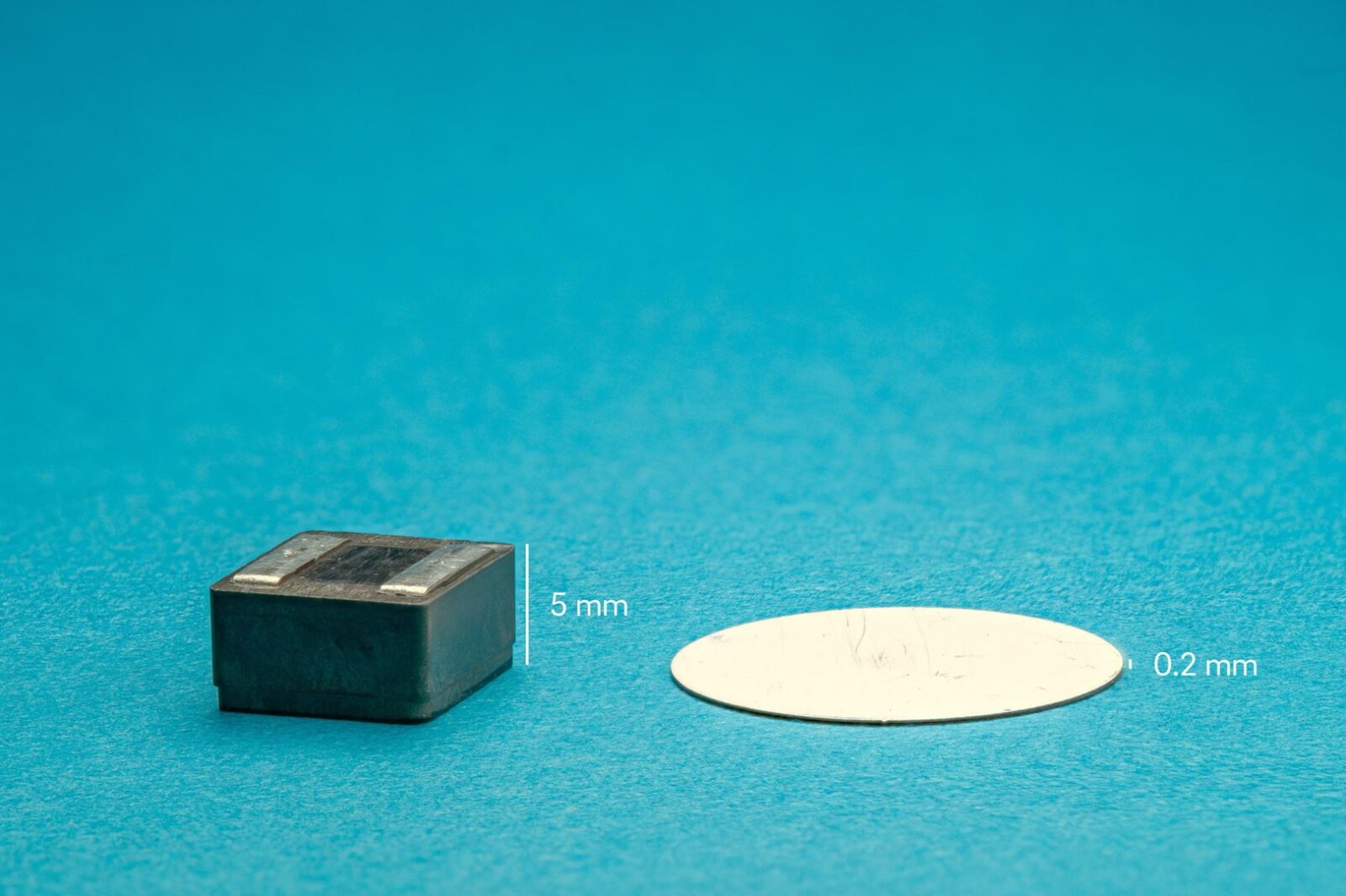

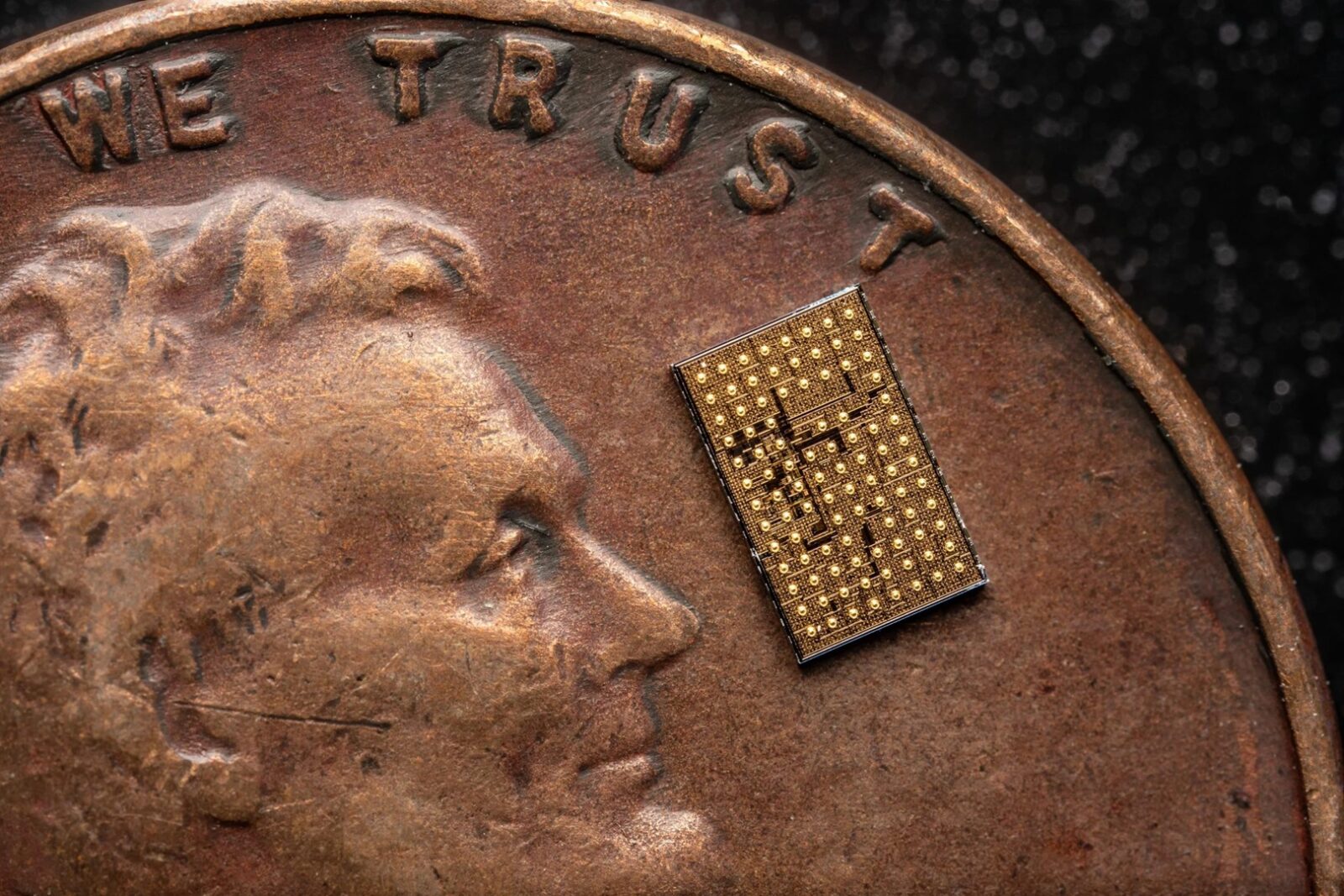

Nowy chip opisany w pracy opublikowanej w Nature Communications i przez Uniwersytet Kalifornijski w San Diego nie sprawia, że RTX 5090 nagle przestaje być 575-watową kartą. W praktyce chodzi o poprawę sposobu, w jaki wysokie napięcie jest zamieniane na niższe napięcie potrzebne elektronice obliczeniowej. Prototyp przekształcił bowiem 48 V na 4,8 V z maksymalną sprawnością 96,2 procent i dostarczył około cztery razy większy prąd wyjściowy niż wcześniejsze konstrukcje piezoelektryczne tego typu.

Czytaj też: Jak tu nie uwielbiać Słońca? Teraz stało się niszczarką do plastiku i źródłem paliwa przyszłości

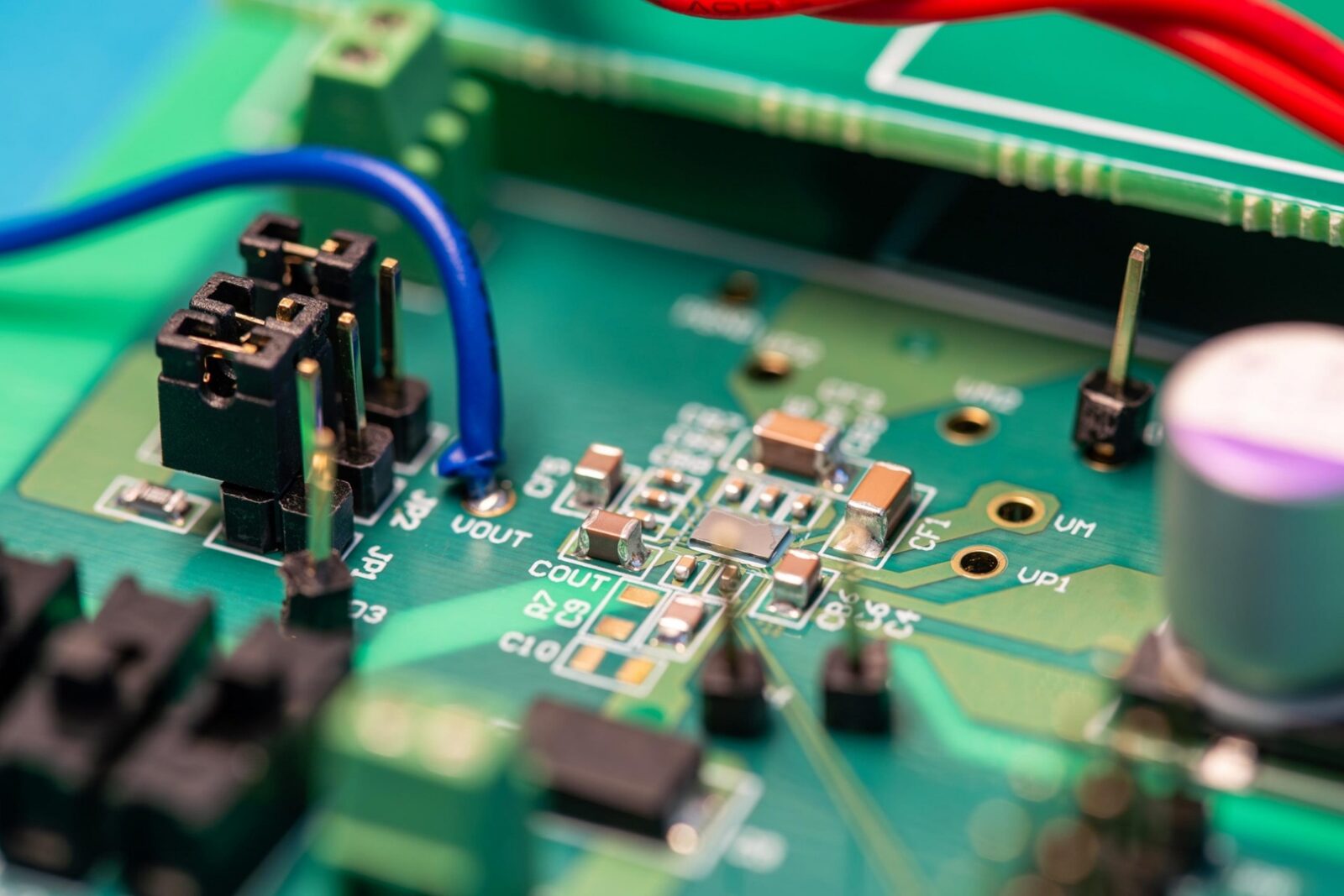

Różnica względem klasycznego podejścia tkwi w tym, że nowy układ wykorzystuje rezonator piezoelektryczny. Zamiast opierać cały proces głównie na elementach magnetycznych, takich jak induktory, korzysta z mechanicznych drgań do magazynowania i przenoszenia energii. Założenie? Wykorzystać zjawisko, które w innych miejscach elektroniki już znamy i zaprzęgnąć je do miniaturyzacji oraz poprawy sprawności zasilania. Sam rezonator nie wystarczyłby jednak do sukcesu i właśnie dlatego projekt jest hybrydowy. Rezonator piezoelektryczny został bowiem w tym podejściu połączony z małymi, komercyjnie dostępnymi kondensatorami w konfiguracji, która tworzy kilka ścieżek przepływu energii i zmniejsza straty wewnątrz układu.

Nie widzę tu więc cudownej obietnicy “GPU bez rachunków za prąd”, tylko bardziej inżynierską próbę wyciśnięcia dodatkowej efektywności z miejsca, które przy rosnącej skali obliczeń staje się coraz bardziej bolesne.

Dlaczego 96,2 procent sprawności ma znaczenie?

Ktoś może spojrzeć na 96,2 procent i wzruszyć ramionami, bo przecież strata 3,8 procent nie wydaje się jakimś wielkim problemem. Tyle że przy dużej mocy nawet tak skromne procenty szybko zamieniają się w ciepło. Jeśli do układu trzeba dostarczyć 575 watów po stronie obciążenia, to przy sprawności 96,2 procent strata samej konwersji wynosi około 23 W. Przy 92 procentach byłoby to już około 50 W. Różnica na jednej karcie lub jednym akceleratorze nie robi może wielkiego wrażenia, ale przy 10 tysiącach GPU oznacza setki kilowatów mocy pracujące właściwie bez przerwy. Tutaj zaczyna się prawdziwy sens takiego wynalazku. Mniej strat na konwersji to mniej ciepła do odprowadzenia, mniejsze obciążenie systemów chłodzenia i potencjalnie jeszcze większa gęstość obliczeniowa w centrum danych.

Dla mnie to jest też dobry przykład tego, jak mylące bywa patrzenie na rozwój komputerów wyłącznie przez pryzmat architektury GPU. Oczywiście rdzenie, pamięć HBM, GDDR7, interkonekty i proces technologiczny są fascynujące. Jednak im wyżej idziemy z mocą, tym mocniej wracają tematy pozornie nudne, bo samo zasilanie, ciepło, kable, złącza, konwersja napięcia, straty, chłodzenie cieczą. Przy problemach ze złączami RTX 5090 widać to zresztą bardzo dosadnie, bo czasem granica między “mocnym sprzętem” a “ryzykiem konstrukcyjnym” przebiega właśnie przez prąd.

Czytaj też: Nowy język projektowania elektroniki jutra? Naukowcy zbudowali istny molekularny warsztat

Niestety jednak konwertery piezoelektryczne nie są jeszcze gotowe do zastąpienia obecnych technologii zasilania. Do rozwiązania zostają materiały, układy, pakietowanie i integracja z płytami. Szczególnie ciekawy jest problem mechaniczny, bo jako że rezonatory piezoelektryczne drgają podczas pracy, to nie można ich po prostu traktować jak kolejnego zwykłego elementu do przylutowania na płytce. Mimo to uważam, że kierunek jest bardzo ważny. Branża komputerowa wpadła w etap, w którym zwiększanie mocy obliczeniowej coraz częściej wymaga nie tylko lepszych chipów, ale też lepszej infrastruktury wokół nich. Prąd musi dotrzeć tam, gdzie trzeba, w odpowiednim napięciu, z minimalnymi stratami i bez dokładania kolejnych problemów termicznych.

Źródła: Nature Communications, IEA, Uniwersytet Kalifornijski w San Diego