Tym razem NVIDIA zagrała na dwa fronty jednocześnie, bo graczom sprzedaje płynność, ray tracing i path tracing, a twórcom gier obiecuje szybszą integrację AI bezpośrednio w silniku oraz produkcyjnym procesie. O czym więc dokładnie mowa?

Star Wars i Bond mają pokazać, po co NVIDII DLSS 4.5

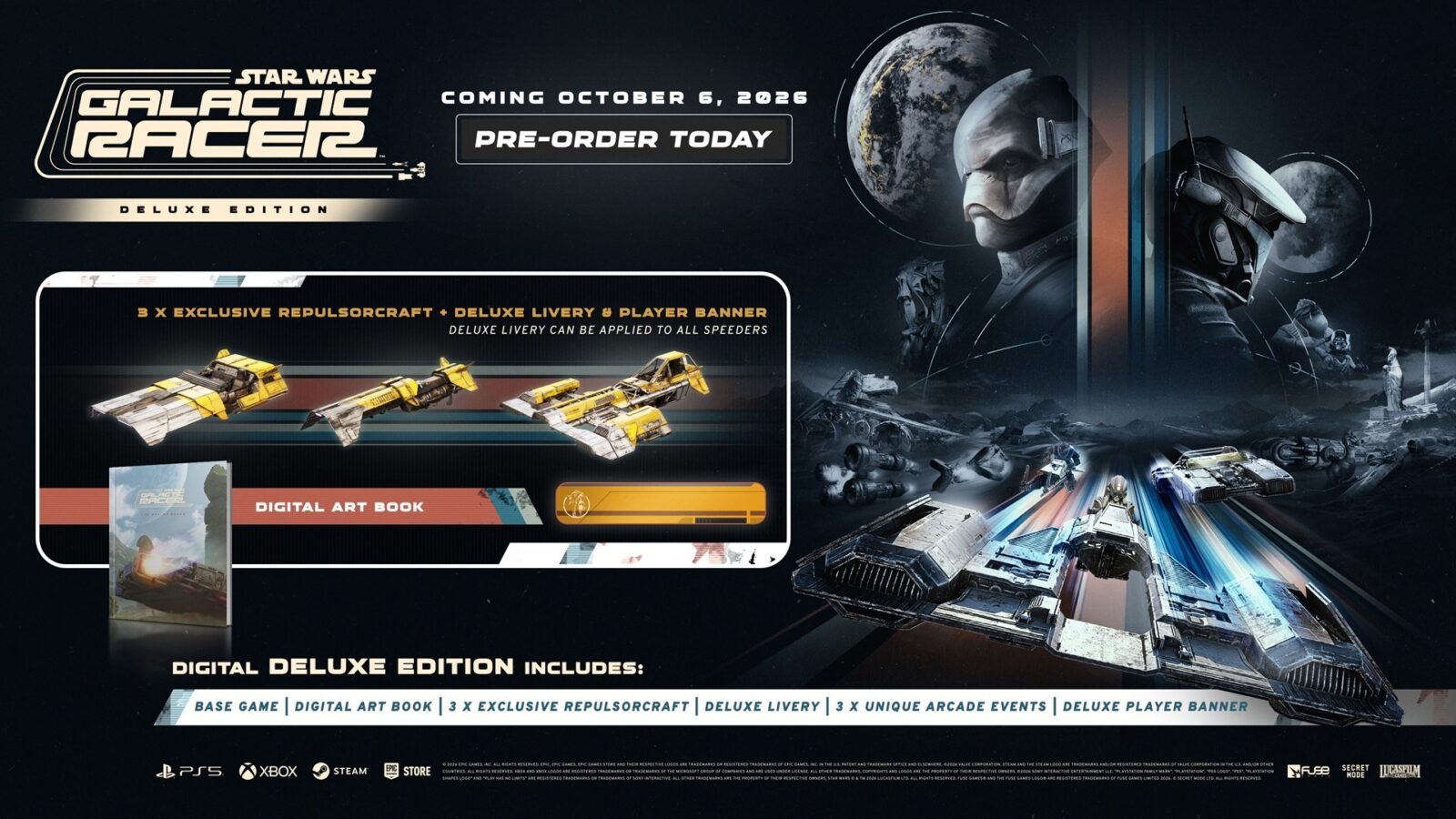

Najbardziej widowiskowa część ogłoszenia dotyczy oczywiście gier, z czego możecie sprawdzić już dziś działanie DLSS w grze Dead As Disco. Znacznie ciekawiej wypadają jednak dwie inne zapowiedzi. Star Wars: Galactic Racer, który zadebiutuje 6 października, od dnia premiery ma wspierać DLSS 4.5, a w tym Dynamic Multi Frame Generation oraz Super Resolution z modelem transformer drugiej generacji. Do tego dochodzi sprzętowo akcelerowane oświetlenie Lumen z ray tracingiem i DLSS Ray Reconstruction na pecetach oraz laptopach z GeForce RTX. Innymi słowy, nie mówimy już o “zwykłym” skalowaniu obrazu, ale o pełnym pakiecie rekonstrukcji, generowania klatek i poprawiania oświetlenia w grze, która z racji tempa wyścigów będzie brutalnie obnażać każdą niestabilność obrazu w ruchu.

Czytaj też: NVIDIA znów zaskakuje. Tyle gier do ogrania, że głowa mała

W przypadku 007 First Light stawka jest jeszcze bardziej czytelna. Gra ta zadebiutuje znacznie szybciej, bo 27 maja i ma korzystać na komputerach osobistych z path tracingu, DLSS 4.5 Dynamic Multi Frame Generation oraz DLSS Ray Reconstruction. NVIDIA mówi o najwyższym poziomie filmowej szczegółowości dla posiadaczy GeForce RTX serii 50, ale sam czytam to bardziej przyziemnie. W moich oczach nowy Bond ma być ot kolejną pokazówką tego, że path tracing w grach AAA przestaje być wyłącznie technologicznym eksperymentem dla pokazowych scen, choć niezmiennie bywa bezlitosny dla sprzętu i często wymaga ratowania się rekonstrukcją oraz generowaniem klatek. Jednak to właśnie w tym kierunku NVIDIA pcha dziś pecetowe granie.

DLSS 4.5 nabrał jeszcze więcej charakteru

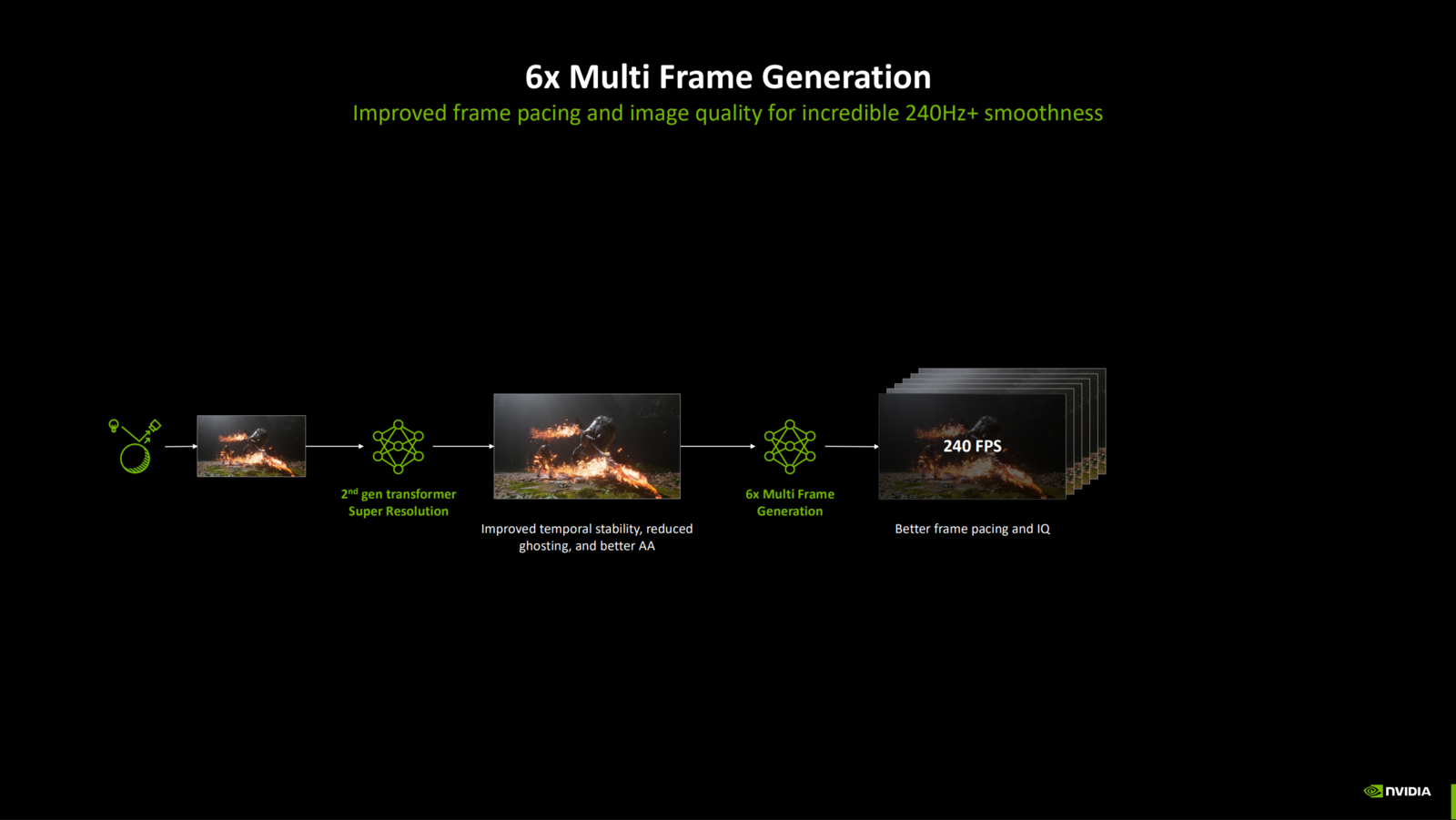

Odkąd piszę o DLSS, mam wrażenie, że ta technologia przeszła dość ciekawą drogę. Zaczynała jako sposób na podbicie wydajności przez skalowanie obrazu z niższej rozdzielczości, a dziś coraz bardziej przypomina cały zestaw narzędzi do ratowania zbyt kosztownego renderingu. Zwłaszcza po aktywacji ray tracingu lub path tracingu. Oto jednak DLSS 4.5 wprowadza model transformer drugiej generacji dla Super Resolution, tryb 6X Multi Frame Generation oraz Dynamic Multi Frame Generation, które ma zmieniać mnożnik generowania klatek w czasie rzeczywistym zależnie od sceny i odświeżania ekranu.

NVIDIA podaje też, że model Super Resolution używa pięciokrotnie większej mocy obliczeniowej względem wcześniejszego transformera, korzysta z rozszerzonego zbioru treningowego i ma poprawiać stabilność czasową, antyaliasing oraz czytelność obrazu w ruchu. Musimy jednak pamiętać, że samo generowanie wielu klatek nie zastępuje dobrej bazowej płynności. Wprawdzie może świetnie wygładzić odbiór gry na szybkim monitorze, ale nie powinno być traktowane jak cudowna metoda na uratowanie zupełnie każdej produkcji działającej słabo u podstaw. Jeżeli gra renderuje się w zbyt niskiej liczbie klatek, to opóźnienia i responsywność nadal będą ogromnym problemem i Reflex może i to poprawia, ale fizyki interakcji z grą nie da się oszukać.

Najciekawsza część tej układanki dzieje się po stronie twórców

Mam jednocześnie wrażenie, że najważniejszy fragment całej aktualizacji wcale nie dotyczy graczy, tylko deweloperów. NVIDIA udostępniła wtyczkę TensorRT for RTX dla Neural Network Engine w Unreal Engine, czyli środowisko wykonawcze pozwalające uruchamiać modele AI bezpośrednio w aplikacjach czasu rzeczywistego. Według danych z przykładowego projektu w Unreal Engine na GeForce RTX 5090 inferencja przez DirectML zajęła 5,7 ms, a przez TensorRT dla RTX 3,8 ms, co przekłada się tym samym na około 1,5 raza wyższą wydajność. Jest to o tyle ważne, że jeśli modele AI mają pracować w renderingu, animacji, języku, mowie, postprocessingu, odszumianiu albo innych elementach gry, to liczy się każda milisekunda opóźnienia, bo wpływa ona na płynność.

Czytaj też: NVIDIA znów zasypała graczy nowościami. Jedna z nich od razu mnie zainteresowała

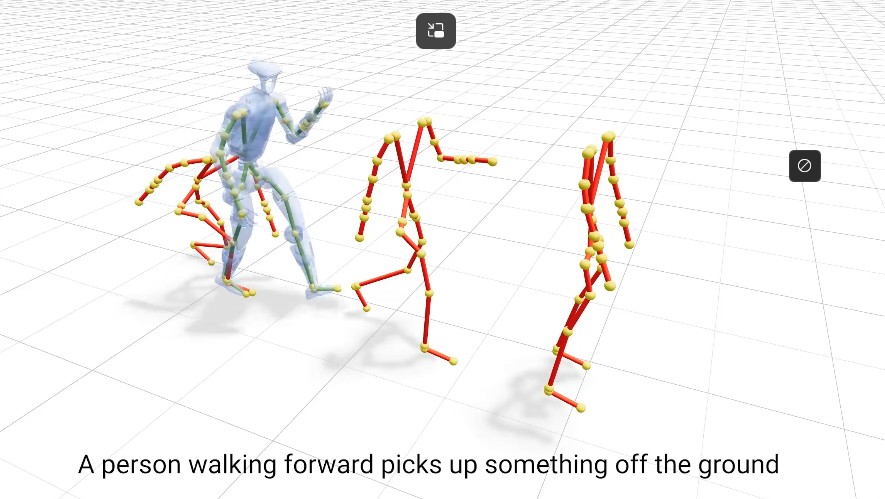

Druga rzecz, która od razu mnie zainteresowała, to Kimodo. NVIDIA opisuje ten projekt jako model dyfuzyjny do generowania ruchu 3D, który został wytrenowany na 700 godzinach danych motion capture. Kimodo może być sterowane tekstem oraz ograniczeniami kinematycznymi, takimi jak pełne klatki kluczowe ciała, pozycje i rotacje wybranych stawów, punkty trasy oraz gęste ścieżki 2D. Skąd to zainteresowanie? Ano stąd, że brzmi to jak coś, co w produkcji gier mogłoby skrócić najnudniejszy etap szukania właściwego ruchu, choć nie oznacza to, że nagle każdy ruch wygenerowany przez AI będzie gotowy do wrzucenia do gry.

W podobnym kierunku idzie przewodnik NVIDII dla ComfyUI. Firma opisała trzy procesy z GenAI Creator Toolkit zaadaptowane z kursu Deep Learning Institute z GTC 2026. Chodzi o rozdzielanie obrazu na warstwy, usuwanie niechcianych obiektów z inteligentnym wypełnianiem tła oraz przekształcanie zdjęcia w teksturowany model 3D w formacie GLB. Wszystko działa lokalnie na kartach NVIDIA RTX, a pierwszy zestaw wymaga pobrania dużych modeli i przygotowania środowiska ComfyUI.

NVIDIA coraz mocniej miesza granie z produkcją gier

Właśnie tutaj widzę główny sens całej tej aktualizacji. Z jednej strony mamy Star Wars: Galactic Racer, 007 First Light i Dead As Disco, czyli gry, które mają pokazać różne oblicza DLSS, Reflexa, Lumen, Ray Reconstruction i path tracingu. Z drugiej strony dostajemy TensorRT dla RTX w Unreal Engine, Kimodo, ComfyUI i kolejne materiały z GDC oraz GTC. Wbrew pozorom, to nie są całkowicie osobne światy. NVIDIA ewidentnie próbuje spiąć je w jedną opowieść tego, że gry mają wyglądać lepiej dzięki AI, działać szybciej dzięki AI i powstawać sprawniej dzięki AI.

Czy mi się to podoba? Częściowo tak, bo technicznie jest to bardzo interesujące. DLSS 4.5 rozwiązuje konkretne problemy obrazu w ruchu, TensorRT dla RTX może ograniczać koszt inferencji w silnikach czasu rzeczywistego, a Kimodo i ComfyUI mogą pomóc twórcom szybciej eksperymentować. Musimy jednak pamiętać, że im głębiej AI wchodzi w grafikę i produkcję, tym rośnie ryzyko przesady.

Źródła: NVIDIA, NVIDIA Developer