Hasła o “prywatnej sztucznej inteligencji”, “agentach działających lokalnie” i “komputerach agentowych” trafiają dziś na bardzo podatny grunt. Korzystający z AI użytkownicy mają już bowiem dość abonamentów, opóźnień, limitów tokenów i wysyłania każdego wrażliwego fragmentu życia do chmury, czyli niczego innego, jak centrów danych. To jednak wcale nie oznacza, że każda lokalna sztuczna inteligencja automatycznie staje się tania, bezpieczna, gotowa do działania bez kompromisów czy nawet łatwa w użyciu.

Jak NVIDIA sprzedaje nową ideę komputera?

NVIDIA wprost używa już określenia “agent computers”, opisując komputery wyposażone w karty graficzne GeForce RTX czy wyspecjalizowane komputery DGX Spark jako maszyny przeznaczone do uruchamiania osobistych agentów lokalnie, prywatnie i bez stałych kosztów chmurowych. W praktyce chodzi o połączenie lokalnych modeli językowych, pamięci kontekstowej, dostępu do plików i aplikacji oraz narzędzi, które pozwalają agentowi nie tylko odpowiadać, ale też wykonywać konkretne zadania. To już nie jest zwykłe “chatowanie z modelem” przez Internet, ale próba zrobienia z komputera czegoś w rodzaju cyfrowego operatora działającego obok użytkownika przez cały dzień.

Samo ogłoszenie nie opiera się zresztą na jednym modelu, ale na całym zestawie elementów. NVIDIA promuje Nemotron 3 Nano 4B jako lekki punkt wejścia dla lokalnych asystentów na RTX-ach, a jednocześnie wskazuje rozwijany Nemotron 3 Super jako większy model klasy 120B z 12 miliardami aktywnych parametrów i natywnym oknem kontekstu rzędu 1 miliona tokenów. Do tego dochodzą optymalizacje dla Qwen 3.5 i Mistral Small 4, a także gotowe ścieżki uruchamiania ich przez Ollama, LM Studio i llama.cpp. Innymi słowy, NVIDIA nie próbuje już zamknąć użytkownika w jednym własnym modelu, ale chce stać się centrum lokalnego ekosystemu open model. Jest to świetna wiadomość, bo na własnej skórze przekonałem się, że poważniejsza zabawa we własną sztuczną inteligencję na biurku, to nie lada wyzwanie.

Właśnie tutaj widać najciekawszą zmianę względem poprzednich lat. Do niedawna lokalne modele na desktopie były głównie zabawką dla osób technicznych, ale teraz NVIDIA dąży do ich zdemokratyzowania, upraszczając cały stos narzędzi i jednocześnie budując wokół niego nowe nazewnictwo. “Komputer agentowy” brzmi bardziej ambitnie niż “pecet z lokalnym LLM-em”, ale pod spodem nadal chodzi o ten sam fundament: dużo pamięci, odpowiednio szybki układ i dobrze zoptymalizowane modele. Różnica polega na tym, że dziś ten fundament zaczyna być sprzedawany jako osobna kategoria urządzeń.

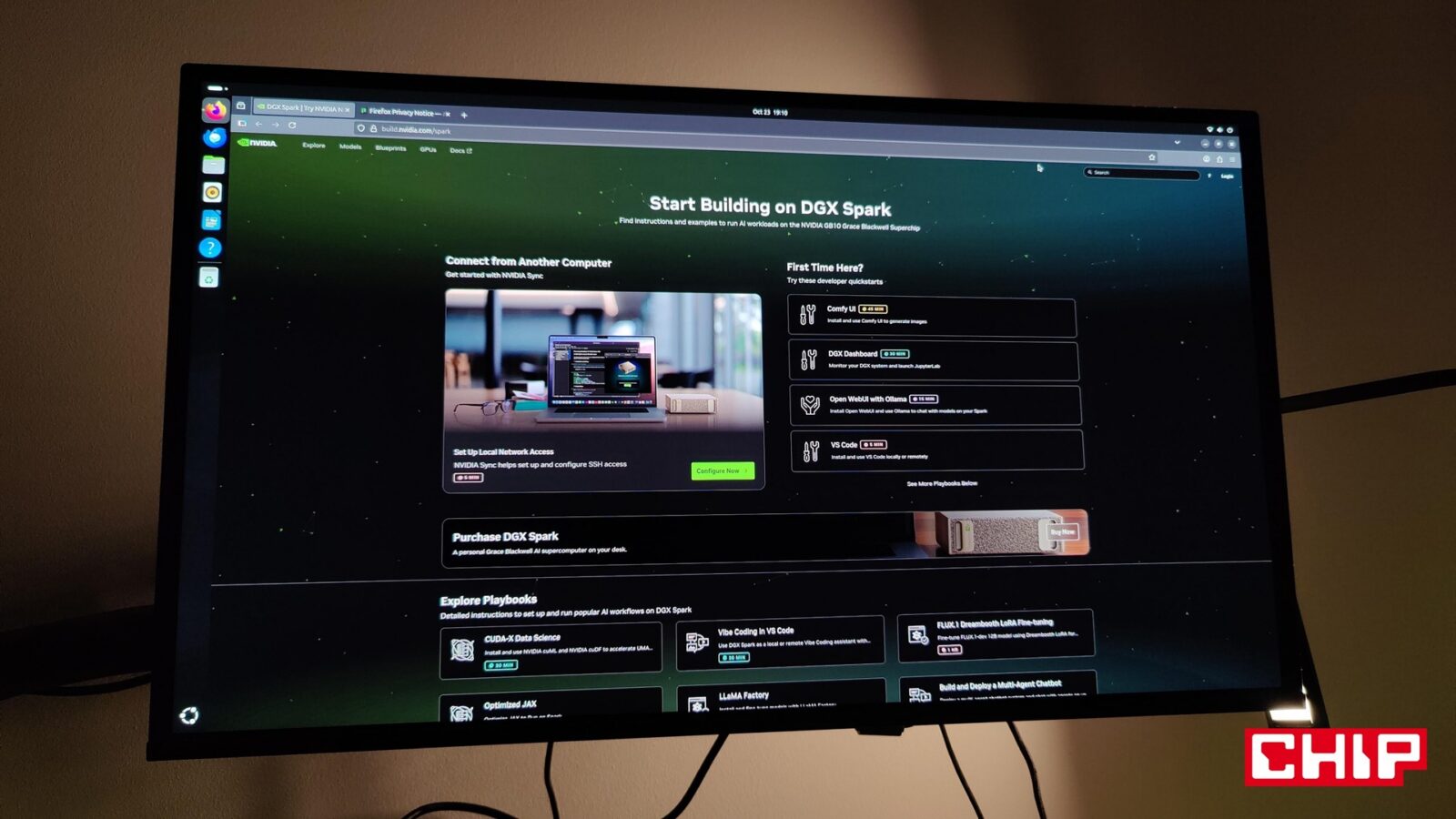

DGX Spark pokazuje skalę ambicji, ale też skalę ceny

Najbardziej namacalnym symbolem tej nowej wizji pozostaje DGX Spark. Więcej na jego temat przeczytacie w moim teście, ale dla przypomnienia, ta niepozorna jednostka pozwala testować i uruchamiać modele do 200 miliardów parametrów, a po spięciu dwóch systemów można dojść do 405 miliardów. Jest to o tyle imponujące, że całość została zamknięta w obudowie o wymiarach 150 x 150 x 50,5 mm, ale sęk w tym, że nie mówimy o nowym “pececie dla każdego”, ale o sprzęcie z półki wyraźnie entuzjastycznej, bo kosztującej około 19200 złotych na polskim rynku.

Czytaj też: NVIDIA zrobiła z DLSS 5.0 jedno wielkie pośmiewisko. Wincyj AI. Gracze wytrzymają… a raczej nie

Z tej perspektywy opowieść o “darmowych agentach bez chmury” robi się bardziej złożona. Aktualnie bowiem sprawa wygląda tak, że owszem – nie płacimy za tokeny i trzymamy wszystko “u siebie”, ale musimy zapłacić bardzo dużo za sam próg wejścia, a i tak nie dostajemy narzędzi typu plug&play. Na szczęście firma NVIDIA skupia się jednak na tym, żeby dostęp do tej technologii ciągle ułatwiać, a DGX Spark jest dopiero początkiem tej wielkiej drogi, która zakończy się szerszą dostępnością narzędzi wykorzystujących lokalnie przetwarzaną sztuczną inteligencję. Innymi słowy, w wizji kreowanej przez firmę NVIDIA potęga SI stanie się po pewnym czasie dostępna dla wszystkich.

Prywatność to nie to samo co bezpieczeństwo

Najbardziej interesujące jest jednak to, że sama NVIDIA w swoich materiałach zostawia bardzo wyraźne ostrzeżenia. W playbookach dotyczących OpenClaw i NemoClaw można przeczytać wprost, że agent może uzyskać dostęp do plików, wykonywać komendy i łączyć się z zewnętrznymi usługami, a ryzyko wycieku danych i uruchomienia złośliwego kodu jest całkowicie prawdziwe. Co więcej, producent mocno zaleca uruchamianie takich systemów na osobnym, “czystym” urządzeniu albo w maszynie wirtualnej, a nie na głównej stacji roboczej z wrażliwymi danymi. To bardzo ważna korekta wobec uproszczonego hasła “lokalnie = bezpiecznie”.

Czytaj też: Open Claw, lokalny asystent AI od NVIDIA dla kart RTX i systemów DGX

Właśnie dlatego pojawia się NemoClaw i OpenShell. NVIDIA opisuje OpenShell jako środowisko uruchomieniowe z izolacją na poziomie kernela, a NemoClaw jako warstwę, która pakuje OpenClaw do bardziej kontrolowanego, sandboxowanego modelu działania. Brzmi to sensownie, ale warto zauważyć, że nawet same materiały producenta określają to jako demo, a nie gotowy system produkcyjny. Innymi słowy, NVIDIA nie ukrywa, że temat bezpieczeństwa agentów dopiero się układa i że dziś bardziej oglądamy pierwszą generację narzędzi zabezpieczających niż zamknięty, dopracowany standard.

Nie tylko praca z agentami. NVIDIA dokłada jeszcze kreatywne AI i DLSS 5

Na GTC 2026 firma NVIDIA nie ograniczyła się do opowiadania o sprzęcie i agentach, bo zapowiedziała też optymalizacje dla modeli generatywnych do obrazu i wideo. LTX 2.3 od Lightricks zyskał wsparcie dla NVFP4 i FP8, co według producenta przekłada się na 2,1-krotne przyspieszenie, a FLUX.2 Klein 9B doczekał się kolejnej optymalizacji w wersji FP8 pod RTX-y. Do tego dochodzi Unsloth Studio, czyli webowe środowisko do fine-tuningu, które ma uprościć dostrajanie ponad 500 modeli bez konieczności grzebania w kodzie i parametrach na niskim poziomie.

Czytaj też: NVIDIA G-SYNC Pulsar da ci obraz ostry jak żyleta, a zapomnisz o pogoni za hercami

W praktyce oznacza to, że NVIDIA próbuje jednocześnie zagospodarować trzy różne opowieści o pecetach ze sztuczną inteligencją. Pierwsza dotyczy agentów i produktywności, druga lokalnej generacji obrazu i wideo, a trzecia samego grania. W tej ostatniej pojawia się technologia DLSS 5, ale dla niej dedykowałem już inny, odrębny artykuł,

GTC 2026 pokazuje dopiero kierunek, nie metę

Prezentacja NVIDIA na GTC 2026 nie przyniosła jeszcze pełnej rewolucji pecetów agentowych, ale bardzo wyraźnie pokazała, że NVIDIA chce zdefiniować tę kategorię zanim zrobi to ktoś inny. Firma ma już własne modele, własne narzędzia optymalizacyjne, własny sandbox dla agentów, własne ścieżki wdrożenia przez Ollama i LM Studio, a także sprzęt klasy DGX Spark, który może robić za demonstrację całej idei w jednej obudowie. Szczerze? Z niecierpliwością czekam na efekty tego podejścia, bo aktualnie rynek naprawdę potrzebuje rozwiązań, które uczynią lokalne narzędzia sztucznej inteligencji prostszymi w użyciu, a patrząc na dotychczasowe osiągnięcia, firmie NVIDIA coraz bardziej się to udaje.

Źródła: NVIDIA